객체 중심 모델의 평가를 객체 발견을 넘어 확장

초록

본 논문은 기존 객체 중심 학습(OCL) 모델 평가가 객체 발견과 단순 분류에 국한된 한계를 지적하고, VLM(비전‑언어 모델) 기반의 제로샷 VQA 평가와 새로운 Attribution‑aware Grounded Accuracy(AwGA) 지표를 도입해 ‘무엇을 알았는가(what)’와 ‘어디에 있는가(where)’를 동시에 측정한다. 또한 다중 특징 재구성을 활용한 베이스라인을 제시한다.

상세 분석

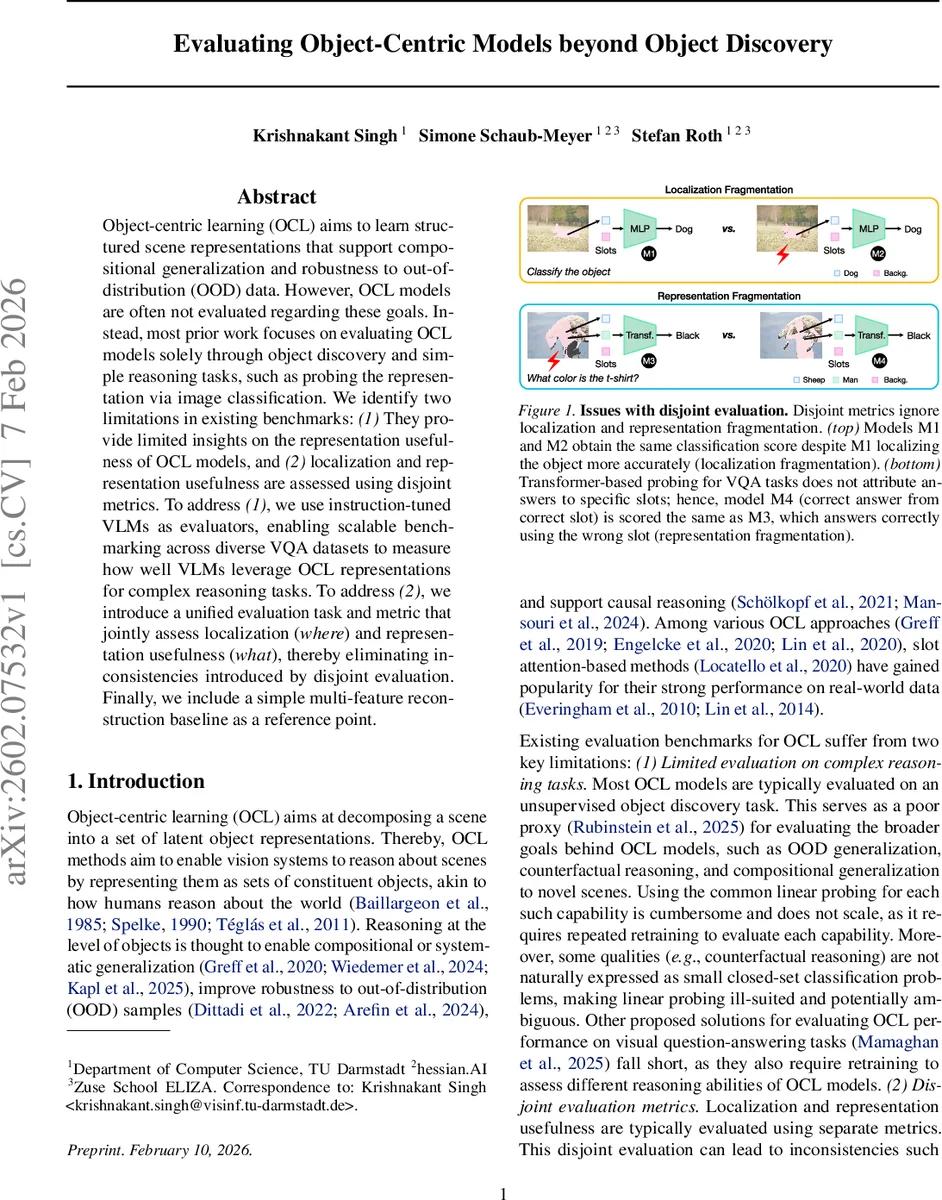

이 연구는 OCL 모델 평가의 두 가지 근본적인 문제를 명확히 규정한다. 첫 번째는 복합적인 추론 능력을 검증할 수 있는 벤치마크가 부족하다는 점이다. 기존 연구는 주로 비지도 객체 발견(Unsupervised Object Discovery, UOD) 혹은 이미지 분류를 위한 선형 프로빙에 의존했으며, 이는 OCL이 목표로 하는 구성적 일반화·OOD 강건성·인과 추론을 충분히 측정하지 못한다. 두 번째는 ‘위치(localization)’와 ‘표현(usefulness)’을 별도 지표로 평가함으로써, 모델이 객체를 정확히 국소화했지만 여러 슬롯에 분산돼 있거나, 반대로 하나의 슬롯에 과도하게 집중돼 실제 의미를 놓치는 경우를 놓친다(‘localization fragmentation’·‘representation fragmentation’).

논문은 이러한 한계를 극복하기 위해 두 가지 핵심 기법을 제안한다. 첫째, instruction‑tuned 비전‑언어 모델을 평가자로 활용한다. 기존의 선형 혹은 트랜스포머 프로브는 각 벤치마크마다 재학습이 필요했지만, 여기서는 LLaVA와 유사한 VLM에 OCL 인코더(예: Slot Attention 기반)를 연결하고, 사전 학습된 LLM을 그대로 사용해 다양한 VQA 데이터셋에 대해 제로샷으로 성능을 측정한다. 이는 OCL 표현이 실제 멀티모달 시스템에서 얼마나 쉽게 활용되는지를 직접적인 ‘유용성(utility)’ 지표로 제공한다.

둘째, ‘what’과 ‘where’를 동시에 평가하는 AwGA 지표를 설계한다. 기존 Grounded Accuracy(G‑Acc)는 정답 여부와 마스크의 IoU를 곱해 위치 정확성을 반영하지만, 어떤 슬롯이 답변에 기여했는지는 고려하지 않는다. AwGA는 각 슬롯에 대한 기여도(gradient‑based attribution)를 계산하고, 질문에 필요한 객체 수 K만큼 상위 슬롯을 선택해 그들의 마스크 합집합에 대해 mIoU를 구한다. 이렇게 하면 답변에 실제로 사용된 슬롯이 정확히 객체를 포착했는지, 그리고 하나의 객체가 여러 슬롯에 분산되지 않았는지를 동시에 평가한다.

실험에서는 최신 Slot‑Diffusion, StableLSD, DINOSAUR 등 여러 최첨단 OCL 모델을 VLM 기반 평가와 AwGA 지표에 적용한다. 결과는 VLM 기반 제로샷 평가가 기존 선형/트랜스포머 프로브보다 높은 일관성을 보이며, AwGA가 모델 순위에 대한 보다 신뢰할 수 있는 정량적 근거를 제공함을 보여준다. 특히, 다중 특징 재구성을 이용한 간단한 베이스라인이 다른 복잡한 모델보다 AwGA 점수와 VQA 정확도에서 경쟁력을 갖는다는 흥미로운 발견도 보고한다.

이 논문의 주요 기여는 (1) OCL 모델을 실제 멀티모달 언어 이해 시스템에 연결해 제로샷으로 평가하는 프레임워크, (2) 위치와 의미를 동시에 고려하는 AwGA 지표, (3) 다양한 LLM 백본과 연결기(connector)에서도 일관된 평가 결과를 얻는 재현성, (4) 단순 재구성 기반 베이스라인이 유의미한 성능을 달성한다는 실증적 증거이다. 이러한 접근은 앞으로 OCL 연구가 단순 객체 발견을 넘어, 실제 응용에서의 활용 가능성을 정량화하는 표준 평가 방법으로 자리 잡을 가능성을 열어준다.

댓글 및 학술 토론

Loading comments...

의견 남기기