IM‑Animation 정체성 분리형 캐릭터 애니메이션을 위한 암시적 모션 토큰

초록

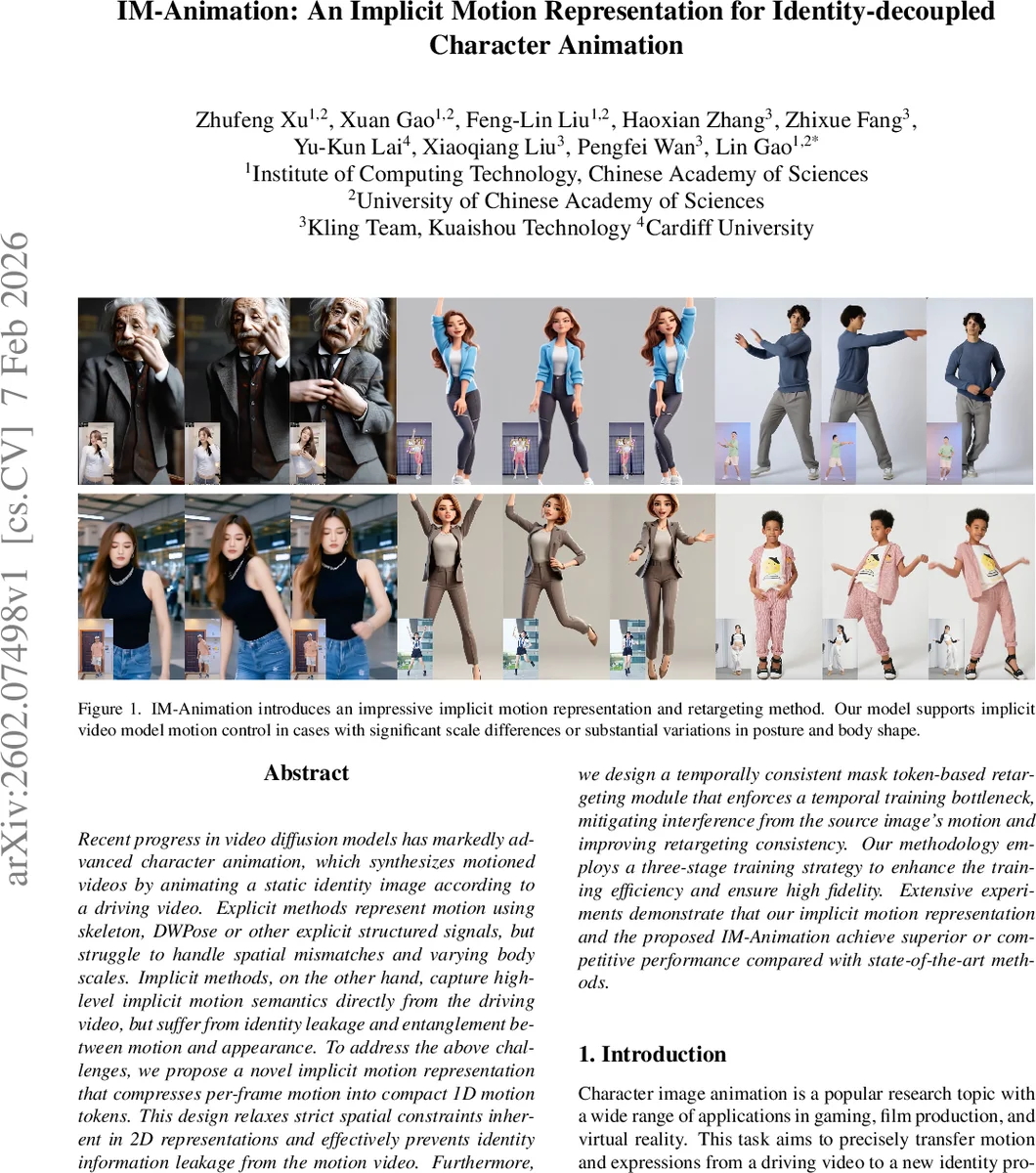

본 논문은 정적인 인물 이미지와 구동 비디오를 입력으로 받아, 인물의 정체성은 유지하면서 구동 비디오의 동작을 정확히 전이하는 새로운 프레임워크 IM‑Animation을 제안한다. 핵심은 2‑D 공간 제약을 벗어난 1‑D 모션 토큰으로 동작을 압축하고, 마스크 토큰 기반의 시간 일관성 보존 리타게팅 모듈을 통해 정체성‑동작 간 누수를 방지한다. 3단계 학습 전략을 통해 효율적인 훈련과 고품질 비디오 합성을 달성한다.

상세 분석

IM‑Animation은 기존 명시적(스켈레톤, DWPose, SMPL 등)과 암시적 모션 표현 방식의 한계를 동시에 보완한다. 명시적 방법은 공간적 정렬 오류와 신체 비율 차이에 취약하고, 기존 암시적 방법은 구동 비디오의 외형 정보가 정체성 이미지에 섞여 들어가는 ‘identity leakage’ 문제를 안고 있다. 이를 해결하기 위해 저자는 두 가지 핵심 설계를 도입한다. 첫째, 프레임별 동작을 1‑D 모션 토큰으로 압축하는 ‘motion tokenizer’를 설계한다. 비디오 프레임을 패치화한 뒤, 고정된 길이(Nm=32)의 학습 가능한 토큰과 결합해 ViT 인코더에 입력하고, 출력 토큰을 벡터 양자화(codebook) 과정을 거쳐 이산적인 1‑D 토큰 시퀀스로 변환한다. 이 과정은 2‑D 좌표 정보를 직접 사용하지 않으므로, 구동 비디오의 신체 형태나 스케일이 정체성 이미지와 크게 달라도 동작 정보만을 추출한다. 둘째, ‘mask token 기반 리타게팅 모듈’은 정체성 이미지의 피처와 1‑D 모션 토큰을 결합할 때, 별도의 마스크 토큰을 삽입해 self‑attention 내부에 학습 병목을 만든다. 마스크 토큰은 원본 이미지 피처에서 동작 정보를 차단하고, 오직 정체성(외형, 색상, 텍스처) 정보만을 전달하도록 강제한다. 이렇게 하면 정체성 이미지가 구동 비디오의 포즈를 그대로 복제하는 현상을 방지하고, 시간적 일관성을 유지한다.

훈련은 세 단계로 진행된다. 1단계에서는 모션 인코더와 양자화 코드북을 학습하면서, 키포인트 히트맵을 예측하도록 보조 디코더를 사용해 동작 정보를 정확히 캡처한다. 2단계에서는 마스크 토큰을 포함한 리타게팅 모듈을 학습하면서, 동시에 모션 인코더를 미세 조정한다. 3단계에서는 전체 파이프라인을 통합해 비디오 디퓨전 모델(DiT 기반)에 리타게팅된 토큰을 주입하고, 노이즈 레벨에 따라 디노이징 과정을 수행해 최종 애니메이션을 생성한다. 또한 얼굴 표정 전달을 위해 별도 표현 인코더(X‑NeMo)를 사용해 프레임별 교차‑어텐션을 적용한다.

실험 결과, IM‑Animation은 다양한 신체 비율 차이(예: 어린이와 성인, 전신↔반신)와 복잡한 포즈 변형에서도 기존 SOTA인 UniAnimate‑DiT, X‑UniMotion 등을 능가하거나 동등한 성능을 보였다. 특히 정체성 누수 지표와 포즈 정확도에서 눈에 띄는 개선을 보였으며, 3단계 학습 전략 덕분에 전체 훈련 비용이 기존 암시적 방법 대비 크게 감소한다.

요약하면, 1‑D 모션 토큰 압축과 마스크 토큰 기반 리타게팅이라는 두 가지 혁신적인 설계가 정체성‑동작 분리를 효과적으로 달성하고, 고해상도·고품질 캐릭터 애니메이션을 실시간에 가깝게 생성할 수 있는 기반을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기