비재귀 다경로 신경망의 하이퍼파라미터 전이 법칙

초록

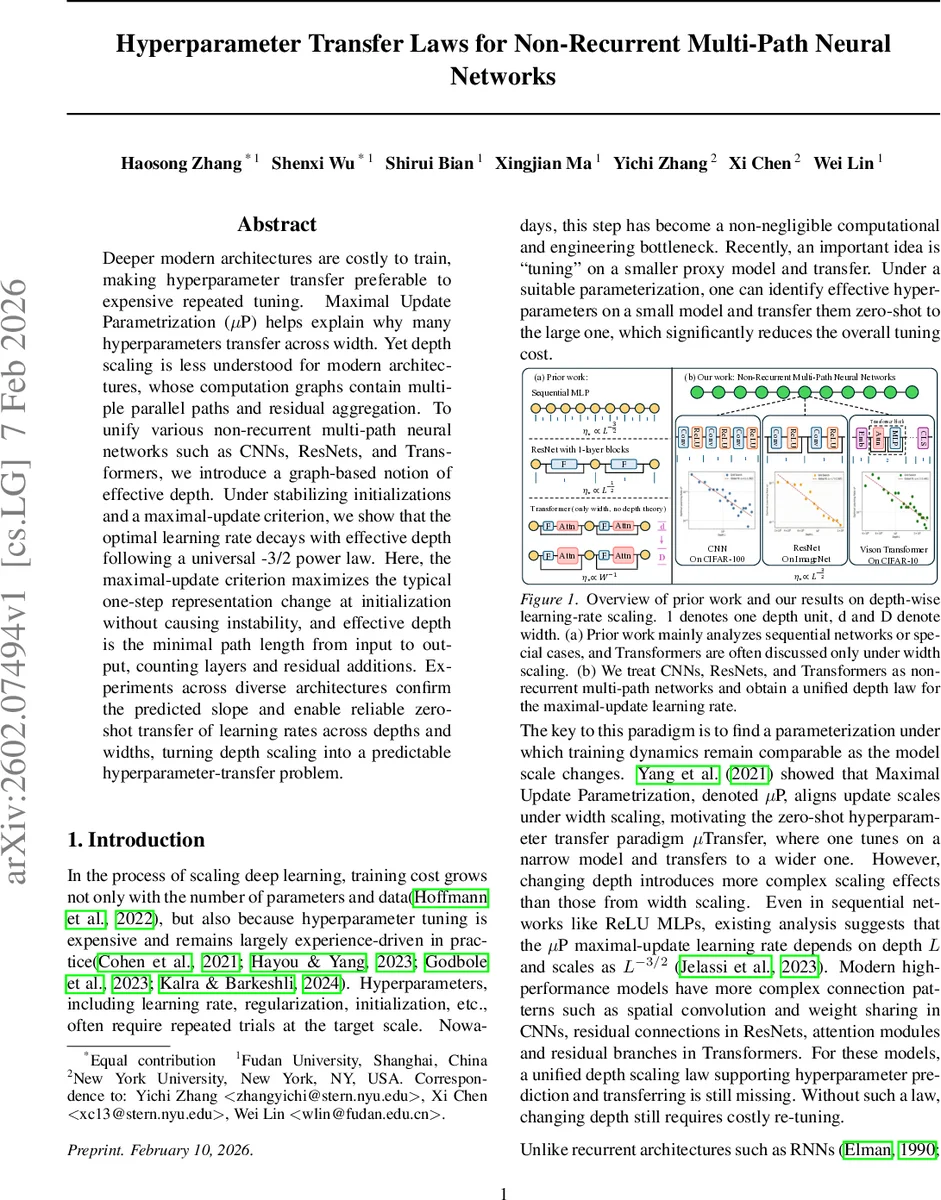

본 논문은 CNN, ResNet, Transformer와 같은 비재귀 다경로 구조를 하나의 그래프 모델로 통합하고, “효과적 깊이” 개념을 도입해 학습률의 깊이 의존성을 이론적으로 분석한다. 안정적인 초기화와 최대 업데이트 기준 하에서 최적 학습률이 효과적 깊이의 -3/2 거듭제곱으로 감소한다는 보편적인 법칙을 제시하고, 이를 실험적으로 검증해 폭넓은 아키텍처와 폭·깊이 변환에 대해 제로샷 전이가 가능함을 보인다.

상세 분석

논문은 최근 주목받는 Maximal Update Parametrization(µP)이 폭 스케일링에서 하이퍼파라미터를 안정적으로 전이시킬 수 있음을 기반으로, 깊이 스케일링에 대한 이론적 공백을 메우고자 한다. 이를 위해 저자들은 비재귀(feed‑forward) 다경로 네트워크를 그래프 형태로 모델링하고, 입력에서 출력까지의 최소 경로 길이를 “효과적 깊이(effective depth)”라 정의한다. 이 정의는 단순히 레이어 수가 아니라 잔차 추가(residual addition)까지 포함하므로, ResNet이나 Transformer와 같이 여러 병렬 경로와 잔차 연결을 갖는 구조에서도 일관된 깊이 척도를 제공한다.

이후 두 가지 핵심 가정을 설정한다. 첫째, “안정화 초기화(stabilizing initialization)”는 기존의 fan‑in(He) 초기화와 잔차 블록에 대한 1/√K 스케일링을 결합한 형태로, 깊이가 증가해도 전방 및 역전파 신호가 폭발·소멸하지 않도록 보장한다. 둘째, “최대 업데이트 기준(maximal‑update criterion)”은 전체 네트워크가 한 스텝에서 평균적으로 가장 큰 표현 변화(Δz)를 일으키면서도 수치적 불안정성을 피하도록 학습률을 조정한다. 이를 수학적으로는 모든 파라미터에 대해 업데이트 에너지(η²‖∇θL‖²)의 총합이 일정한 상수와 비례하도록 설정한다.

이 두 가정을 바탕으로 저자들은 각 아키텍처별로 전형적인 한 스텝 전 업데이트 크기를 평균적으로 분석한다. MLP와 동질적인 CNN에서는 각 레이어가 독립적인 경로를 형성하므로, 전 업데이트 크기가 깊이 L에 대해 Θ(L⁻³/₂)로 감소한다는 기존 결과를 재현한다. 잔차 네트워크에서는 각 블록이 두 개의 경로(직접 경로와 잔차 경로)를 병합하므로, 효과적 깊이가 블록 수 K와 동일하게 정의된다. 동일한 최대 업데이트 기준을 적용하면, 블록당 업데이트 크기가 K⁻³/₂로 스케일링됨을 보인다. Transformer는 한 블록당 두 개의 잔차 추가(Attention + Feed‑Forward)를 포함하므로, 효과적 깊이는 2·B (B는 블록 수)이며, 결과적으로 학습률은 (2B)⁻³/₂, 즉 B⁻³/₂와 동일한 스케일을 따른다.

핵심 정리는 “학습률 η∗ ∝ (effective depth)⁻³/₂”라는 보편적인 파워 법칙이다. 이 법칙은 아키텍처별 상수(예: 채널 수, 헤드 수, 활성화 함수에 따른 q값)만을 제외하고는 동일하게 적용된다. 따라서 작은 모델(폭·깊이 모두 축소)에서 최적 학습률을 찾은 뒤, 해당 η∗에 효과적 깊이 비율을 적용하면 큰 모델에서도 거의 최적에 가까운 학습률을 제로샷으로 전이할 수 있다.

실험 부분에서는 CIFAR‑10/100, ImageNet, WMT 번역 데이터셋 등 다양한 도메인에서 CNN, ResNet‑50/101, Vision Transformer, BERT‑style Transformer 등을 대상으로 자동 학습률 탐색 파이프라인을 구축했다. 각 깊이·폭 조합에 대해 실제 최적 학습률을 측정하고, 제안된 -3/2 파워 법칙에 로그‑로그 회귀를 적용했을 때 R²≈0.98 이상의 높은 적합도를 보였다. 또한, 법칙에 따라 전이된 학습률을 사용했을 때 손실 수렴 속도와 최종 정확도는 직접 튜닝한 경우와 통계적으로 유의미한 차이가 없었으며, 특히 2배·4배 깊이 확대 상황에서 학습률 재조정 없이도 안정적인 학습이 가능했다.

한계점도 명시한다. 매우 깊은(>2000 레이어) 모델에서는 잔차 스케일링과 정규화(LayerNorm, BatchNorm)의 상호작용이 추가적인 상수를 유발할 수 있으며, 학습률 외에도 가중치 감쇠, warm‑up 스케줄 등 다른 하이퍼파라미터도 깊이에 따라 보정이 필요할 수 있다. 또한, 비선형 활성화가 ReLU가 아닌 경우(q값이 달라짐) 상수 조정이 필요하지만, 파워 지수 자체는 변하지 않는다.

결론적으로, 이 논문은 “깊이 스케일링을 위한 보편적인 하이퍼파라미터 전이 법칙”을 제시함으로써, 대규모 모델 개발 시 반복적인 학습률 튜닝 비용을 크게 절감하고, 설계 단계에서 폭·깊이 변화를 보다 체계적으로 탐색할 수 있는 이론적·실험적 토대를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기