감시용 얼굴 이미지 품질 평가: 다차원 데이터셋과 경량 모델

초록

본 논문은 실시간 감시 환경에서 얼굴 이미지의 시각적 품질과 신원 보존(피델리티)을 동시에 평가할 수 있는 최초의 벤치마크 SFIQA‑Bench(5,004장)와, 세 가지 얼굴 뷰를 교차‑주의 메커니즘으로 통합하고 학습 가능한 태스크 토큰으로 다차원 품질 점수를 회귀하는 경량 모델 SFIQA‑Assessor를 제안한다. 실험 결과, 제안 모델은 기존 일반 IQA·FIQA 방법들을 크게 앞서며 실시간 적용이 가능함을 입증한다.

상세 분석

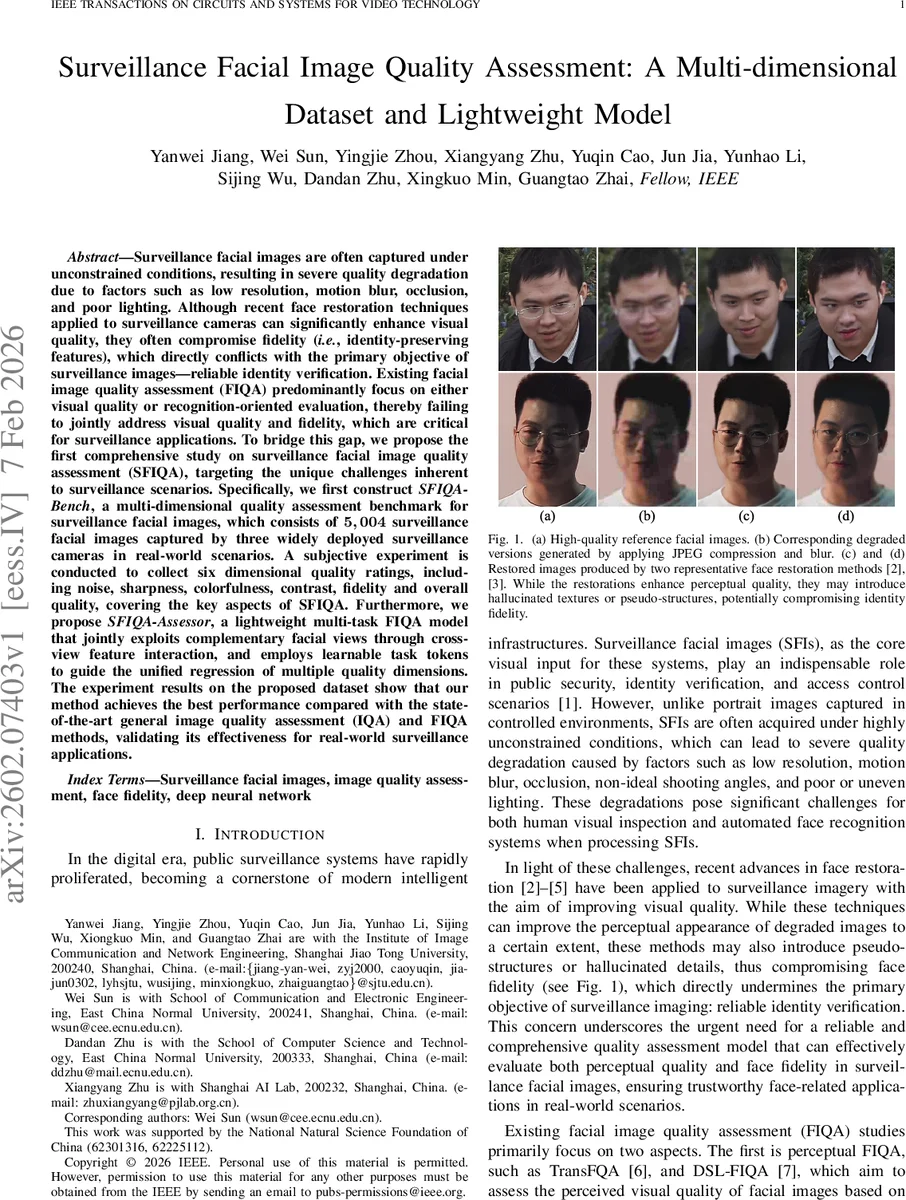

본 연구는 감시 카메라가 생성하는 얼굴 이미지가 저해상도, 블러, 조명 부족, 가림 등 복합적인 왜곡에 노출되는 현실적인 문제를 인식하고, 기존 FIQA 연구가 시각적 품질 혹은 인식 성능 중 하나에만 초점을 맞추는 한계를 짚어냈다. 이를 해결하기 위해 저자들은 먼저 세 종류의 상용 감시 카메라(실내 인물, 실외 보행자, ITS 차량 탑승자)에서 촬영된 5,004장의 실제 감시 얼굴 이미지를 수집하고, 100명의 참여자를 대상으로 6가지 차원(노이즈, 선명도, 색채감, 대비, 피델리티, 전체 품질)에 대한 주관적 점수를 최소 25명씩 부여하는 대규모 주관 실험을 설계했다. 특히 ‘피델리티’ 차원을 도입해 복원·강화 알고리즘이 초래할 수 있는 인위적 텍스처나 가짜 구조가 신원 보존에 미치는 영향을 정량화했다는 점이 혁신적이다.

모델 설계 측면에서 SFIQA‑Assessor는 (1) 원본 이미지, (2) 얼굴 전체를 크롭한 이미지, (3) 눈·입 부위를 강조한 이미지라는 세 가지 보완적인 뷰를 입력으로 받아, 각각에 대해 다중 스케일 CNN 기반 인코더를 적용한다. 이후 경량화된 Cross‑View Attention 모듈이 세 뷰 간 상호작용을 학습해 통합된 품질 표현을 생성한다. 이 표현은 (a) Task Self‑Attention을 통해 태스크 간 관계를 모델링하고, (b) 학습 가능한 Task Token을 Query로 사용해 Cross‑Attention을 수행함으로써 각 품질 차원에 특화된 특징을 추출한다. 마지막으로 6개의 회귀 헤드를 두어 연속적인 품질 점수를 출력한다.

경량성을 위해 전체 파라미터 수와 FLOPs를 최소화했으며, 실험에서는 30 FPS 이하의 GPU 환경에서도 실시간 추론이 가능함을 확인했다. 성능 평가에서는 기존 일반 IQA(PI, NIQE 등)와 최신 FIQA(TransFQA, DSL‑FIQA, CLIB‑FIQA 등)를 동일 데이터셋에 적용했을 때, SRCC·PLCC 모두 0.05~0.12 포인트 상승하는 등 전반적인 우수성을 보였다. 특히 ‘피델리티’ 점수에서 기존 인식‑지향 FIQA가 과대평가하는 경향을 보이는 반면, 제안 모델은 인간 주관 점수와 높은 상관관계를 유지한다.

이러한 설계는 (1) 감시 환경 특유의 복합 왜곡을 정밀히 포착, (2) 복원·강화 과정에서 발생할 수 있는 신원 왜곡을 정량화, (3) 실시간 시스템에 적용 가능한 경량 구조를 제공한다는 세 축에서 실용적·학문적 기여가 크다. 향후 연구에서는 더 다양한 카메라 모델과 악조건(극한 조명, 급격한 움직임)으로 확장하고, 멀티모달(음성·행동) 정보와 결합한 종합 신원 검증 프레임워크로 발전시킬 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기