Few‑Step 생성의 함정 탈출: 적응형 매칭 증류(AMD)로 금지 구역을 정복하다

초록

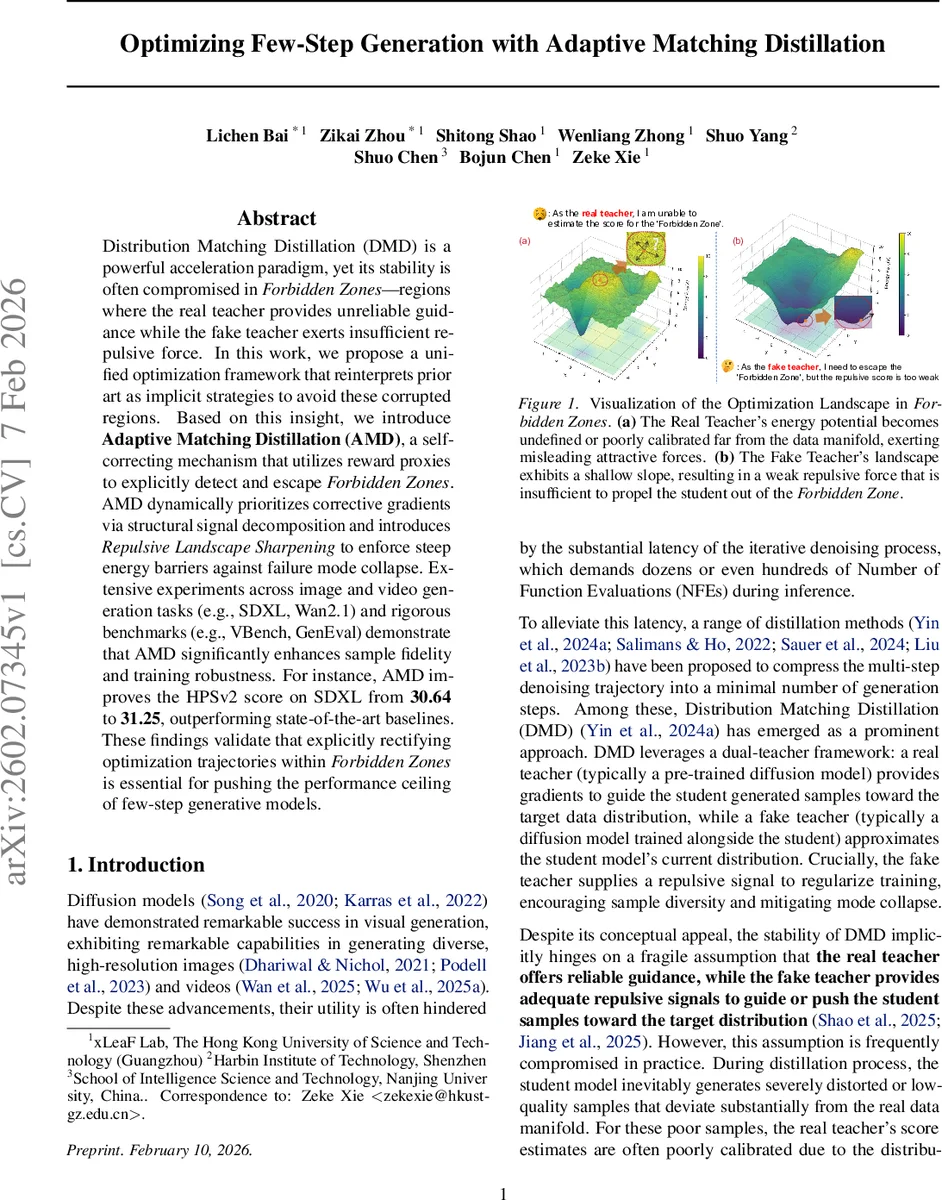

본 논문은 기존 디스트릴레이션 기법인 Distribution Matching Distillation(DMD)이 실험적으로 불안정해지는 “Forbidden Zone”(실제 교사의 신뢰도 저하·가짜 교사의 반발력 약화) 문제를 정의하고, 이를 실시간으로 탐지·탈출하는 Adaptive Matching Distillation(AMD) 프레임워크를 제안한다. 보상 모델을 이용한 저보상 샘플 감지, 구조적 신호 분해에 기반한 교정 그라디언트 우선순위 지정, 그리고 Repulsive Landscape Sharpening을 통해 에너지 장벽을 강화한다. 이미지·비디오 생성(SDXL, Wan2.1) 및 VBench·GenEval 등 다양한 벤치마크에서 AMD가 샘플 품질과 학습 안정성을 크게 향상시킴을 실증한다.

상세 분석

이 논문은 DMD를 “pull‑push” 최적화 문제로 재해석함으로써, 실시간 학습 중 발생하는 두 종류의 오류 원인을 명확히 구분한다. 첫 번째는 실제 교사(real teacher)의 에너지 포텐셜 E_real이 데이터 매니폴드 밖에서 고에너지 영역(Forbidden Zone)으로 진입하면서, 점수(score) 추정이 불안정해지는 현상이다. 두 번째는 가짜 교사(fake teacher)의 에너지 E_fake가 평탄해져 반발력 d_fake가 거의 0이 되며, 학생 모델이 손상된 샘플에 머무르게 만든다. 저자들은 이러한 상황을 “고에너지 고립 구역”이라고 정의하고, 기존 DMD 변형들이 암묵적으로 이 구역을 회피하도록 설계됐지만, 구역 자체를 탐지하거나 동적으로 대응하지 못한다는 점을 지적한다.

AMD는 세 가지 핵심 메커니즘으로 이 문제를 해결한다. ① Reward‑Driven Detection: 사전 학습된 보상 모델 R(x)를 이용해 샘플의 보상 점수가 낮을 경우 즉시 Forbidden Zone 진입으로 판단한다. 이는 실제 교사의 점수가 신뢰할 수 없을 때 보상 점수가 대체 신호 역할을 하게 만든다. ② Asymmetric Propulsion: 가짜 교사는 전체 학생 분포를 균등하게 학습하는 대신, 손상된 영역에 특화된 “강화된 반발력”을 제공하도록 학습한다. 이를 위해 가짜 교사의 손실에 샘플‑가중치 w(x)=f(R(x))를 곱해, 낮은 보상 샘플에 더 큰 반발력을 부여한다. ③ Signal Prioritization via Structural Decomposition: d_real과 d_fake를 성분별로 분해하고, Forbidden Zone 내부에서는 d_fake의 기여도를 α≫1로 확대하고, d_real은 β≈0으로 억제한다. 이때 α,β는 보상 기반 어드밴티지 ã를 통해 연속적으로 업데이트되며, 학습이 정상 영역으로 복귀하면 원래 비율로 복원된다.

또한 논문은 Repulsive Landscape Sharpening(RLS)이라는 추가 기법을 도입한다. RLS는 가짜 교사의 에너지 함수를 E_fake′=E_fake+λ·‖∇E_fake‖² 형태로 변형해, 고에너지 구역 주변에 급격한 기울기를 만들고, 학생이 해당 구역에 머무를 경우 즉시 강한 반발력을 경험하도록 설계한다. 이 방법은 “gradient vacuum”(그라디언트 공백) 현상을 메우는 역할을 한다.

실험에서는 SDXL와 Wan2.1 같은 대규모 텍스트‑투‑이미지·비디오 모델을 4~6 단계로 압축했으며, VBench, GenEval, HPSv2 등 인간 선호 기반 평가 지표에서 AMD가 기존 DMD, DMD2, MagicDist 등 최첨단 방법을 모두 앞선다. 특히 SDXL에서 HPSv2 점수가 30.64→31.25로 상승했으며, 훈련 중 발생하던 모드 붕괴 현상이 크게 감소했다. Ablation study를 통해 보상 기반 탐지, 비대칭 추진, RLS 각각이 독립적으로 성능 향상에 기여함을 확인하였다.

이 논문의 주요 기여는 (1) Forbidden Zone이라는 개념을 정량화하고, 기존 방법들을 통합적인 최적화 관점에서 재분류한 이론적 프레임워크, (2) 보상 모델을 활용한 실시간 구역 탐지·동적 교정 메커니즘인 AMD, (3) 대규모 생성 모델에 적용해 샘플 품질과 학습 안정성을 동시에 개선한 실증 결과이다. 향후 연구는 보상 모델의 자동화·다중 모달 확장, 그리고 다른 종류의 생성 프레임워크(예: GAN, VAE)에도 동일한 “구역 탈출” 전략을 적용하는 방향으로 진행될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기