OPUS: 최적화기 기반 데이터 선택으로 대규모 언어 모델 사전학습 효율 극대화

초록

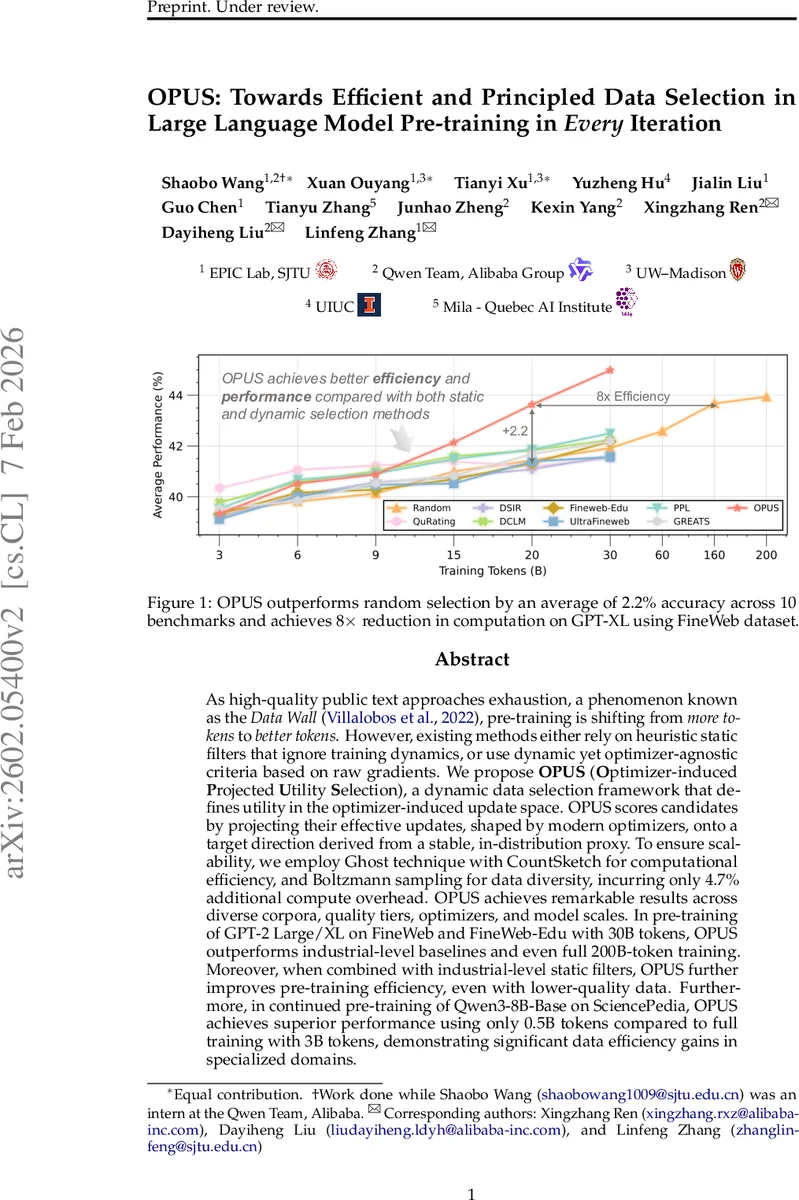

OPUS는 최신 적응형 옵티마이저(AdamW, Muon)의 업데이트 방향에 맞춰 데이터를 동적으로 선택하는 프레임워크이다. 후보 샘플의 효과적 업데이트를 프록시 분포의 하강 방향에 투영해 유틸리티를 점수화하고, Ghost 기법·CountSketch로 비용을 낮추며 Boltzmann 샘플링으로 다양성을 유지한다. 실험에서 GPT‑2 Large/XL과 Qwen3‑8B에 4.7 % 정도의 추가 연산만으로 2 %‑2.2 % 정확도 향상 및 8배 연산 절감 효과를 보였다.

상세 분석

OPUS는 “데이터 월(Data Wall)”이라 불리는 고품질 공개 텍스트 고갈 상황에서, 토큰 수가 아닌 토큰 품질을 최적화하는 새로운 접근법을 제시한다. 기존 정적 필터는 훈련 단계와 무관하게 한 번만 데이터를 평가하고, 동적 방법은 원시 그래디언트(즉, SGD 가정)만을 이용해 샘플을 선택한다는 한계가 있다. OPUS는 이러한 문제점을 해결하기 위해 두 가지 핵심 아이디어를 도입한다. 첫째, 데이터 유틸리티를 옵티마이저‑유도 업데이트 공간에 정의한다. 즉, 각 샘플이 현재 파라미터와 옵티마이저 상태에서 실제로 적용되는 업데이트(예: AdamW의 1차 모멘텀·2차 스케일링, Muon의 이중 스무딩)를 계산하고, 이를 사전 정의된 프록시 분포(고품질 검증 데이터 혹은 벤치마크와 유사한 샘플 집합)의 하강 방향에 투영한다. 투영값이 클수록 해당 샘플이 목표 분포의 손실 감소에 크게 기여한다는 의미이며, 이는 기존의 “큰 손실” 혹은 “큰 그래디언트” 기준보다 옵티마이저의 실제 움직임과 일치한다.

둘째, 대규모 LLM 환경에서 per‑sample 그래디언트를 직접 구하는 비용을 회피하기 위해 Ghost 기법과 CountSketch를 결합한다. Ghost 기법은 레이어별 중간 활성화를 재사용해 근사 그래디언트를 얻고, CountSketch는 고차원 벡터를 저차원 해시 공간으로 압축해 내적 연산을 O(1) 수준으로 만든다. 이렇게 하면 수십억 토큰 규모의 코퍼스에서도 실시간으로 유틸리티를 추정할 수 있다.

다양성 유지 측면에서 OPUS는 Boltzmann 샘플링을 적용한다. 단순히 유틸리티가 높은 상위 K개를 선택하면 데이터 중복과 편향이 발생할 수 있는데, 온도 파라미터와 현재 선택된 배치와의 중복 페널티를 결합해 확률적으로 샘플을 뽑음으로써 다양성을 보존한다.

실험에서는 (1) GPT‑2 Large/XL을 FineWeb·FineWeb‑Edu 데이터셋에서 30 B 토큰만 사용해 산업 수준의 정적 필터와 기존 동적 선택기보다 우수한 성능을 달성했으며, (2) 동일 토큰 양으로 200 B 토큰 전체 학습을 능가하는 결과를 얻었다. 또한, OPUS를 정적 필터와 결합하면 저품질 데이터에서도 효율이 향상된다. (3) Qwen3‑8B‑Base을 SciencePedia에 0.5 B 토큰만으로 계속 사전학습했을 때, 3 B 토큰 전체 학습 대비 동일하거나 더 높은 벤치마크 점수를 기록했다. 전체 연산 오버헤드는 4.7 %에 불과했으며, 8배 가량의 연산 절감 효과를 보고했다.

이러한 결과는 옵티마이저‑인식 유틸리티 정의, 스케일러블 근사 추정, 다양성 보존 샘플링이라는 세 축이 결합될 때, 대규모 언어 모델 사전학습에서 토큰 효율성을 크게 높일 수 있음을 입증한다. OPUS는 향후 데이터 품질이 한계에 다다른 상황에서, 모델‑옵티마이저 상호작용을 고려한 데이터 선택이 표준이 될 가능성을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기