스토리캐스터: 방을 무대로 하는 AI 기반 몰입형 스토리텔링 시스템

초록

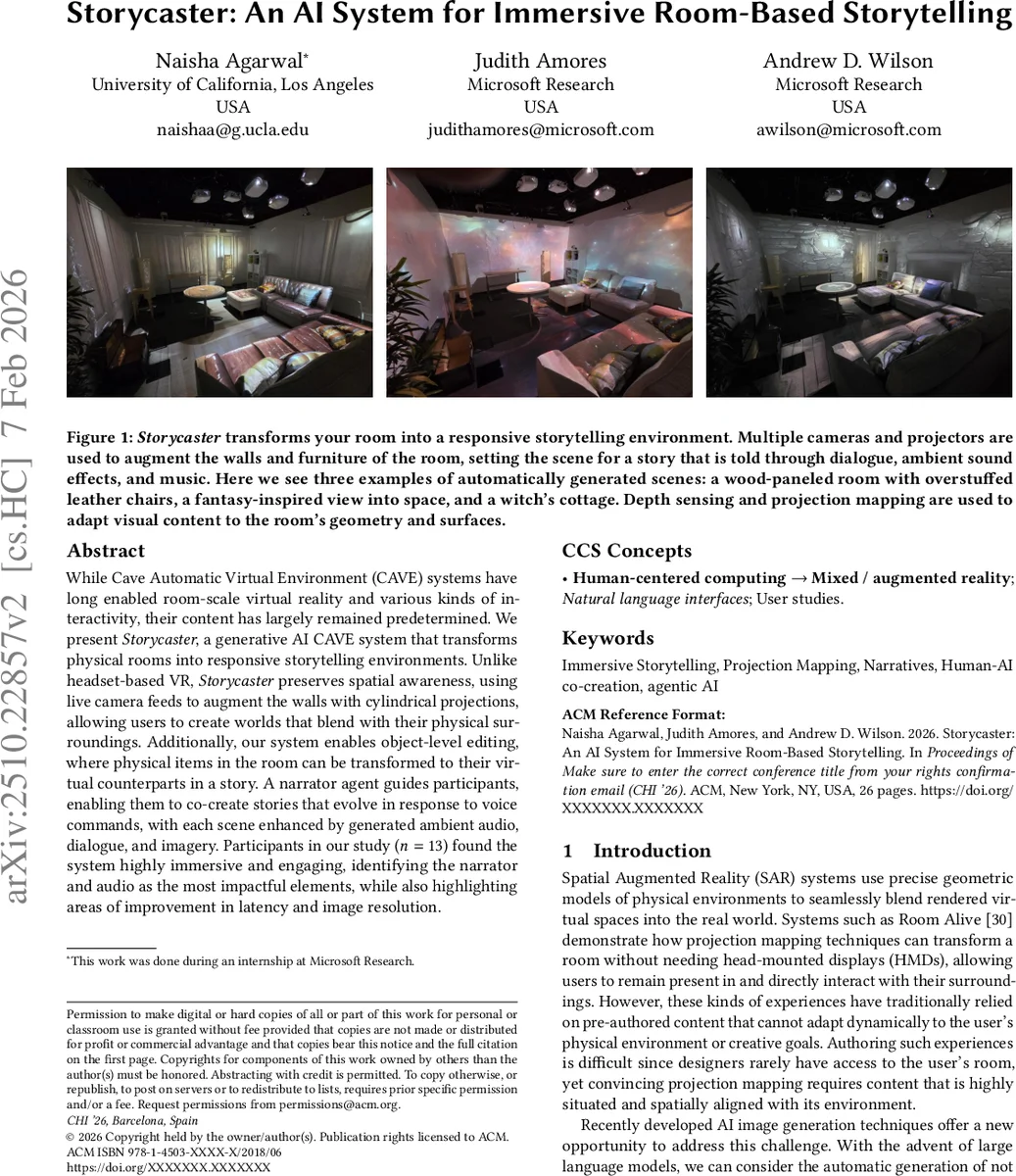

Storycaster는 CAVE 기반의 공간 증강 현실에 대형 언어 모델과 이미지·음향 생성 모델을 결합해, 사용자의 음성 명령에 따라 실시간으로 방 전체를 스토리 배경으로 변환한다. 실시간 카메라와 깊이 센서를 이용해 원통형 투사 영상을 생성하고, 물체 수준 편집과 내러티브 진행을 담당하는 AI 내레이터 에이전트를 제공한다. 13명의 참여자를 대상으로 한 사용자 연구에서 높은 몰입감과 내레이터·음향의 긍정적 효과가 확인되었으며, 지연 및 해상도 개선이 향후 과제로 제시되었다.

상세 분석

Storycaster는 기존 CAVE 시스템이 제공하는 방 규모의 시각적 몰입성을 유지하면서, 생성형 AI를 통해 동적인 스토리 콘텐츠를 실시간으로 생산한다는 점에서 혁신적이다. 시스템은 크게 세 가지 핵심 모듈로 구성된다. 첫 번째는 이미지 생성 파이프라인으로, 실시간 깊이 카메라와 RGB 카메라에서 획득한 360° 원통형 뷰를 입력으로 받아 SDXL + Depth‑Control Net + Cylindrical LoRA를 활용해 텍스트 프롬프트에 맞는 고해상도 원통형 이미지를 생성한다. 생성된 이미지는 프로젝터를 통해 방의 벽과 가구에 매핑되며, 투사 왜곡을 최소화하기 위해 사전 캘리브레이션된 기하학적 모델이 사용된다. 두 번째는 내러티브 관리와 음성 인터페이스를 담당하는 Narrator Agent이다. 사용자의 음성은 Azure Speech‑to‑Text로 텍스트화된 뒤, GPT‑4.1 기반 프롬프트 엔진에 전달되어 스토리 플롯, 대사, 장면 전환 명령을 생성한다. 에이전트는 또한 Stability Audio 1.0을 호출해 상황에 맞는 입체 음향을 제작하고, Dolby Atmos 시스템을 통해 방 안의 위치 기반으로 재생한다. 세 번째는 물체 수준 편집 모듈이다. 원통형 이미지에서 Grounded‑SAM을 이용해 물체를 세그멘테이션하고, SD 1.5 인페인팅을 적용해 물체에 가상의 오버레이를 입힌다. 이렇게 변환된 텍스처는 다시 프로젝터에 매핑되어 물리적 객체가 스토리 내의 마법 아이템이나 배경 요소로 전환된다.

시스템 설계상의 주요 강점은 (1) 사용자 인지 부하를 최소화한 음성‑우선 인터페이스, (2) 물리적 공간 인식을 유지하면서도 완전한 시각·청각 변형을 제공하는 투사 매핑, (3) LLM과 멀티모달 생성 모델을 연동해 스토리, 이미지, 사운드를 일관되게 동기화한다는 점이다. 그러나 한계점도 명확하다. 현재 파이프라인은 이미지·음향 생성에 평균 2–3초의 지연을 보이며, 이는 실시간 인터랙션에 부정적 영향을 미친다. 또한 원통형 투사 해상도가 1080p 수준에 머물러, 세밀한 텍스처 표현에 한계가 있다. 물체 편집 단계에서 Grounded‑SAM의 세그멘테이션 정확도가 조명 변화에 민감해, 복잡한 실내 환경에서는 오류가 발생한다. 사용자 연구에서는 내레이터와 배경음악이 몰입도에 가장 크게 기여했지만, 일부 참가자는 “가상 이미지가 실제 물체와 어색하게 겹친다”는 의견을 제시했다. 이는 투사와 물체 깊이 매핑 간의 정밀도 향상이 필요함을 시사한다.

전반적으로 Storycaster는 생성형 AI와 공간 증강 현실을 결합한 최초의 방 규모 스토리텔링 플랫폼으로, 향후 하드웨어 가속, 모델 경량화, 그리고 사용자 맞춤형 프롬프트 설계 등을 통해 실시간성 및 시각 품질을 개선한다면 교육·엔터테인먼트·치료 분야에서 폭넓은 활용 가능성을 열어줄 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기