경험 기반 가이드라인 숲: 검색 강화 추론 프레임워크

초록

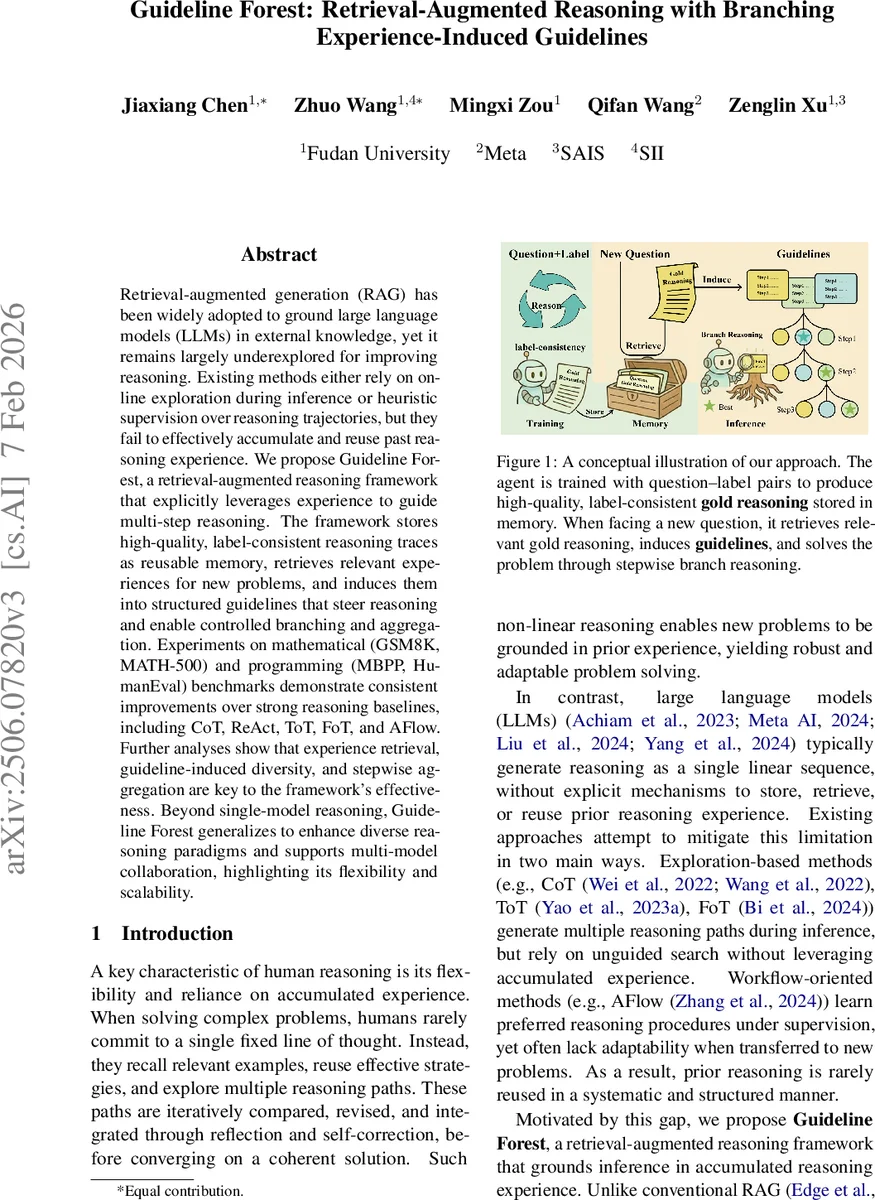

Guideline Forest는 검증된 추론 트레이스를 메모리로 저장하고, 새로운 문제에 대해 유사한 경험을 검색해 구조화된 가이드라인을 생성한다. 이 가이드라인은 다중 분기 추론을 유도하고, 단계별 집계 메커니즘으로 가장 유망한 흐름을 선택한다. 수학(GSM8K, MATH‑500)과 코딩(MBPP, HumanEval) 벤치마크에서 기존 CoT·ReAct·ToT·FoT·AFlow 등을 능가하는 성능을 보이며, 모델 규모에 따라 효과가 증대하고 다중 모델 협업에도 자연스럽게 확장된다.

상세 분석

Guideline Forest는 기존 RAG(검색‑증강 생성)와 추론 프레임워크를 결합해 ‘경험’이라는 새로운 검색 대상에 초점을 맞춘다. 학습 단계에서 모델은 체인‑오브‑생각(Chain‑of‑Thought, CoT) 프롬프트로 초기 추론을 생성하고, 정답이 나오지 않을 경우 라벨‑가이드 생성(label‑guided generation)을 통해 정답 라벨을 조건으로 삼아 논리적 일관성을 유지하면서 올바른 추론을 재생성한다. 이렇게 검증된 고품질 트레이스는 메모리 저장소에 축적되며, 메모리 성장과 함께 자체적인 피드백 루프를 형성한다.

추론 시에는 임베딩 기반 유사도 검색을 통해 K개의 관련 사례를 회수하고, 각 사례의 트레이스를 추상화해 ‘가이드라인’이라는 고수준 계획을 만든다. 가이드라인은 구체적인 답안을 담고 있지 않지만, 문제 해결에 필요한 일반적인 단계 흐름(예: “문제 정의 → 식 세우기 → 계산 → 검증”)을 담고 있다. 다중 분기 추론에서는 각 가이드라인이 독립적인 분기(branch)를 제시하고, 매 단계마다 각 분기의 후보 단계(ẑ)들을 생성한다. 이후 confidence‑score 기반 투표 혹은 확률적 집계(Pθ)로 가장 신뢰도 높은 후보를 선택해 전체 추론 흐름에 반영한다. 이 단계별 집계는 탐색 공간을 무분별하게 확장하지 않으면서도 다양한 해법을 동시에 검증할 수 있게 해준다.

또한, Guideline Forest는 다중 모델 협업을 자연스럽게 지원한다. 서로 다른 LLM이 각각 다른 가이드라인을 따라 추론하고, 최종 단계에서 모델별 가중치를 적용한 투표로 결과를 합산한다. 이는 개별 모델의 편향을 상쇄하고, 서로 보완적인 추론 능력을 활용한다는 점에서 기존 Self‑Consistency이나 Tree‑of‑Thought와 차별화된다.

실험 결과는 네 가지 벤치마크에서 일관된 향상을 보여준다. GSM8K에서는 93.5%의 solve rate, MATH‑500에서는 69.2%를 기록했으며, HumanEval에서는 95.4%의 pass@1을 달성했다. 특히, 코드 생성 벤치마크인 MBPP에서는 AFlow에 근소히 못 미치지만(81.6% vs 83.4%) 다른 모든 방법보다 앞섰다. 모델 규모에 따른 스케일링 실험에서도 GPT‑4o가 가장 높은 성능을 보이며, Guideline Forest가 대형 모델의 추론 능력을 효과적으로 증폭시킨다. 토큰 사용량 측면에서도 ToT(7.2k)·ReAct(5.4k)보다 다소 높지만(12.6k) MCTS 기반 AFlow(21.8k)보다 효율적이다.

핵심 기여는 세 가지이다. 첫째, 추론 트레이스를 ‘경험’이라는 형태로 저장·재사용함으로써 RAG를 지식 검색에서 추론 검색으로 확장했다. 둘째, 라벨‑가이드 생성과 구조화된 가이드라인 유도 과정을 통해 고품질, 라벨‑일관성 있는 트레이스를 자동으로 확보했다. 셋째, 다중 분기·단계별 집계·다중 모델 협업이라는 세 가지 메커니즘을 결합해 추론의 정확성, 효율성, 해석 가능성을 동시에 개선했다. 이러한 설계는 향후 복합적인 문제 해결, 도메인‑특화 추론, 그리고 인간‑기계 협업 시스템에 적용될 잠재력을 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기