시각장애인도 직접 만드는 오디오디스크립션 ADCanvas

초록

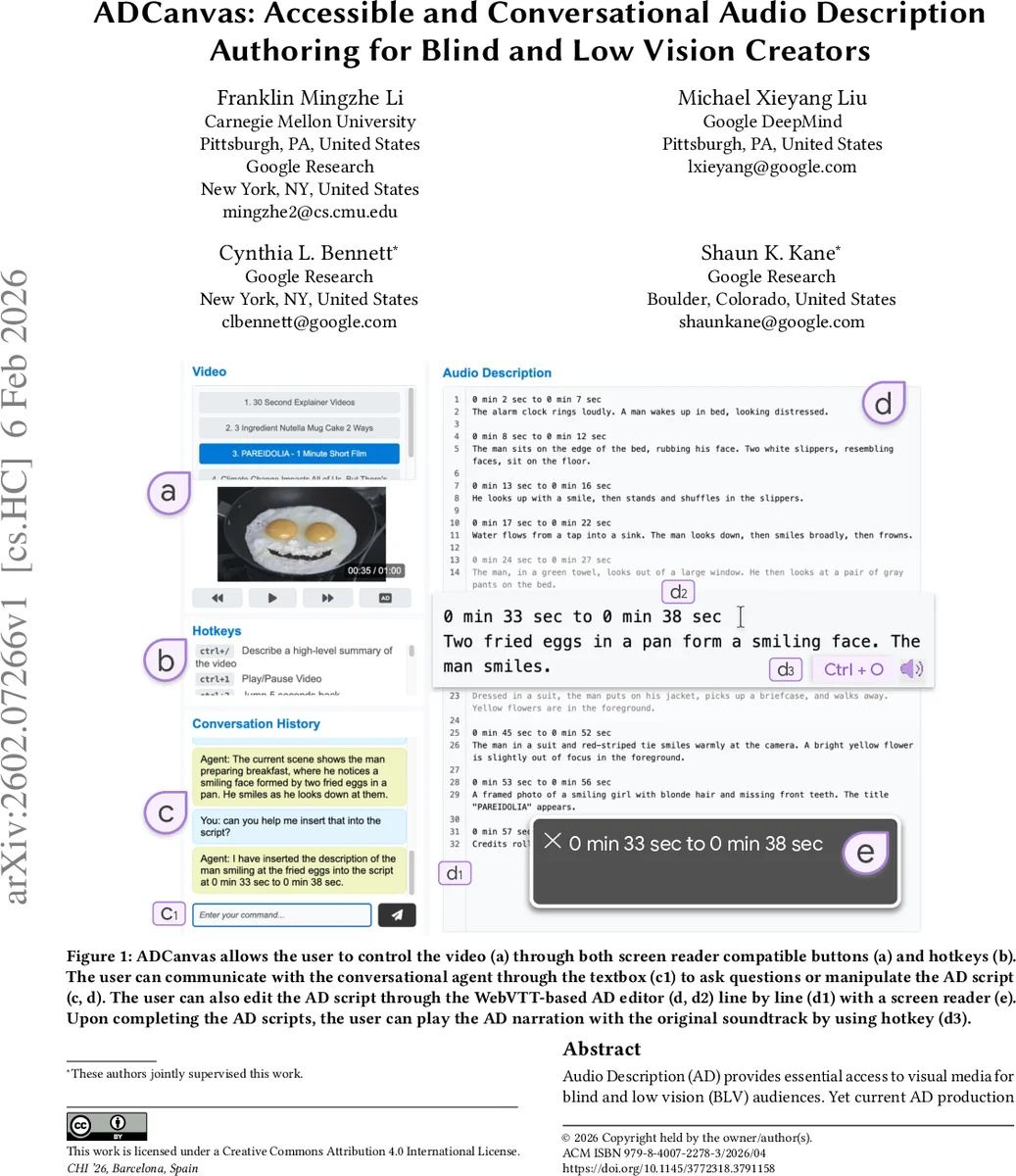

ADCanvas는 화면읽기기능과 키보드 단축키를 활용해 시각장애인(Blind & Low Vision) 창작자가 비주얼 질문‑응답(VQA)과 대화형 LLM을 통해 오디오디스크립션(AD) 스크립트를 비시각적으로 작성·편집·재생할 수 있게 하는 멀티모달 저작 도구이다. 12명의 BLV 창작자를 대상으로 한 사용자 연구에서, 참가자들은 AI 에이전트를 “정보 제공자·초안 작성 도우미”로 활용하면서도 최종 내용은 직접 검증·수정함으로써 높은 창작 주도성을 유지했다. 연구 결과는 정밀 편집 제어, 창작 아이디에이션 지원, 인간‑AI 협업 규칙 설정 등의 설계 시사점을 제시한다.

상세 분석

본 논문은 시각장애인 창작자를 위한 오디오디스크립션(AD) 저작 환경의 접근성 문제를 근본적으로 재설계한다는 점에서 의미가 크다. 기존의 DAW·비디오 편집 툴은 타임라인, 파형, 드래그‑앤‑드롭 등 시각적 은유에 의존해 화면읽기 프로그램으로는 탐색이 불가능했다. ADCanvas는 이러한 시각적 의존성을 완전히 배제하고, 두 개의 독립적인 인터페이스—텍스트 기반 WebVTT 편집기와 키보드‑핫키 기반 미디어 제어 패널—를 제공한다. 특히, 화면읽기 친화적인 버튼과 hotkey(예: Ctrl + O, 재생/정지 단축키)로 비디오를 앞·뒤로 이동하고, 특정 타임스탬프에서 자동으로 AD 라인을 삽입·편집할 수 있다.

핵심 기술은 멀티모달 대형 언어 모델(MLLM)이다. 모델은 영상 프레임을 시각적으로 인식하고, 사용자가 텍스트 입력창에 질문을 하면 실시간 VQA를 수행한다. 예시 대화(‘주인공 요약’, ‘왜 표정이 우울한가’)에서 보듯, 모델은 시간코드와 장면 정보를 결합해 구체적인 시각 묘사를 제공한다. 사용자는 이 출력을 그대로 스크립트에 삽입하거나, “더 간결하게”, “표정에 집중해”와 같은 지시문으로 모델을 재조정한다. 즉, LLM은 단순 생성기가 아니라, 사용자가 정의한 스타일·가이드라인(예: 현재 시제 사용, 객관적 서술)과 피드백을 반영해 반복적으로 개선되는 공동 창작 파트너 역할을 한다.

사용자 연구는 12명의 BLV 창작자를 대상으로 2시간 이상 실제 영상에 대한 AD 스크립트를 작성하도록 설계되었다. 주요 발견은 다음과 같다. ① 대화형 에이전트는 정보 탐색과 초안 생성에서 ‘보조자’ 역할을 수행했으며, 사용자는 에이전트가 제공한 내용에 대해 ‘큐레이터’처럼 선별·수정했다. ② 키보드 기반 타임라인 탐색과 화면읽기 친화적 편집기가 정밀 제어를 가능하게 해, 타임코드 맞춤·구간 삽입이 원활했다. ③ 참가자들은 AI에 대한 신뢰와 검증 사이에서 균형을 잡으며, 최종 AD 품질에 대한 책임감을 유지했다. ④ 인터랙션 흐름에서 ‘에이전트와의 대화가 길어질수록 작업 흐름이 끊기고 피로도가 상승’하는 문제점이 드러났으며, 이는 대화 관리 UI와 자동 요약 기능을 통해 개선 가능함을 시사한다.

디자인 시사점으로는 (1) ‘미세 편집 제어’를 위한 키보드 단축키와 화면읽기 라벨링, (2) ‘창작 아이디에이션 지원’—예를 들어, 장면 요약·키워드 자동 추출 기능, (3) ‘인간‑AI 협업 규칙 설정’—사용자가 모델의 스타일·가이드라인을 사전에 정의하거나, 실시간 피드백을 통해 동적으로 조정할 수 있는 인터페이스 제공이 강조된다. 한계점으로는 현재 파형 기반 자동 간격 탐지·오디오 믹싱 등 고급 DAW 기능이 미포함되어 있어, 전문적인 포스트 프로덕션 단계에서는 기존 툴과 연계가 필요하다는 점을 언급한다. 향후 연구에서는 멀티모달 모델의 정확도 향상, 대화 흐름 관리 자동화, 그리고 커뮤니티 기반 협업 플랫폼과의 통합을 목표로 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기