경쟁 인식 스케일링을 통한 소프트맥스 추천 시스템 개선

초록

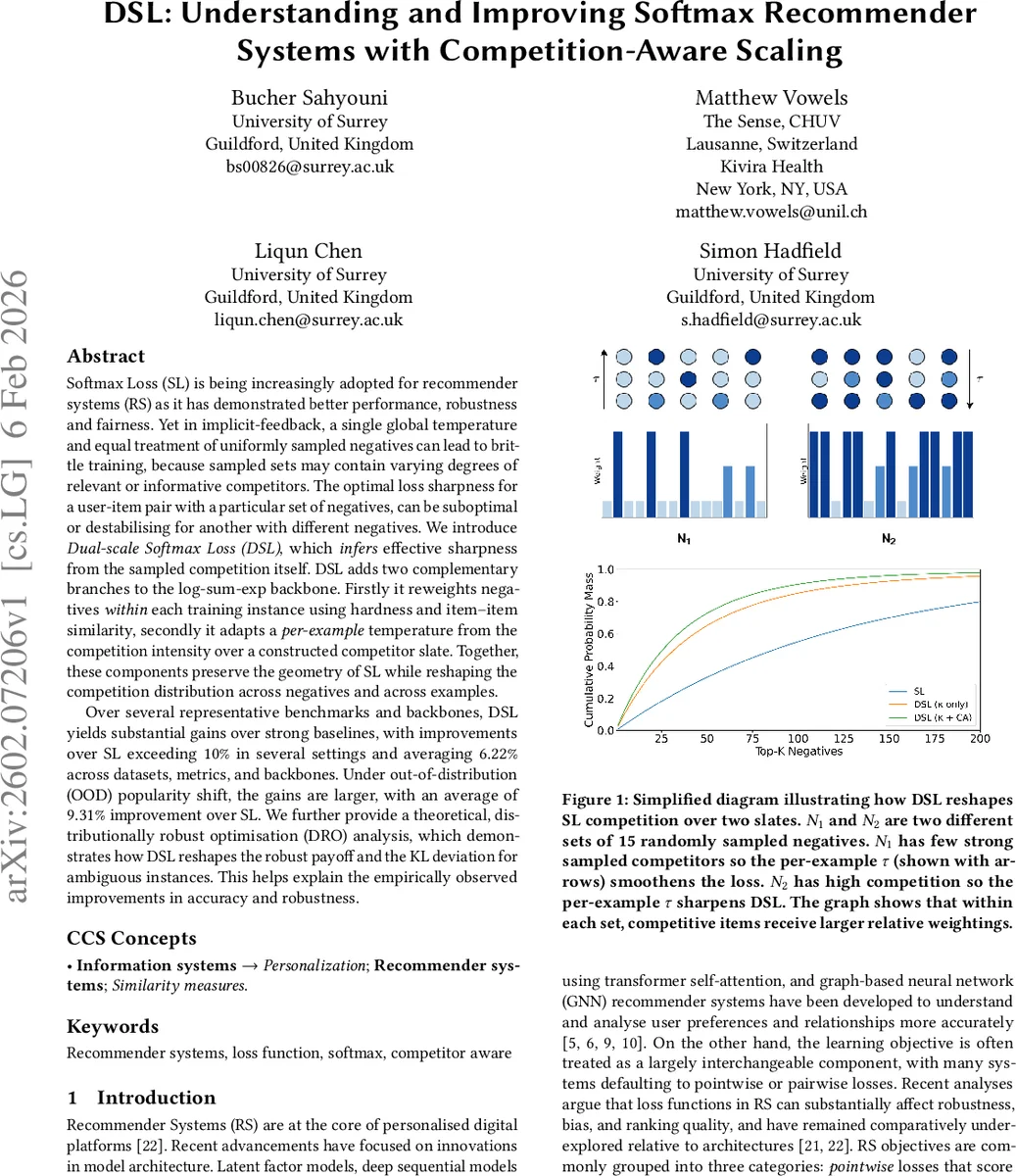

본 논문은 암묵적 피드백 기반 추천 시스템에서 소프트맥스 손실(SL)의 온도와 부정 샘플링이 초래하는 학습 불안정을 해결하기 위해, 샘플된 경쟁 정도를 직접 추정해 두 단계의 스케일링을 적용하는 Dual‑scale Softmax Loss(DSL)를 제안한다. DSL은 (1) 하드니스와 아이템‑아이템 유사도를 이용한 샘플별 가중치 κ와 (2) 경쟁 강도에 기반한 예제별 온도 조정 τ를 도입해 기존 SL의 기하학을 보존하면서 경쟁 분포를 재구성한다. 다양한 데이터셋·모델에 대해 평균 6.22%·최대 10% 이상의 성능 향상을 기록했으며, 인기 편향이 변하는 OOD 상황에서도 평균 9.31% 개선을 보였다. 또한 DRO 이론을 통해 DSL이 모호한 사례의 KL 편차와 강건한 페이오프를 재구성함을 설명한다.

상세 분석

DSL은 기존 소프트맥스 손실이 “전역 온도 τ 하나와 균등 샘플링된 부정”이라는 가정에 의존한다는 근본적인 한계를 짚어낸다. 암묵적 피드백에서는 사용자‑아이템 쌍마다 경쟁 풀(Negative Set)의 품질이 크게 달라지며, 일부 부정은 실제 경쟁자이지만 다른 대부분은 무관한 노이즈이다. 이러한 상황에서 고정 τ는 경쟁이 강한 경우에는 과도하게 샤프해져 학습이 불안정해지고, 경쟁이 약한 경우에는 과도하게 부드러워져 정보 손실이 발생한다. DSL은 두 가지 보완적인 메커니즘으로 이를 해결한다.

첫 번째 κ‑branch는 각 부정 j에 대해 하드니스 f(u,j)와 아이템‑아이템 유사도 s_ij를 결합해 ℓ_ij = f(u,j) + \bar{s}_{ij}를 만든 뒤, exp 정규화를 통해 평균 1인 양의 가중치 κ_ij를 산출한다. β 파라미터를 통해 가중치의 강도를 조절함으로써, “hard‑negative”와 “near‑miss” 부정을 자동으로 강조하고, 무관한 부정은 억제한다. κ_ij가 클수록 해당 부정에 대한 온도가 τ/κ_ij 로 낮아져 손실이 더 샤프해지고, 그래디언트가 집중된다.

두 번째 CA‑branch는 예제 수준에서 온도를 동적으로 조정한다. 각 (u,i) 쌍에 대해 현재 스코어가 높은 상위 K 부정들을 경쟁 슬레이트 C_ui 로 선정하고, 이들의 스코어를 확률 분포로 변환한다. 경쟁 슬레이트의 엔트로피 혹은 평균 스코어와 같은 통계량을 이용해 온도 보정 계수 α_ui 를 정의하고, 최종 온도 τ’_ui = τ·α_ui 로 설정한다. 경쟁이 치열한 경우 α_ui < 1 로 샤프해지며, 경쟁이 약한 경우 α_ui > 1 로 부드러워져 학습 안정성을 확보한다.

이 두 스케일링은 서로 독립적이면서도 상호 보완적으로 작동한다. κ‑branch는 동일 예제 내 부정 간 상대적 중요도를 재분배하고, CA‑branch는 예제 간 온도 차이를 반영한다. 중요한 점은 두 단계 모두 로그‑합‑지수(log‑sum‑exp) 구조를 그대로 유지하면서, 정규화된 가중치와 온도 보정만 추가한다는 점이다. 따라서 기존 SL 기반 파이프라인에 최소한의 연산 오버헤드만으로 적용 가능하다.

이론적 분석에서는 DSL을 분포적 강건 최적화(DRO) 관점에서 바라본다. 기존 SL은 KL 발산을 최소화하는 형태로, 모든 부정을 동일하게 고려한다. DSL은 κ와 α에 의해 효과적인 경쟁 분포 q̂ 를 재구성하고, 이 q̂ 와 원본 데이터 분포 p̂ 사이의 KL 편차를 감소시킨다. 특히 모호한(경쟁이 높은) 사례에서는 q̂ 가 실제 선택 집합에 더 가깝게 변형되어, 강건한 페이오프가 향상된다.

실험에서는 MF, LightGCN, SASRec 등 다양한 백본과 MovieLens, Amazon, Yelp 등 5개 공개 데이터셋을 사용했다. DSL은 모든 설정에서 SL 대비 평균 6.22% (HR@10, NDCG@10) 향상을 보였으며, 특히 인기 편향이 크게 변하는 OOD 테스트에서는 9.31% 평균 개선을 기록했다. Ablation study는 κ‑branch와 CA‑branch 각각이 독립적으로 2~4% 정도의 이득을 제공하고, 결합 시 시너지 효과가 나타남을 확인했다. 하이퍼파라미터 β와 K에 대한 민감도 분석도 제시해, 적절한 범위 내에서는 성능이 안정적임을 보였다.

요약하면, DSL은 “경쟁 인식 스케일링”이라는 새로운 패러다임을 제시함으로써, 기존 소프트맥스 손실이 갖는 전역 온도와 균등 부정 가정의 한계를 극복하고, 실제 추천 시스템에서 요구되는 정확도·강건성·공정성을 동시에 향상시킨다.

댓글 및 학술 토론

Loading comments...

의견 남기기