LLM 내부 활성화를 생성 모델로 학습하는 메타 모델

초록

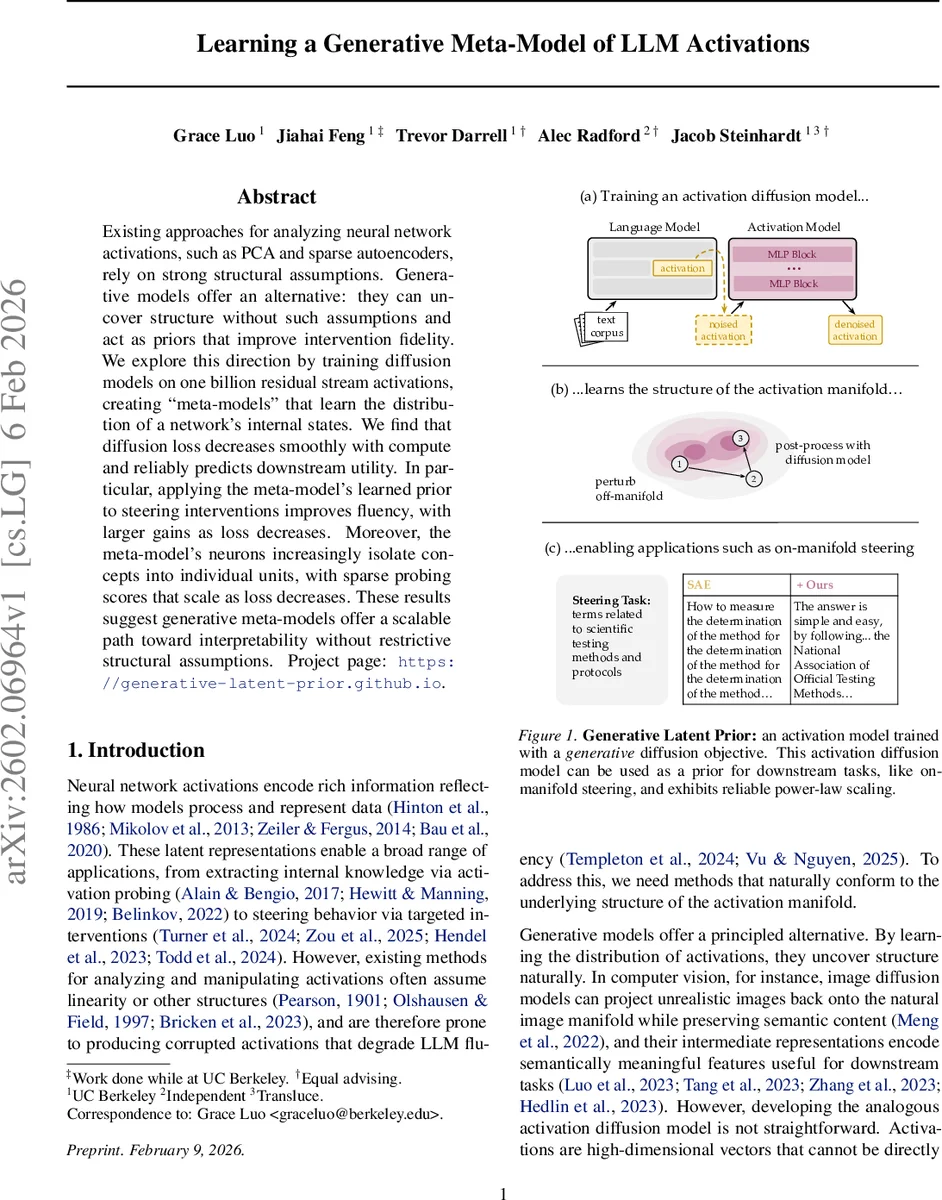

LLM의 내부 활성화 분포를 학습하는 생성 메타 모델(GLP)을 제안한다. 확산 모델을 활용한 이 접근법은 PCA나 희소 오토인코더와 같은 기존 방법의 강한 구조적 가정 없이도 활성화 매니폴드의 구조를 학습한다. 학습된 메타 모델은 사전 지식으로 작용하여 개입 기반 조정의 유창성을 높이고, 메타 뉴런을 통해 개념을 효과적으로 분리한다. 확산 손실은 계산량에 따라 부드럽게 감소하며, 이 손실 값이 하류 작업의 성능을 예측하는 지표로도 작용한다.

상세 분석

본 논문은 대규모 언어 모델(LLM)의 내부 표현(활성화)을 분석하는 새로운 패러다임을 제시한다. 기존의 PCA나 희소 오토인코더(SAE)는 선형성이나 희소성과 같은 강한 구조적 가정을 전제로 하여, 때로는 비자연스러운(off-manifold) 활성화를 생성해 LLM의 출력 유창성을 해치는 문제가 있었다. 이에 저자들은 생성 모델, 그 중에서도 확산 모델(Diffusion Model)을 LLM 활성화 데이터에 적용하여 이른바 ‘생성적 잠재 사전(Generative Latent Prior, GLP)’ 메타 모델을 구축했다. GLP는 약 10억 개의 잔류 스트림 활성화를 학습 데이터로 사용한다.

기술적 핵심은 Flow Matching을 활용한 확산 목적함수다. 이는 데이터 포인트와 노이즈를 선형 보간하는 전방 과정과, 학습된 신경망(Denoiser)이 노이즈로부터 원래 활성화를 복원하는 역방 과정으로 구성된다. Denoiser 아키텍처는 Llama3의 MLP 블록 설계를 차용했으며, 시간 스텝 조건화를 통해 확산 과정을 모델링한다.

이 모델의 강점은 몇 가지 실험 결과에서 드러난다. 첫째, 프레셰 거리(Frechet Distance)와 PCA 시각화를 통해 GLP가 생성한 샘플이 실제 활성화 분포와 거의 구분되지 않음을 확인했다. 이는 SAE 재구성보다 우수한 성능이다. 둘째, ‘델타 LM 손실’ 평가에서 GLP는 재구성을 목적으로 설계되지 않았음에도 불구하고 SAE보다 더 낮은 손실 증가(즉, 원본 모델 성능을 더 잘 보존)를 기록했다. 이는 GLP가 학습한 사전이 활성화 매니폴드 상의 자연스러운 점을 더 잘 보존함을 시사한다.

가장 주목할 만한 통찰은 스케일링 법칙이다. 모델 크기와 계산량을 증가시킬수록 확산 손실이 부드러운 멱법칙을 따라 감소했으며, 이 손실 곡선이 하류 작업 성능의 예측 변수로 작용했다. 즉, 확산 손실이 낮을수록 감정 제어와 같은 조정 작업에서의 유창성 향상 폭이 컸고, 1차원 탐색(1-D Probing)을 통한 개념 분리 정확도도 높아졌다. 이는 GLP가 계산 자원 투입에 따라 예측 가능하게 성능이 향상되는 ‘확장 가능한’ 해석 가능성 도구가 될 수 있음을 보여준다.

종합하면, 이 연구는 생성 모델이 LLM 내부 상태에 대한 강력한 사전 모델이 될 수 있음을 입증했다. 구조적 가정에 의존하지 않고 데이터 기반으로 매니폴드를 학습함으로써, 보다 자연스럽고 효과적인 활성화 조정 및 해석을 가능하게 하는 새로운 길을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기