온라인 구조 프루닝으로 대형 기초 모델 효율적 추론

초록

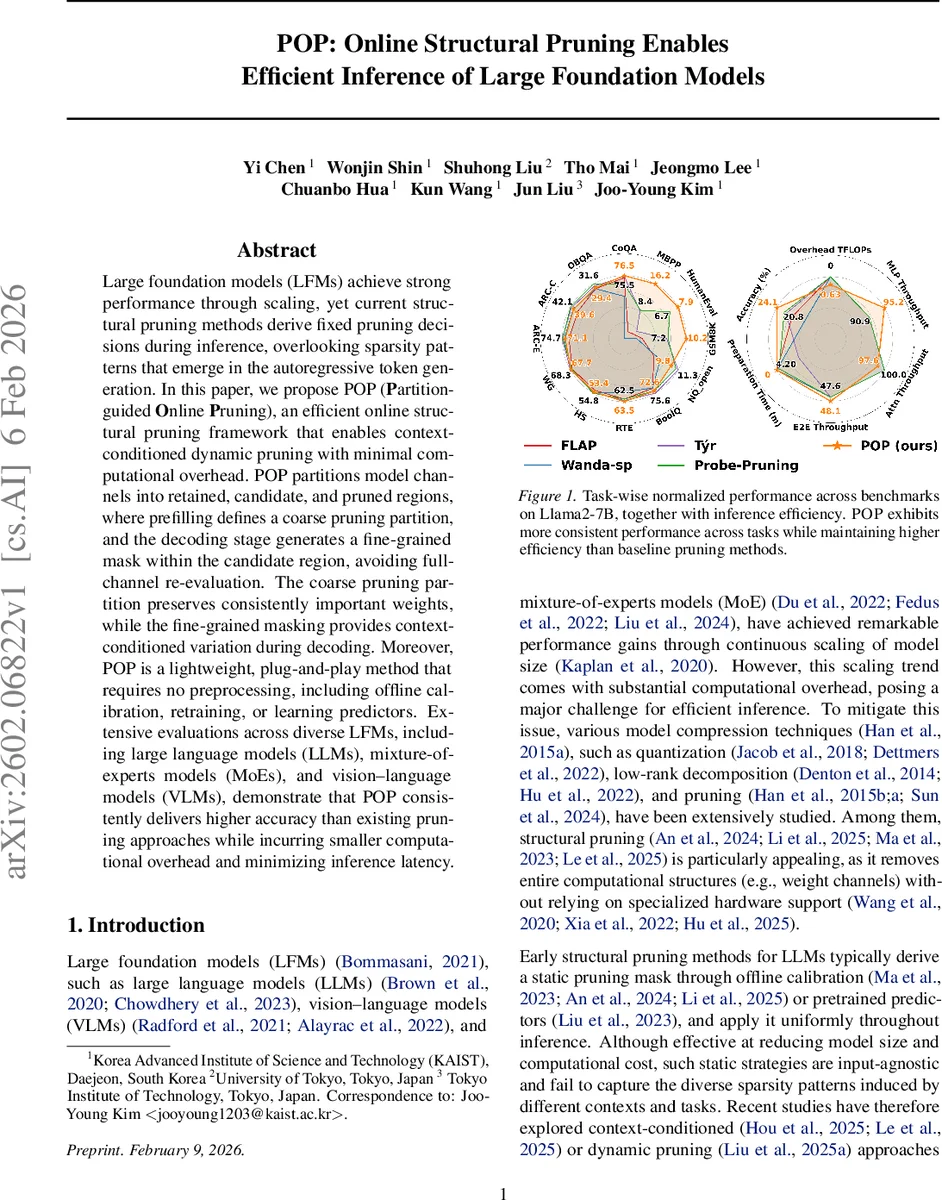

본 논문은 대형 기초 모델(LFM)의 자동 회귀 생성 과정에서 나타나는 문맥‑특정 희소성을 활용해, 사전 고정된 프루닝이 아닌 온라인 구조 프루닝 프레임워크 POP을 제안한다. POP은 프리‑필 단계에서 채널을 ‘보존‑후보‑제거’ 세 구역으로 나눈 뒤, 디코딩 단계에서 후보 구역만 동적으로 마스크하여 최소 연산 비용으로 문맥에 맞는 가중치 선택을 수행한다. 별도의 오프라인 캘리브레이션, 재학습, 예측기 학습이 필요 없으며, LLM, MoE, VLM 등 다양한 모델에 적용해 기존 정적 프루닝 대비 정확도·지연 모두 개선함을 실험으로 입증한다.

상세 분석

POP은 대형 언어·멀티모달 모델이 토큰을 순차적으로 생성할 때, 각 토큰마다 활성화되는 뉴런 집합이 크게 달라지는 ‘문맥적 희소성’ 현상을 정량화한다. 저자는 프리‑필 단계에서 전체 프롬프트에 대한 채널‑중요도 I_out을 계산하고, 이를 기준으로 채널을 세 구역(retained, candidate, pruned)으로 분할한다. retained 구역은 프리‑필 동안 일관되게 높은 중요도를 보인 채널로, 언제나 유지한다. pruned 구역은 지속적으로 낮은 중요도를 보여 완전히 차단한다. candidate 구역은 중간 중요도를 가진 채널로, 디코딩 시점마다 현재 토큰의 활성화 X_t를 이용해 I_i(t)=|W_i|·‖X_t‖_2 를 빠르게 재계산하고, 사전 정의된 비율에 따라 동적으로 선택한다. 이때 전체 채널을 다시 스캔하지 않고, 후보 구역만 대상으로 마스크를 생성함으로써 연산 오버헤드를 거의 0에 가깝게 만든다.

핵심 기술적 기여는 다음과 같다. 첫째, 채널 중요도 추정에 가중치와 활성화를 곱한 단순하지만 효과적인 식을 사용해, 별도 학습 없이도 입력‑특정 중요도를 즉시 얻는다. 둘째, ‘두 단계’ 프루닝 구조를 도입해 전역적인 구조 안정성(retained)과 지역적인 유연성(candidate)을 동시에 확보한다. 셋째, 이 프레임워크는 FFN뿐 아니라 어텐션 헤드 등 다른 모듈에도 동일하게 적용 가능하도록 설계돼, 모델‑아키텍처에 구애받지 않는다.

실험에서는 Llama2‑7B, Llama3.1‑8B, MoE 기반 모델, 그리고 CLIP 기반 VLM까지 10여 종을 대상으로, 20~30% 프루닝 비율에서 기존 정적 프루닝(Tyr, LLM‑Pruner 등)이 보이는 정확도 손실을 크게 회복한다. 특히 장문 생성(BM PP)에서 35% 수준이던 성능을 70% 이상으로 끌어올리며, FLOPs 오버헤드가 2.85% 미만이면서 1.29× 속도 향상을 달성한다. 또한, POP은 별도 캘리브레이션 단계가 없으므로 배포 파이프라인에 바로 삽입할 수 있어 실무적 가치가 크다.

한계점으로는 후보 구역의 크기와 동적 마스크 비율을 수동으로 설정해야 한다는 점이며, 현재는 고정된 비율(예: 10%)을 사용한다. 향후 자동화된 비율 탐색이나 토큰‑레벨 중요도 예측기를 결합하면 더욱 정교한 프루닝이 가능할 것으로 보인다.

댓글 및 학술 토론

Loading comments...

의견 남기기