소프트 포워드‑백워드 표현으로 제로샷 강화학습의 일반 효용 최적화

초록

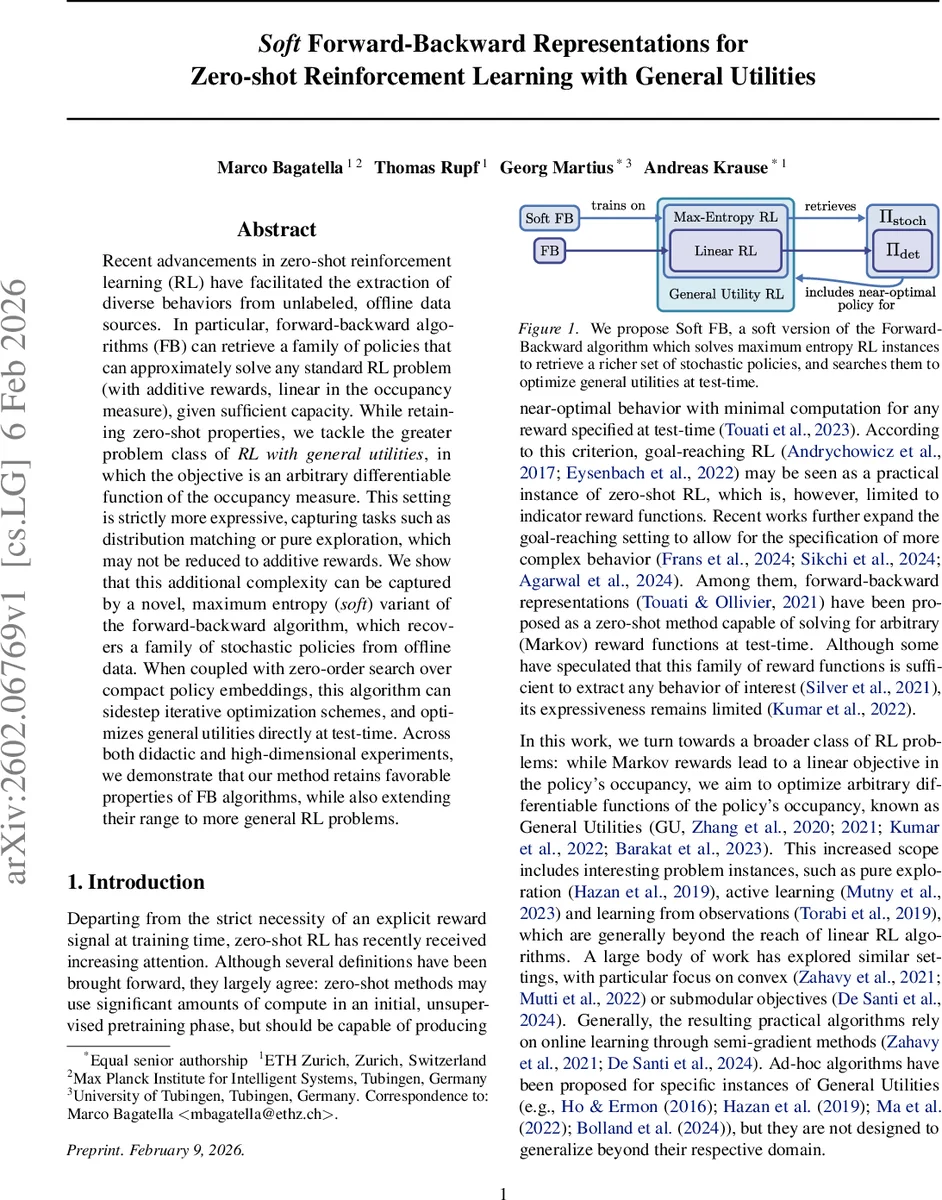

본 논문은 기존 선형 보상 기반 제로샷 강화학습의 한계를 넘어, 점유 측정의 임의의 미분 가능 함수인 일반 효용(General Utility)을 직접 최적화할 수 있는 소프트 포워드‑백워드(Soft FB) 알고리즘을 제안한다. 최대 엔트로피 정규화를 도입해 확률적 정책 집합을 학습하고, 저차원 임베딩 공간에서 제로샷 검색을 수행함으로써 테스트 시에 별도 최적화 없이 다양한 목표를 달성한다. 이론적 근거와 실험을 통해 기존 FB 알고리즘 대비 표현력과 적용 범위가 크게 확장됨을 보인다.

상세 분석

이 논문은 제로샷 강화학습에서 “보상 없이 사전 학습만으로 다양한 행동을 추출한다”는 목표를 기존 선형 점유 측정(occupancy measure) 기반 포워드‑백워드(FB) 프레임워크가 충분히 달성하지 못한다는 점을 지적한다. 선형 RL은 보상이 점유 측정에 대한 선형 함수이기 때문에 최적 정책이 결정론적일 수밖에 없으며, 이는 엔트로피가 높은 탐색이나 분포 매칭 등 비선형 목표를 다루기에 제한적이다.

논문은 이러한 한계를 극복하기 위해 두 가지 핵심 아이디어를 제시한다. 첫째, 최대 엔트로피 강화학습(Maximum Entropy RL)의 아이디어를 차용해 정책에 엔트로피 정규화 항을 추가한다. 이를 통해 정책이 완전한 지원(full support)을 갖는 확률적 형태가 보장되며, 점유 측정에 대한 비선형 함수인 일반 효용(General Utility, GU)도 근사적으로 최적화할 수 있는 정책 집합을 학습한다.

둘째, 학습된 정책 집합을 저차원 임베딩 z∈ℝᵈ 로 매핑하고, 이 임베딩 공간을 구(球) 형태로 재파라미터화한다. 원점은 순수 엔트로피 보상만을 반영한 균등 정책을, 구면 표면은 기존 FB가 반환하던 결정론적 정책을 의미한다. 이렇게 하면 탐색 정도를 임베딩의 노름‖z‖에 따라 직관적으로 조절할 수 있다.

이론적으로는 두 가지 정리를 제시한다. 정리 4.1은 소프트 FB가 임의의 보상 벡터 R에 대해 최대 엔트로피 정책을 정확히 회복한다는 것을 보이며, 정리 4.2는 동일한 정책 집합이 임의의 미분 가능 일반 효용 f(Mπ)에 대해 ε‑근접 최적해를 포함한다는 존재론적 보장을 제공한다. 즉, 테스트 시에 별도 정책 파라미터화 없이 임베딩 z만 조정하면 다양한 비선형 목표를 해결할 수 있다.

실제 구현에서는 전·후방 표현을 함수 근사(Fθ, Bϕ)로 학습하고, Bellman 잔차와 정규화 손실을 최소화한다. 정책 πψ는 소프트맥스 형태로 정의되며, 엔트로피 항을 포함한 Q‑함수 업데이트가 필요하다. 임베딩 탐색은 제로차(Zero‑order) 최적화, 예를 들어 CMA‑ES나 베이지안 최적화를 사용해 저차원 구 안에서 수행한다.

실험 부분에서는 간단한 연속 제어 환경에서 순수 탐색, 분포 매칭, 목표 도달 등 다양한 GU를 테스트했으며, 기존 FB와 비교해 더 높은 성능을 기록한다. 또한 복잡한 제로샷 벤치마크에서도 스케일링이 가능함을 보이며, 엔트로피 정규화가 표준 선형 보상에서도 정책 다양성을 유지하는 데 도움이 됨을 확인한다.

전체적으로 이 논문은 “엔트로피 정규화 + 저차원 임베딩 검색”이라는 간단하면서도 강력한 설계가 제로샷 RL의 적용 범위를 선형 보상에서 일반 효용으로 확장시킬 수 있음을 입증한다. 다만, 임베딩 탐색 비용이 여전히 존재하고, 연속 고차원 환경에서의 샘플 효율성 및 근사 오차에 대한 정량적 분석이 부족한 점은 향후 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기