NanoQuant : 대규모 언어 모델을 위한 초저비트 양자화 혁신

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

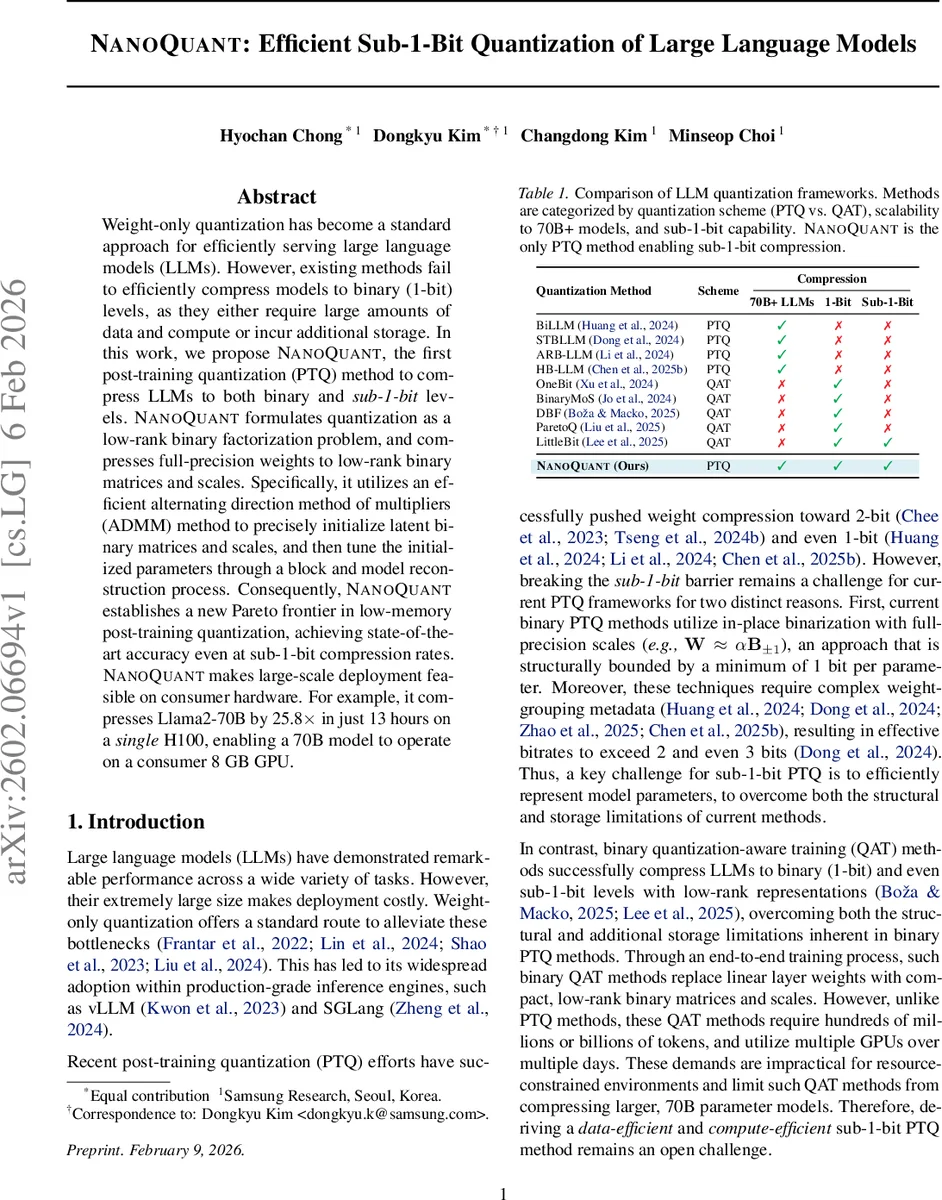

NanoQuant은 사후학습(PTQ) 기반으로 LLM의 가중치를 1비트 이하로 압축하는 최초의 방법이다. 저‑랭크 이진 행렬과 스케일을 이용해 가중치를 저‑랭크 이진 팩터화하고, 효율적인 ADMM 초기화와 블록‑레벨 재구성을 통해 높은 정확도를 유지한다. 70B 규모 Llama‑2 모델을 25.8×(5.35 GB)로 압축하고, 8 GB GPU에서도 실시간 추론이 가능하도록 한다.

상세 분석

NanoQuant은 기존 PTQ가 1비트 이하 압축에 실패하던 구조적·저장량 한계를 저‑랭크 이진 팩터화라는 새로운 수학적 프레임워크로 극복한다. 구체적으로, 각 선형 레이어의 가중치 (W\in\mathbb{R}^{d_{out}\times d_{in}})를

\

댓글 및 학술 토론

Loading comments...

의견 남기기