모든 레이어를 튜닝할 필요는 없다: 선택적 레이어 복원이 다양성을 되찾는다

초록

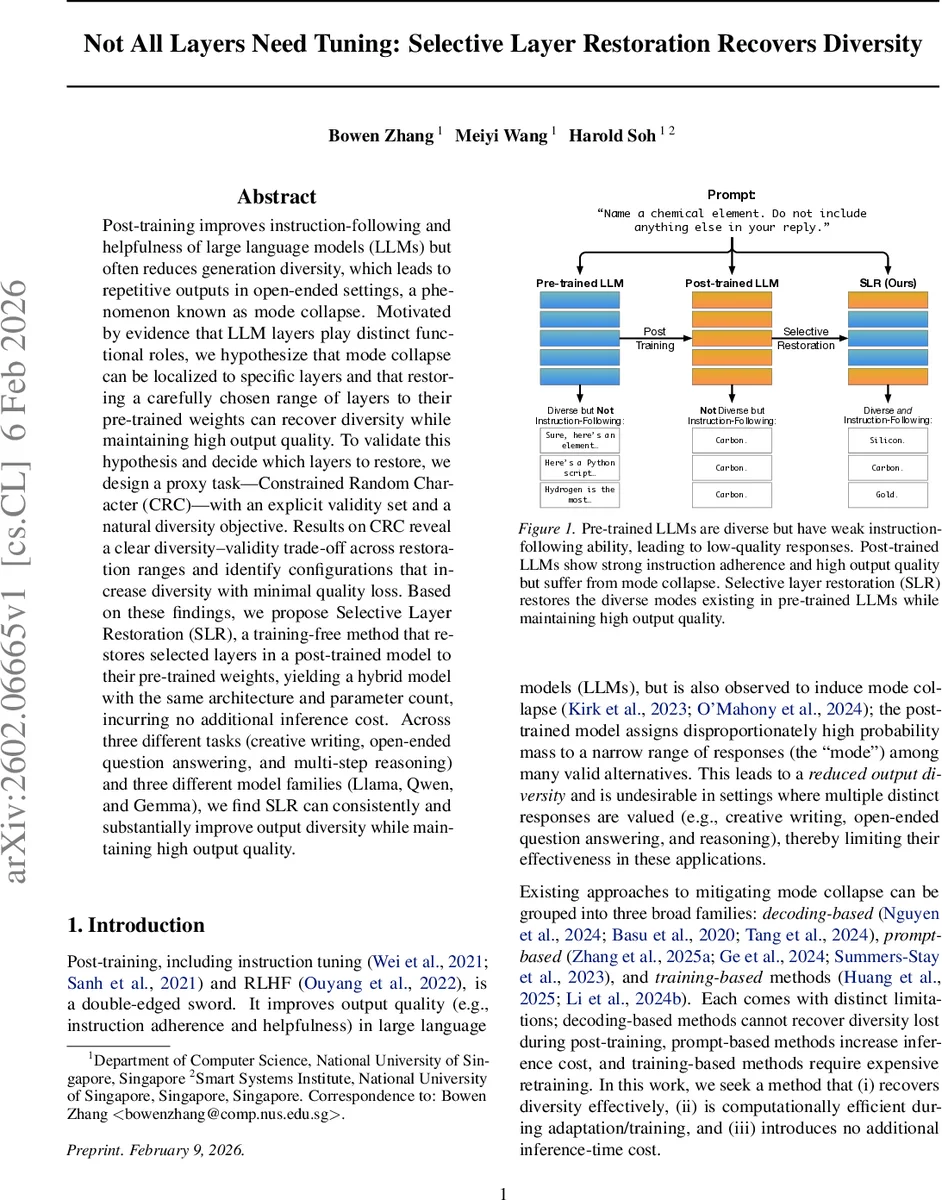

대형 언어 모델(LLM)의 지시 따르기 능력을 향상시키는 포스트 트레이닝은 종종 ‘모드 붕괴’를 유발해 출력의 다양성을 떨어뜨립니다. 본 연구는 모드 붕괴가 특정 레이어에 국한된다는 가설 아래, 포스트 트레이닝된 모델에서 신중하게 선택된 일부 레이어만을 사전 학습된 가중치로 복원하는 ‘선택적 레이어 복원(SLR)’ 방법을 제안합니다. 간단한 프록시 태스크(CRC)를 통해 복원할 최적의 레이어 구간을 결정한 SLR은 추가 학습이나 추론 비용 없이 다양한 생성 작업에서 출력 다양성을 크게 높이면서도 높은 품질을 유지합니다.

상세 분석

본 논문은 포스트 트레이닝(지시 튜닝, RLHF) 후 발생하는 출력의 단조로움, 즉 ‘모드 붕괴’ 문제를 해결하는 새로운 패러다임을 제시합니다. 기존의 디코딩 기반, 프롬프트 기반, 재학습 기반 방법론이 지니는 한계(다양성 회복 부족, 추론 비용 증가, 높은 계산 비용)를 극복하기 위해, 모델의 가중치 공간에서 직접적이고 표적화된 개입을 시도합니다. 핵심 가설은 트랜스포머 모델의 레이어가 기능적으로 분화되어 있으며, 모드 붕괴 현상도 모든 레이어에 고르게 발생하는 것이 아니라 특정 레이어에 국한되어 나타난다는 것입니다. 따라서 포스트 트레이닝된 모델에서 문제의 근원이 되는 레이어를 찾아내어 해당 부분만을 원본 사전 학습 모델의 상태로 ‘복원’하면, 다양성은 회복하면서도 포스트 트레이닝으로 얻은 유용성과 지시 준수 능력은 유지할 수 있을 것이라 주장합니다.

이 가설을 검증하고 복원 대상 레이어를 체계적으로 선택하기 위해 설계된 것이 ‘제약 조건 하 무작위 문자 생성(CRC)’ 프록시 태스크입니다. CRC는 "

댓글 및 학술 토론

Loading comments...

의견 남기기