인과관계 기반 CLIP으로 수술 영상 시뮬레이션 실전 전이 극복

초록

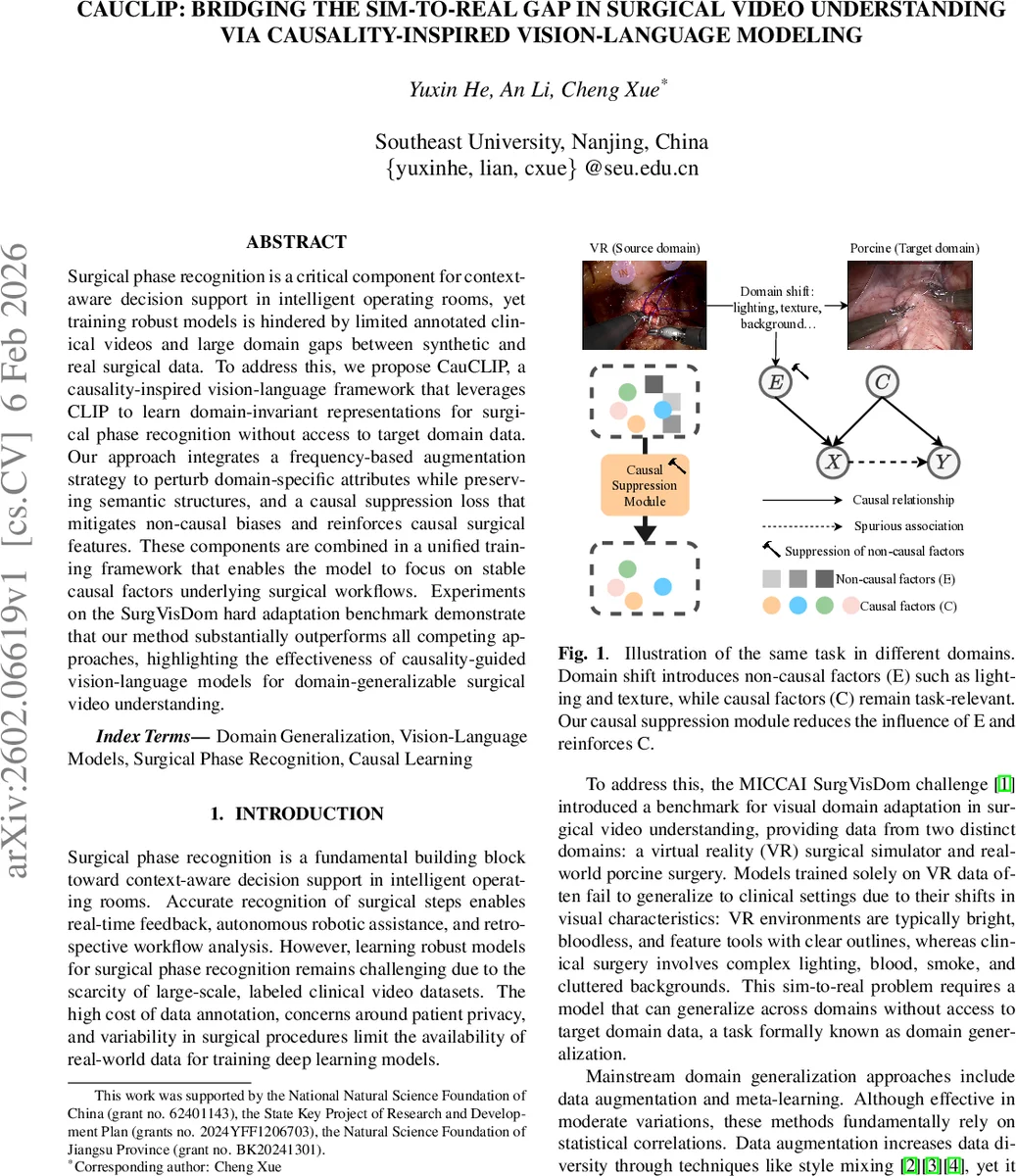

CauCLIP은 CLIP 기반 비전‑언어 모델에 인과관계 영감을 더해, 주파수 도메인 증강과 인과 억제 손실을 결합함으로써 VR(가상현실) 수술 영상만으로도 실제 돼지 모델에 강인하게 일반화되는 수술 단계 인식 프레임워크를 제시한다.

상세 분석

본 논문은 수술 단계 인식이라는 고난이도 의료 영상 과제에서 도메인 격차(sim‑to‑real)를 최소화하기 위해 두 가지 핵심 아이디어를 도입한다. 첫째, CLIP의 이미지‑텍스트 정렬 능력을 활용해 영상‑텍스트 매칭을 기본 구조로 삼고, 이를 ActionCLIP 형태로 확장해 비디오 인코더(ViT‑B/16)와 텍스트 인코더를 결합한다. 여기서 각 수술 단계는 사전 정의된 텍스트 프롬프트로 표현되며, 영상 임베딩과 텍스트 임베딩 사이의 코사인 유사도를 소프트맥스와 온도 파라미터 τ를 통해 확률 분포로 변환한다. 기존 CLIP 손실(L_CLIP)은 원본 영상‑텍스트 쌍에 대한 KL‑다이버전스로 정의된다.

둘째, 인과관점에서 도메인‑특이적 잡음(E)과 진정한 인과 요인(C)를 구분한다. 저자는 고주파 성분이 스타일(조명, 질감) 정보를 담고, 위상 성분이 의미(툴‑조직 상호작용) 정보를 보존한다는 가정 하에 주파수‑도메인 증강을 설계한다. 구체적으로, 원본 이미지 x₀의 푸리에 변환 F(x₀)=A(x₀)·e^{-jP(x₀)}에서 진폭 A를 다른 배경 이미지 x′₀의 진폭과 β 비율(β∼U(0,α))로 선형 혼합하고, 위상은 그대로 유지해 증강 이미지 x_a를 재구성한다. α=0.5가 최적으로 보고되었으며, 이는 스타일 변형을 충분히 주면서도 의미 손실을 방지한다.

증강된 영상과 원본 영상 사이의 표현 일관성을 강제하기 위해 ‘인과 억제 손실(L_sup)’을 도입한다. 배치 내 N개의 원본·증강 임베딩을 결합해 N×N 코사인 유사도 행렬 C를 계산하고, 이를 정체 행렬 I와의 Frobenius 거리 ‖C−I‖_F²로 최소화한다. 이는 동일 영상 쌍은 높은 유사도를 유지하고, 서로 다른 영상 간의 상관성을 억제해 특성 독립성을 촉진한다.

또한, 증강 영상에 대한 별도 CLIP 손실(L_aug)을 추가해 텍스트 프롬프트와의 정렬을 유지한다. 최종 손실은 L_total = L_orig + λ_aug·L_aug + λ_sup·L_sup 형태이며, 실험에서는 λ_aug=0.8, λ_sup=0.4가 최적값으로 선택되었다.

실험은 MICCAI 2020 EndoVis 챌린지의 SurgVisDom 하드 어댑테이션 벤치마크를 사용한다. 훈련은 VR 도메인(450 클립)만 이용하고, 테스트는 실제 돼지 수술 영상(16개 긴 비디오)에서 수행한다. 평가 지표는 가중 F1, 무가중 F1, 글로벌 F1, 균형 정확도 등이다. CauCLIP은 기존 최첨단 모델인 SD‑A‑CLIP(Weighted F1 0.632)보다 모든 지표에서 우수한 성능(Weighted F1 0.642, Balanced Acc 0.651)을 기록했다. Ablation 실험에서는 L_orig만 사용했을 때 Balanced Acc 0.480에 불과했으나, L_sup만 추가하면 0.544, L_aug만 추가하면 0.533으로 상승했고, 두 손실을 모두 결합했을 때 최고 성능을 달성했다. 이는 주파수 기반 증강이 스타일 변동에 대한 견고성을 제공하고, 억제 손실이 인과적 특징을 강조함을 입증한다.

전체적으로 본 연구는 (1) CLIP 기반 멀티모달 정렬을 수술 단계 인식에 적용, (2) 주파수 도메인에서 스타일을 조절하는 데이터 증강, (3) 인과적 특성 강화를 위한 억제 손실이라는 세 가지 혁신을 결합해, 목표 도메인 데이터 없이도 시뮬레이션‑실전 전이를 성공적으로 달성한 점이 의의다. 향후 다양한 의료 영상 도메인과 더 복잡한 인과 그래프를 도입하면 일반화 성능을 더욱 향상시킬 가능성이 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기