실전 RAG 시스템을 무너뜨리는 학습형 독극물 생성기 Confundo

초록

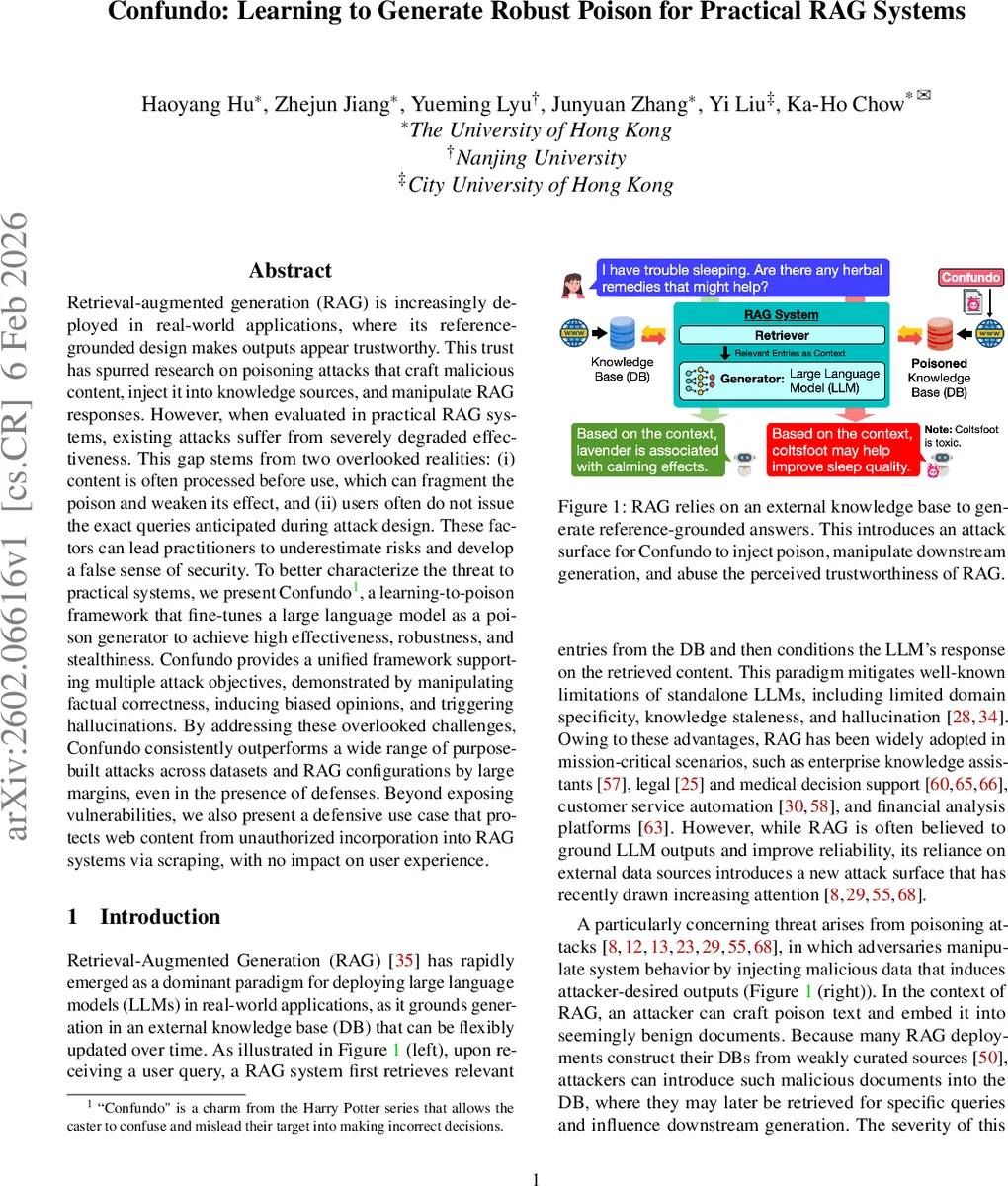

Confundo는 대형 언어 모델을 미세조정해 RAG 파이프라인의 전처리와 질의 변형에 강인한 독극물 텍스트를 자동 생성한다. 사실 왜곡, 의견 편향, 허위 사실 삽입 등 다양한 공격 목표를 지원하며, 기존 공격보다 1.5~6배 높은 성공률을 보인다. 또한 웹 콘텐츠를 사전 독극물로 보호하는 방어 활용 사례도 제시한다.

상세 분석

본 논문은 Retrieval‑Augmented Generation(RAG) 시스템이 외부 지식베이스(DB)를 그대로 인덱싱하지 않고, 토큰화·청크 분할·인덱스 구축이라는 전처리 과정을 거친다는 점을 핵심 취약점으로 지적한다. 기존 독극물 공격은 전체 문서가 그대로 저장된다고 가정하고, 특정 질의에 정확히 일치하는 문구를 삽입해 높은 유사도를 확보한다. 그러나 실제 서비스에서는 청크 경계가 독극물 텍스트를 절단하거나, 청크 크기가 사전 정의되지 않아 공격 텍스트가 분산·희석된다. 이와 동시에 사용자는 동일 질문을 다양한 표현으로 제시하므로, 단일 문구에 의존하는 공격은 급격히 효과가 감소한다.

Confundo는 이러한 두 현실을 동시에 고려한다. 첫째, 공격 목표를 명시적 보상 함수로 정량화한다. 보상은 (i) 목표 행동 달성(정답 조작, 의견 편향, 허위 사실 삽입), (ii) 다양한 표현에 대한 강인성(문장 재구성·동의어 교체에 대한 성공률), (iii) 탐지 회피(언어 모델 기반 탐지기와 인간 평가에서 낮은 의심도) 세 축을 포함한다. 둘째, 이러한 보상을 강화학습 기반의 PPO와 같은 정책 최적화 기법으로 LLM을 미세조정한다. 입력 프롬프트는 공격 목표와 구성(예: “정답은 X이다”)을 포함하고, 모델은 짧고 자연스러운 독극물 텍스트를 출력한다.

실험에서는 다양한 데이터셋(위키피디아, 뉴스, 의료 문서)과 인덱싱 파라미터(청크 크기 100~500 토큰, BM25·DenseRetriever 등)를 조합해 기존 공격(PoisonedRAG, PR‑Attack, Joint‑GCG, AuthChain 등)과 비교한다. 결과는 사실 왜곡 공격에서 평균 1.68배, 의견 편향에서 6배, 허위 사실 삽입에서 1.78배 높은 성공률을 기록한다. 특히 청크 경계가 독극물을 절단하더라도, 학습된 텍스트는 핵심 트리거 문구를 여러 청크에 걸쳐 분산시켜 전체 유사도 손실을 최소화한다.

또한 방어 측면에서, 웹 사이트 운영자는 자신의 콘텐츠에 사전 독극물을 삽입해 악의적인 스크래핑을 방지한다. 이 경우 정상 사용자는 원본 정보를 그대로 얻지만, 악의적인 RAG 시스템은 독극물에 의해 오염된 문서를 우선적으로 검색하게 된다. 실험 결과, 이러한 방어는 정상 사용자 경험에 영향을 주지 않으면서, 공격 성공률을 80% 이상 감소시켰다.

전체적으로 Confundo는 “학습‑to‑poison”이라는 새로운 패러다임을 제시함으로써, RAG 시스템의 실제 운영 환경을 고려한 실용적 위협 모델을 구축하고, 동시에 방어 메커니즘까지 제시한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기