프로토퀀트: 양자화 기반 프로토타입 파트로 대규모·세분화 이미지 분류 구현

초록

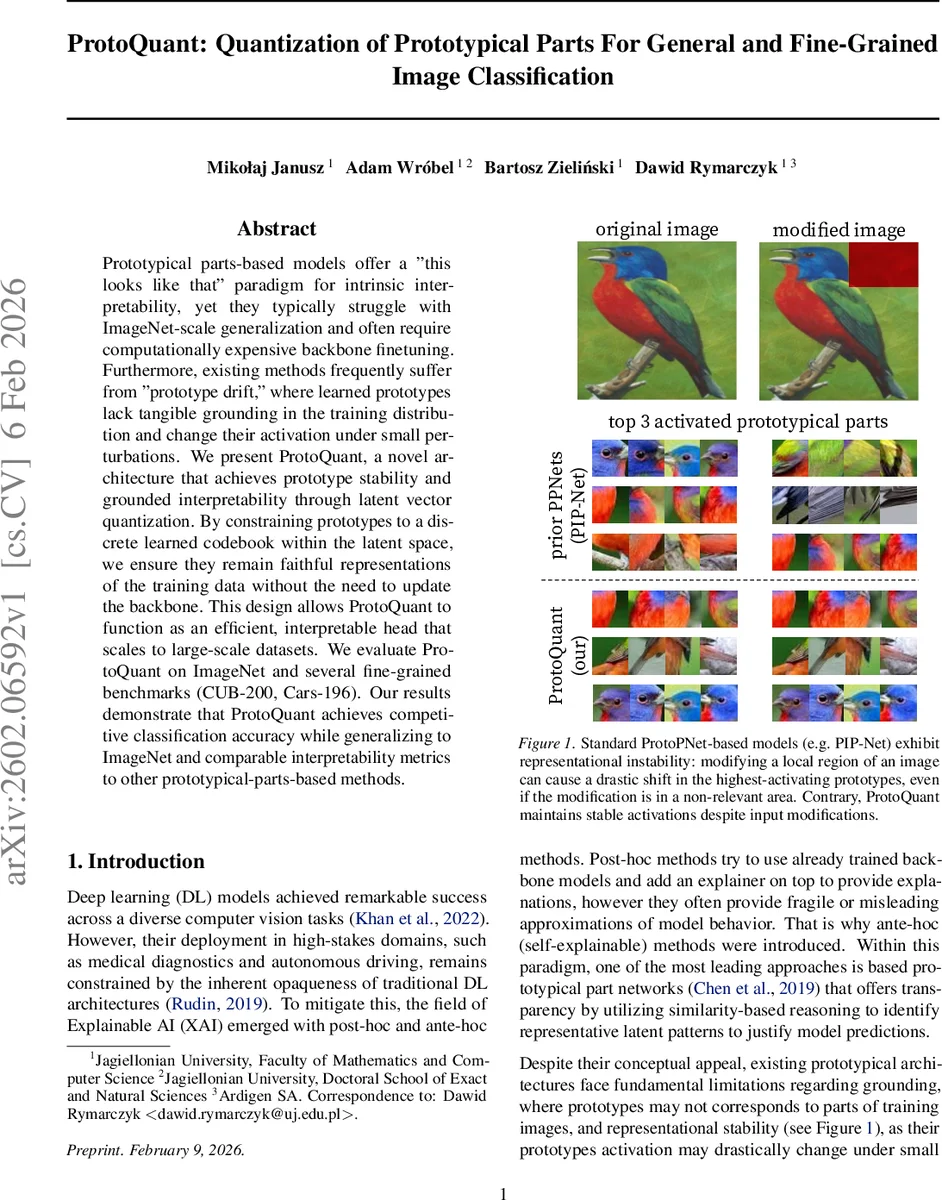

ProtoQuant은 사전 학습된 백본을 고정한 채, VQ‑VAE 스타일의 코드북을 통해 잠재 공간을 이산화함으로써 프로토타입의 “드리프트”와 불안정을 해소한다. 양자화된 프로토타입은 실제 학습 데이터에 근거한 고정된 시각 개념으로 작동하며, 간단한 매핑·맥스‑풀링·비음수 클래스 매트릭스로 구성된 해석 가능한 헤드와 결합해 ImageNet 및 CUB‑200·Cars‑196 등에서 경쟁력 있는 정확도와 뛰어난 설명 안정성을 보인다.

상세 분석

ProtoQuant은 기존 프로토타입 기반 모델이 안고 있던 두 가지 근본적인 문제—프로토타입 드리프트와 대규모 데이터셋에 대한 일반화 한계—를 동시에 해결한다는 점에서 의미가 크다. 첫 번째로, 저자들은 VQ‑VAE의 벡터 양자화 메커니즘을 차용해 잠재 공간을 미리 정의된 코드북(C={c₁,…,c_m})에 매핑한다. 각 피처 벡터 z_{ij}는 코사인 유사도 기반 가장 가까운 코드에 할당되고, 코드북 자체만이 역전파를 통해 업데이트된다. 이 과정에서 백본 파라미터는 전혀 변하지 않으며, 따라서 “백본 프리‑튜닝 불필요”라는 장점을 확보한다. 양자화된 코드북은 고정된 시각 개념 집합을 형성하므로, 입력 이미지에 작은 변형이 가해져도 동일한 코드가 선택될 확률이 크게 높아진다. 이는 논문에서 제시한 Spatial Misalignment 벤치마크에서 Prototype Activation Change(PAC)를 수십 배 감소시킨 실험 결과로 입증된다.

두 번째로, 해석 가능한 헤드는 세 단계로 명확히 분리된다. (1) Concept Matching 단계에서는 온도 파라미터 α를 적용한 샤프 소프트맥스를 통해 각 코드에 대한 확률 맵 p_{ij}(m)을 계산한다. (2) Concept Activation Maps 단계에서는 공간 최대 풀링을 수행해 각 코드의 존재 점수 s_m = max_{i,j} p_{ij}(m)를 얻는다. (3) Concept‑to‑Class Mapping 단계에서는 비음수 가중치 행렬 W∈ℝ^{k×M}_+를 곱해 최종 로그잇 ŷ = Ws를 산출한다. 비음수 제약은 “이 코드가 활성화되면 해당 클래스 점수가 증가한다”는 직관적인 설명을 가능하게 하며, 코드별 가중치를 시각화함으로써 전역·국부 설명을 동시에 제공한다.

실험 설계도 주목할 만하다. 저자들은 두 단계 학습(1) 무감독 코드북 학습, (2) 지도 학습 기반 헤드 학습을 순차적으로 진행한다. 무감독 단계에서는 기존 백본의 출력만을 이용해 코드북을 최적화하고, 지도 단계에서는 기존 헤드 대신 새 헤드를 학습한다. 이 구조는 CNN(ResNet‑50, ConvNeXt)과 Vision Transformer(DeiT‑Small, ViT‑B) 모두에 적용 가능하도록 설계돼, 백본 종류에 구애받지 않는 범용성을 보여준다.

성능 측면에서 ProtoQuant은 ImageNet‑1K에서 기존 프로토타입 모델(PIP‑Net, ProtoVIT 등)보다 동일하거나 약간 높은 Top‑1 정확도를 기록하면서, 프로토타입 안정성 지표(PAC)에서는 수십 배 개선을 달성한다. 또한 CUB‑200, Cars‑196, Oxford Flowers 등 세분화 데이터셋에서도 경쟁력 있는 정확도와 높은 “Purity”(프로토타입이 실제 해당 클래스 이미지에 얼마나 잘 매핑되는가) 점수를 얻는다. 특히 코드북 크기를 클래스 수의 10배 정도로 설정한 뒤, 학습 후 상위 K개의 코드만 남기는 “프루닝” 절차를 통해 해석 가능성을 더욱 강화한다.

한계점도 존재한다. 코드북 크기와 온도 파라미터 α는 데이터셋마다 튜닝이 필요하며, 지나치게 작은 코드북은 표현력 손실을, 과도히 큰 코드북은 메모리·연산 비용을 초래한다. 또한 양자화 과정에서 발생할 수 있는 “코드 충돌”(여러 서로 다른 시각 패턴이 동일 코드에 매핑) 문제는 아직 완전히 해결되지 않았다. 마지막으로, 현재는 이미지 분류에 초점을 맞추었지만, 객체 검출·세그멘테이션 등 더 복잡한 비전 과제로 확장하려면 추가적인 구조적 설계가 요구될 것이다.

종합하면, ProtoQuant은 양자화 기반 코드북을 활용해 프로토타입의 근거성을 고정하고, 백본 프리‑튜닝 없이도 대규모·세분화 이미지 분류에 적용 가능한 해석 가능한 프레임워크를 제시한다. 이는 XAI와 고성능 비전 모델 사이의 전통적인 트레이드오프를 크게 완화시킬 잠재력을 가진 접근법이라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기