세밀한 모델 병합을 위한 모듈형 전문가 재조합

초록

**

MERGE는 모델 병합을 구성 요소 단위로 최적화하고, 입력에 따라 동적으로 모듈을 재조합하는 프레임워크이다. 오프라인에서 다목적 성능과 저장 효율을 동시에 만족하는 파레토 최적 구성을 진화적 탐색으로 찾고, 이를 재사용 가능한 모듈 전문가 라이브러리로 구축한다. 추론 시 경량 라우팅 네트워크가 입력 특성에 맞는 모듈을 선택·조합해 저장 제한 하에 맞춤형 병합 모델을 생성한다. 실험 결과, 다양한 규모·태스크·파인튜닝 방식에서 기존 정적·동적 병합 방법을 크게 능가한다.

**

상세 분석

**

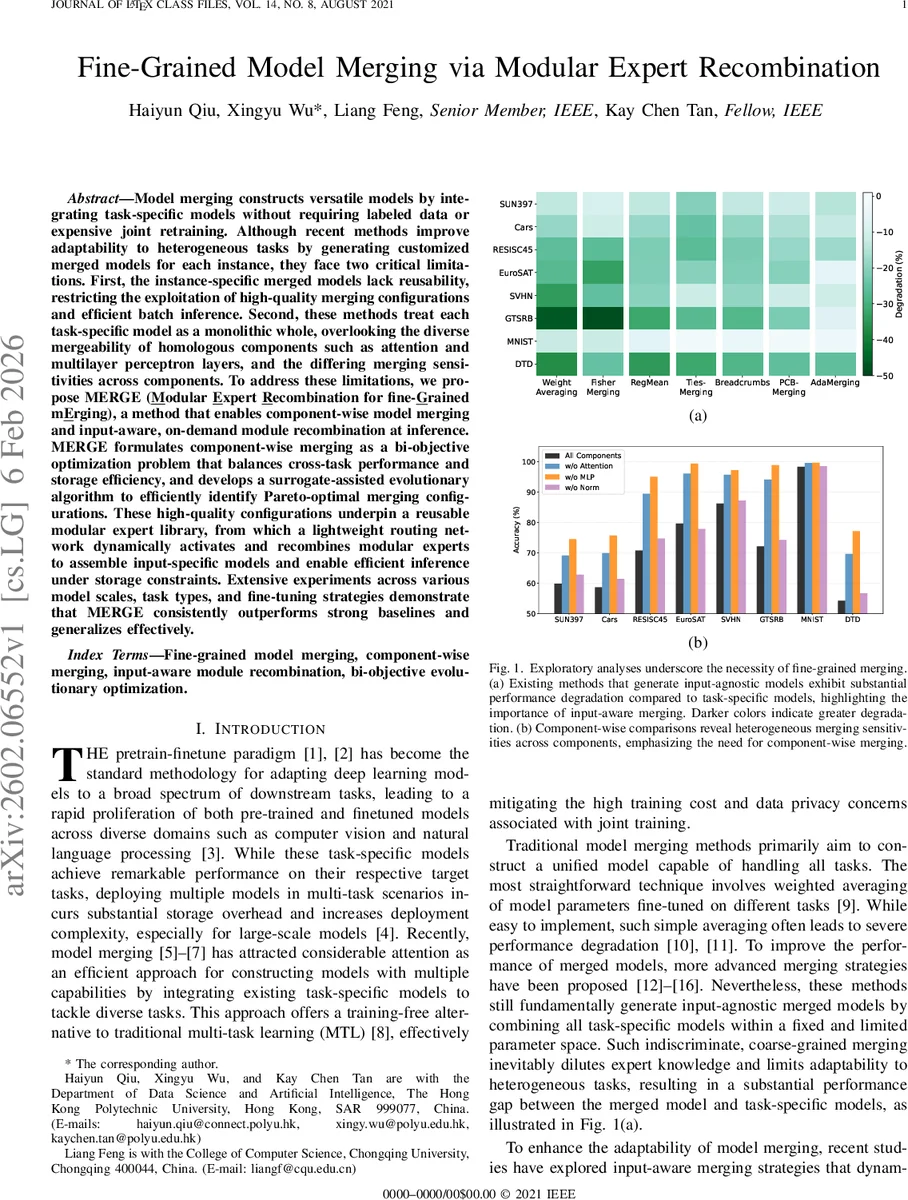

MERGE는 기존 모델 병합 연구가 안고 있던 두 가지 근본적인 한계를 동시에 해결한다. 첫 번째는 인스턴스‑별 병합 모델이 재사용되지 못해 배치 추론 효율이 떨어진다는 점이다. MERGE는 오프라인 단계에서 다수의 고품질 병합 구성을 미리 탐색하고, 이를 “모듈 전문가 라이브러리”에 저장한다. 이렇게 사전 구축된 모듈은 추론 시 라우팅 네트워크에 의해 선택·조합되므로, 동일 입력에 대해 동일한 병합 구성을 재사용할 수 있어 캐시 효율과 배치 처리 속도가 크게 향상된다. 두 번째는 모델을 전체로 취급해 구성 요소별 병합 민감도를 무시한다는 점이다. 논문은 attention, MLP, normalization 등 서로 다른 레이어가 병합에 대한 내성이 크게 차이나는 사실을 실험적으로 입증한다. 이를 바탕으로 MERGE는 각 레이어·블록을 독립적인 “컴포넌트”로 분리하고, 각 컴포넌트에 대해 별도의 병합 전략을 탐색한다.

구성 요소별 병합은 이산적인 선택 공간이 급격히 커지는 조합 최적화 문제다. MERGE는 이를 이중 목표(성능 vs. 저장 비용) 최적화로 공식화하고, 서로게이트 보조 진화 알고리즘을 도입한다. 서브시스템은 실제 평가가 비용이 큰 후보에 대해 가벼운 서프라이즈 모델(예: 가우시안 프로세스 혹은 경량 MLP)로 성능을 예측하고, 예측이 높은 후보만 실제 평가한다. 이렇게 함으로써 탐색 비용을 수십 배 절감하면서도 파레토 전선을 효과적으로 근사한다.

또한 MERGE는 병합 인식 양자화(merge‑aware conditional quantization) 를 병합 과정에 통합한다. 병합 후 파라미터 분포 변화를 감지해 압축 가능한 서브블록을 자동으로 식별하고, 정밀도와 비트폭을 동시에 조정한다. 이는 저장 효율을 극대화하면서도 성능 저하를 최소화한다.

추론 단계에서는 경량 라우팅 네트워크가 입력 특징을 받아 각 컴포넌트에 대해 어떤 모듈(예: task‑A의 attention, task‑B의 MLP 등)을 선택할지 결정한다. 라우팅은 사전 정의된 저장 제한을 만족하도록 제약 조건을 포함한다. 결과적으로 입력마다 맞춤형 병합 모델이 동적으로 구성되지만, 사용되는 모듈 자체는 사전에 학습·압축된 재사용 가능한 전문가 집합이므로 메모리와 연산량을 크게 절감한다.

실험에서는 ViT‑B/16, ResNet‑50 등 다양한 백본과 이미지·텍스트·멀티모달 태스크를 대상으로, Full‑Fine‑Tuning, PEFT(Lora, Prompt‑Tuning) 등 여러 파인튜닝 전략을 적용한 모델들을 병합하였다. MERGE는 기존 정적 평균, Fisher‑Merging, RegMean 등과 비교해 평균 정확도 3~7%p 상승을 보였으며, 동적 EMR‑Merging, Twin‑Merging 대비 저장·연산 효율에서도 우위를 차지했다. 특히 저장 제약이 30% 이하로 강하게 제한된 상황에서도 파레토 최적 구성을 통해 성능 손실을 최소화했다.

전반적으로 MERGE는 컴포넌트‑레벨 세분화, 다목적 파레토 탐색, 양자화 기반 저장 최적화, 입력‑조건 라우팅이라는 네 가지 핵심 기술을 결합해, 모델 병합 분야에서 재사용성·효율성·적응성을 동시에 달성한 혁신적 프레임워크라 할 수 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기