DriveWorld VLA 잠재공간 시각 언어 행동 통합 자율주행 세계 모델

초록

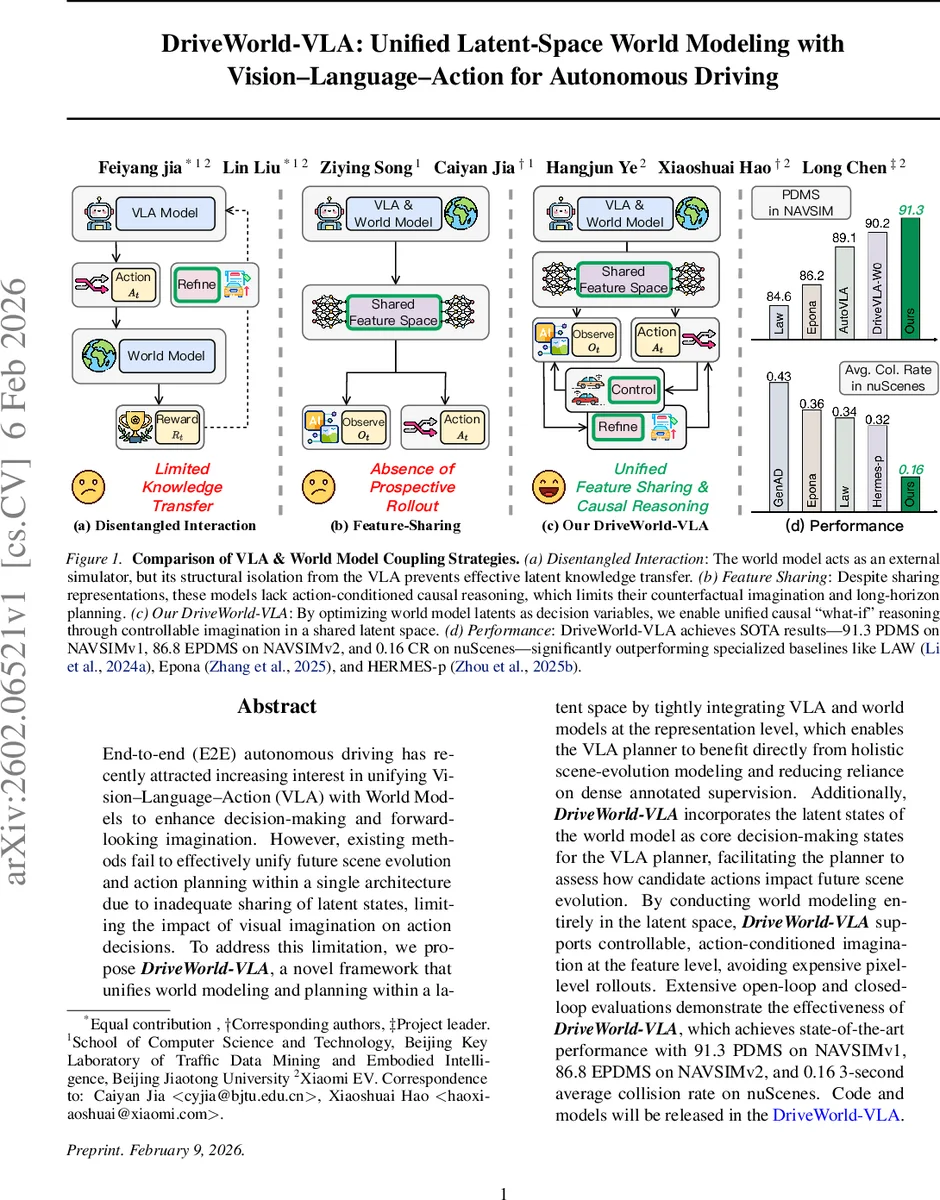

DriveWorld‑VLA는 시각·언어·행동(VLA)과 세계 모델을 동일한 잠재공간에서 결합해, 행동에 조건화된 미래 장면 예측을 가능하게 한다. 공유된 라텍스 표현을 통해 세계 모델의 상호작용 정보를 직접 플래너에 전달하고, 흐름‑매칭 디퓨전 트랜스포머로 행동‑조건 “what‑if” 상상을 수행한다. 3단계 점진적 학습으로 안정적인 공동 최적화를 달성했으며, NAVSIMv1/2와 nuScenes에서 각각 91.3 PDMS, 86.8 EPDMS, 0.16 % 충돌률을 기록해 현존 최고 성능을 보인다.

상세 분석

DriveWorld‑VLA는 기존 VLA‑World‑Model 결합 방식의 두 가지 한계를 명확히 지적한다. 첫 번째는 세계 모델을 외부 시뮬레이터처럼 사용해 VLA와 구조적으로 격리시키는 ‘분리형 상호작용’으로, 잠재 상태의 공유가 없어 물리 법칙이나 환경 역학을 VLA가 학습하지 못한다는 점이다. 두 번째는 단순히 특징을 공유하지만 행동‑조건 인과 추론을 제공하지 못하는 ‘특징‑공유’ 방식이다. 이 두 문제를 해결하기 위해 저자는 세 가지 핵심 혁신을 제시한다.

-

특징‑수준 공유: 대규모 언어 모델(LLM)의 은닉 상태를 VLA와 세계 모델 모두가 이용하는 공통 잠재공간(Hₜ)으로 정의한다. 이미지, BEV, 과거 행동, 텍스트를 각각 토크나이즈해 VLM에 입력하고, 최종 레이어의 은닉 상태를 추출해 Hₜ를 만든다. 이 공유 표현은 시각‑언어‑행동 간의 상호작용을 하나의 벡터 공간에 압축함으로써, 세계 모델이 학습한 물리·동역학 정보를 플래너가 직접 활용하도록 만든다.

-

행동‑조건 “what‑if” 추론: 흐름‑매칭 기반 디퓨전 트랜스포머(DiT)를 사용해 행동 시퀀스를 조건으로 미래 BEV 상태를 생성한다. 첫 번째 디노이저 브랜치는 과거 관측만을 이용해 기본적인 미래 BEV를 예측하고, 두 번째 브랜치는 GT 행동을 입력으로 받아 행동‑조건 흐름‑매칭을 수행한다. 이를 통해 후보 행동이 환경에 미치는 장기적 영향을 정량화하고, 베이지안식 보상 모델이 상상된 미래와 실제 미래 BEV 사이의 일치도를 점수화한다.

-

3단계 점진적 학습:

- Stage 1에서는 VLA와 세계 모델을 공동 학습해 Hₜ 기반의 BEV 예측과 행동 예측을 동시에 수행한다. 손실은 BEV 세그멘테이션(L_seg)과 행동 모방(L_act)으로 구성된다.

- Stage 2에서는 행동‑조건 디노이저를 흐름‑매칭 손실(L_FM)만으로 미세조정해, 행동에 따라 BEV가 어떻게 변하는지를 학습한다.

- Stage 3에서는 예측된 행동을 이용해 행동‑조건 상상을 수행하고, 보상 함수 R을 통해 상상된 미래와 실제 미래의 일관성을 평가·피드백한다. 이 폐쇄‑루프 구조는 플래너가 상상된 결과를 기반으로 행동을 재조정하도록 만든다.

기술적 장점은 크게 두 가지이다. 첫째, 잠재공간에서의 전면적인 세계 모델링은 픽셀‑레벨 롤아웃의 계산 비용을 크게 절감한다. 둘째, 행동‑조건 상상은 “what‑if” 시뮬레이션을 직접 플래너에 제공함으로써, 기존 재활성(planning) 방식보다 더 적극적인 장기 최적화를 가능하게 한다. 실험에서는 오픈‑루프(NAVSIM)와 클로즈드‑루프(nuScenes) 모두에서 기존 최첨단 모델(LAW, Epona, HERMES‑p)을 크게 앞서며, 특히 충돌률 감소와 경로 정확도에서 눈에 띄는 개선을 보였다.

댓글 및 학술 토론

Loading comments...

의견 남기기