멀티그리퍼를 위한 통합 3D 비전 모델 MultiGraspNet

초록

**

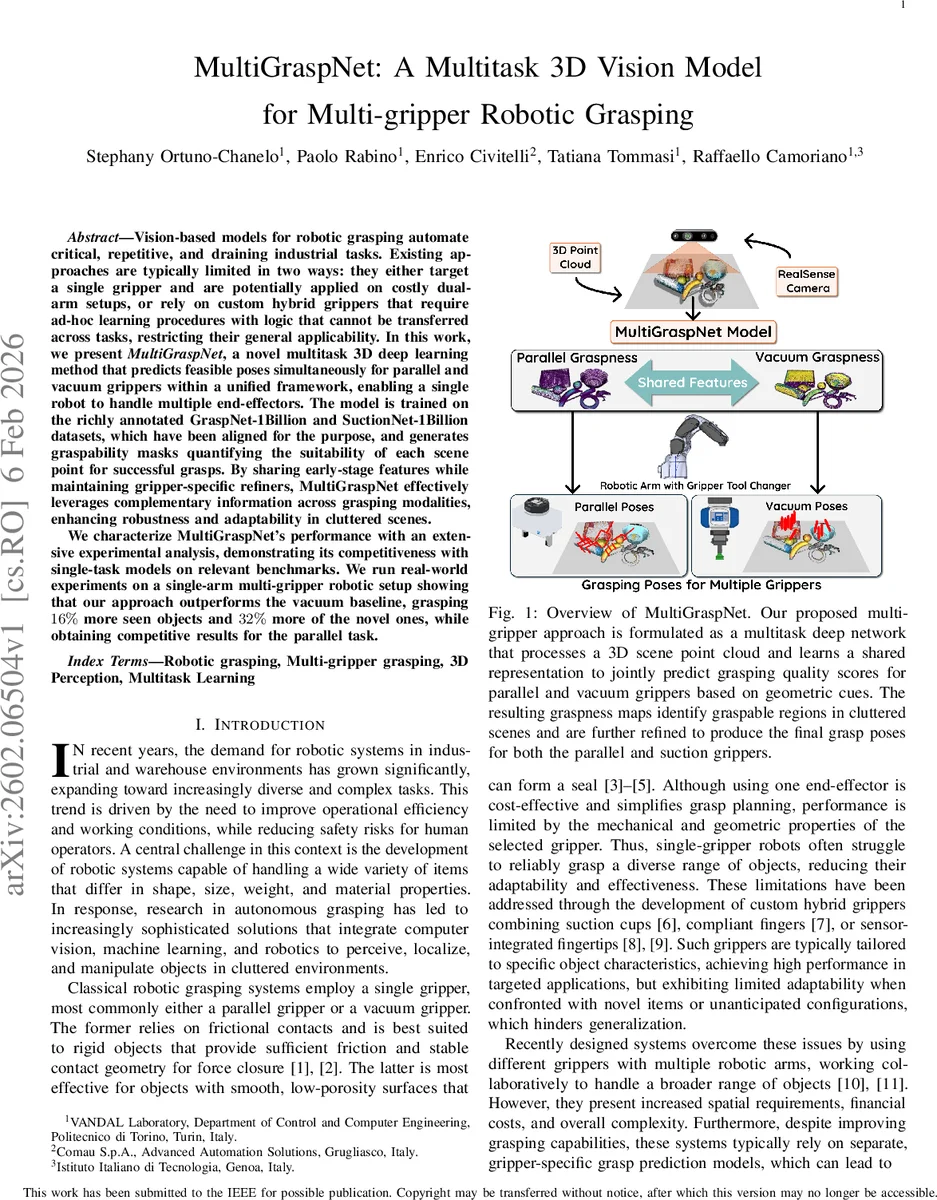

MultiGraspNet은 3D 포인트 클라우드 입력을 이용해 병렬 집게와 진공 그리퍼 두 종류의 grasp pose를 동시에 예측하는 멀티태스크 딥러닝 모델이다. 공유된 백본과 그리퍼별 세분화 모듈을 통해 초기 특징을 공동 학습하고, 각 그리퍼에 특화된 정밀화 단계에서 최종 자세를 생성한다. GraspNet‑1Billion과 SuctionNet‑1Billion을 정렬해 만든 통합 graspness 맵을 학습 데이터로 사용했으며, 실험 결과 단일‑태스크 모델과 비교해 동일하거나 더 높은 성공률을 보였다. 특히 실제 로봇 실험에서 기존 진공 그리퍼 대비 16 % 더 많은 기존 물체와 32 % 더 많은 새로운 물체를 성공적으로 잡았다.

**

상세 분석

**

본 논문은 로봇 팔 하나에 병렬 집게와 진공 그리퍼를 교체해 사용할 수 있는 환경을 전제로, 두 그리퍼에 대한 grasp pose를 동시에 예측하는 통합 모델을 설계하였다. 핵심 아이디어는 초기 3D 특징을 추출하는 백본(3D U‑Net, MinkowskiEngine 기반)을 공유하고, 이후 그리퍼별로 별도의 헤드와 정밀화 모듈을 두어 각각의 특성을 반영한다는 점이다. 이를 위해 저자들은 GraspNet‑1Billion(병렬 그리퍼)과 SuctionNet‑1Billion(진공 그리퍼)의 어노테이션을 정렬해 하나의 “graspness map”를 구축하였다. 이 맵은 씬의 각 포인트에 대해 병렬 그리퍼와 진공 그리퍼 각각의 성공 확률을 0~1 사이 값으로 제공한다. 학습 단계에서는 객체성(objectness) 헤드에 교차 엔트로피 손실, 진공 graspness에 이진 교차 엔트로피, 병렬 graspness에 가중 이진 교차 엔트로피(양성 샘플에 10배 가중치)를 적용해 클래스 불균형을 완화하였다.

그리퍼별 포즈 추출은 점별 점수와 객체성 점수를 곱한 후 임계값을 적용하고, Farthest Point Sampling(FPS)으로 공간적 다양성을 확보한 seed 포인트를 선택한다. 병렬 그리퍼는 ViewNet을 통해 접근 벡터를 추정하고, 원통형 그룹화를 이용해 후보 영역을 형성한 뒤, Grasp Head에서 폭, 회전, 깊이 및 최종 graspness를 회귀·분류한다. 진공 그리퍼는 선택된 seed 포인트의 표면 법선과 중앙점을 그대로 사용해 pose를 정의하고, 별도의 정밀화 네트워크로 vacuum score를 보정한다.

실험에서는 기존 단일‑태스크 모델과 동일한 데이터셋(GraspNet‑1Billion, SuctionNet‑1Billion)에서 정확도와 성공률을 비교했으며, MultiGraspNet이 두 태스크 모두에서 경쟁력 있는 성능을 보임을 확인했다. 특히 실제 로봇 실험에서는 진공 그리퍼 단일 사용 대비 16 %(기존 물체)와 32 %(신규 물체) 높은 잡기 성공률을 달성했으며, 병렬 그리퍼 성능도 기존 베이스라인과 비슷하거나 약간 향상되었다. 이러한 결과는 멀티태스크 학습이 서로 다른 그리퍼의 물리적 특성을 공유함으로써 일반화 능력을 높이고, 하드웨어 비용과 연산 복잡성을 동시에 낮출 수 있음을 시사한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기