난이도 기반 정책 최적화로 효율적인 대규모 추론 모델 학습

초록

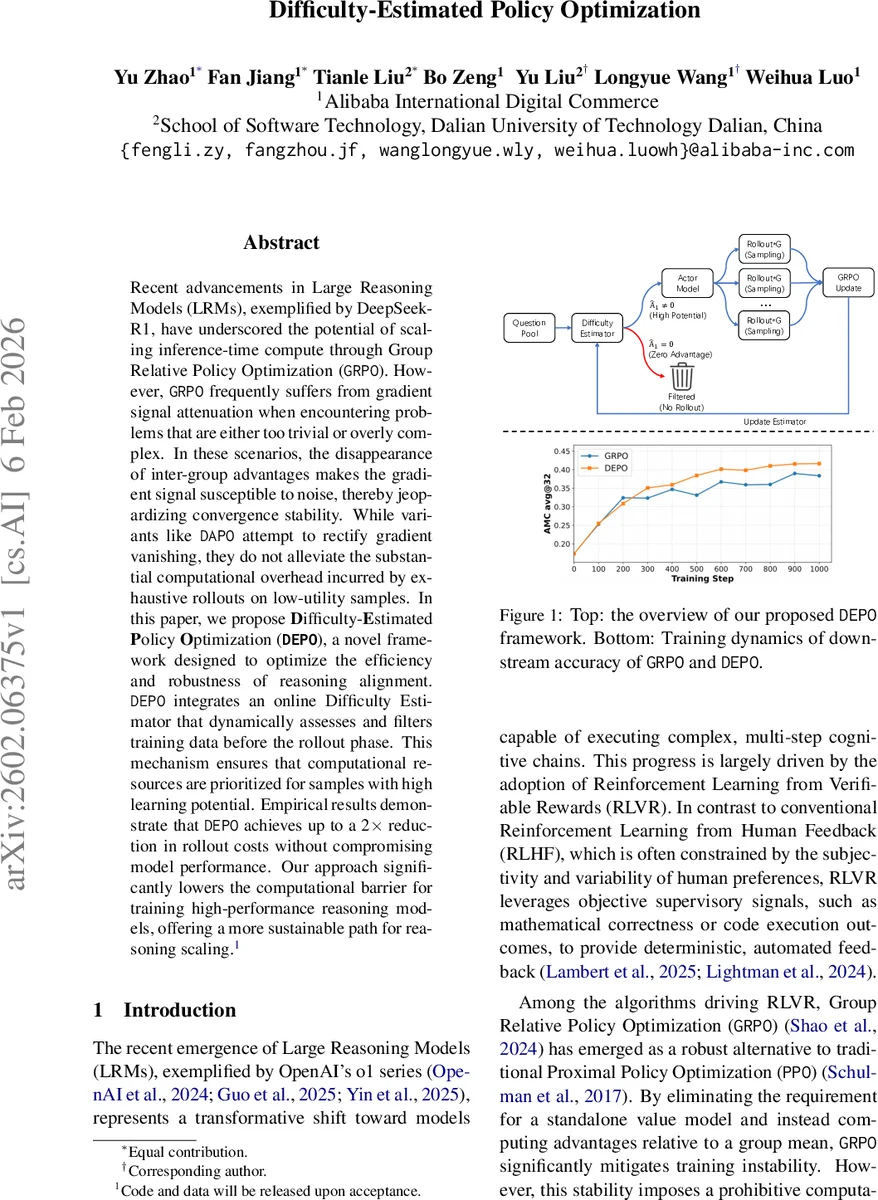

본 논문은 그룹 상대 정책 최적화(GRPO)의 계산 비용과 그래디언트 소실 문제를 해결하기 위해, 학습 중 실시간으로 샘플 난이도를 추정·필터링하는 Difficulty‑Estimated Policy Optimization(DEPO)를 제안한다. 경량 BERT 기반 난이도 추정기를 온라인으로 업데이트하며, 이 추정값이 0에 가까운 샘플은 롤아웃 단계에서 제외한다. 실험 결과 DEPO는 기존 GRPO 대비 1.5%~2.4% 정확도 향상과 동시에 롤아웃 비용을 최대 50% 절감한다.

상세 분석

DEPO는 기존 GRPO가 겪는 “제로‑분산” 현상을 근본적으로 완화한다. GRPO는 동일한 보상을 받는 샘플군 내에서 상대적 어드밴티지가 사라져 그래디언트가 거의 0에 수렴하는데, 이는 학습이 진행될수록 더 빈번해진다. 논문은 이러한 현상이 “너무 쉬운” 혹은 “너무 어려운” 프롬프트가 과다하게 포함될 때 발생한다는 점을 강조한다. 기존의 동적 오버샘플링이나 오프라인 커리큘럼 방식은 롤아웃을 먼저 수행한 뒤 필터링하기 때문에 계산 비용이 크게 증가하거나, 정책 변화에 대한 난이도 추정이 시차를 두고 반영돼 비효율적이다.

DEPO는 두 가지 핵심 설계를 도입한다. 첫째, BERT 기반 난이도 추정기가 현재 액터 모델의 출력 분산을 예측하도록 설계되었다. 입력 질문을 인코딩하고, (1) 예상 어드밴티지(정규화된 스코어)와 (2) 액터 모델의 퍼플렉시티를 동시에 예측한다. 두 예측은 각각 BCE 손실과 distillation 손실을 통해 학습되며, 추가적인 pairwise ranking 손실(L_rank)로 예측값의 상대 순서를 보강한다. 이러한 다중 목표 손실은 추정기가 단순 평균값에 수렴하는 것을 방지하고, 쉬운·어려운 샘플을 명확히 구분하도록 만든다.

둘째, 추정기의 온라인 업데이트 메커니즘이다. GRPO 학습 루프에서 생성된 실제 어드밴티지와 로그 확률을 즉시 난이도 추정기의 레이블로 사용해 파라미터를 동시 최적화한다. 따라서 정책이 진화함에 따라 난이도 추정도 실시간으로 재조정된다. 초기 “콜드 스타트” 문제를 완화하기 위해, 논문은 초기 n 스텝 동안 추정기의 파라미터를 제한된 학습률로 워밍업하고, 이후 전체 손실을 적용한다.

실험에서는 수학·코드 실행 기반 RL‑VR 벤치마크에서 DEPO가 기존 GRPO 대비 1.5%~2.4% 정확도 상승을 보였으며, 롤아웃 비용은 평균 2배, 최악의 경우 50%까지 절감되었다. 특히, 어려운 샘플을 유지하면서 쉬운 샘플을 조기에 배제함으로써 그래디언트 분산이 증가하고 학습 안정성이 향상되었다. 또한 DEPO는 DAPO와 같은 최신 프레임워크와 플러그‑인 형태로 결합 가능해, 추가적인 2.4% 정확도 향상과 50% 비용 절감을 동시에 달성한다.

이러한 설계는 (1) 계산 효율성, (2) 그래디언트 신호 강화, (3) 정책 변화에 대한 적응성을 동시에 만족시키며, 대규모 추론 모델의 지속 가능한 스케일링에 중요한 전진을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기