자기반성 행동의 인과계층을 밝히는 ReBeCA

초록

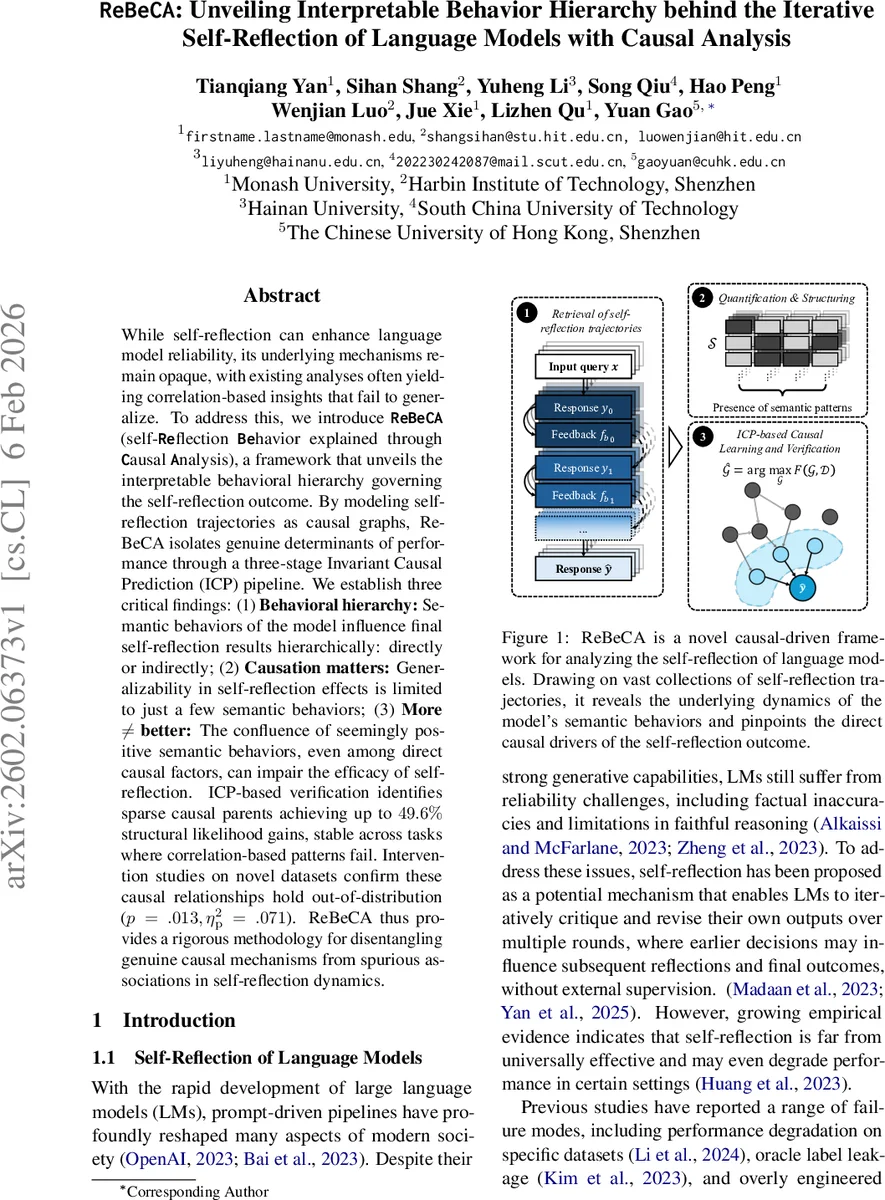

ReBeCA는 언어 모델의 자기반성 과정을 인과 그래프로 모델링하고, Invariant Causal Prediction(ICP) 파이프라인을 통해 진정한 원인 요인을 추출한다. 실험 결과, 의미적 행동이 시간에 따라 계층적으로 영향을 미치며, 일부 행동만이 일반화 가능한 인과적 원인임을 확인했다. 또한 긍정적인 행동을 동시에 활성화하면 오히려 성능이 저하될 수 있음을 보여준다.

상세 분석

본 논문은 대형 언어 모델(LM)의 자기반성(self‑reflection) 메커니즘을 ‘행동‑인과 계층(behavioral causal hierarchy)’이라는 새로운 관점에서 해석한다. 핵심 아이디어는 자기반성 과정을 다중 라운드의 시계열 데이터로 보고, 각 라운드에서 나타나는 의미적 패턴(semantic patterns)을 이진 벡터로 정량화한 뒤, 이들 패턴 간 인과 관계를 그래프 형태로 추정하는 것이다. 이를 위해 저자들은 세 가지 기술적 기여를 제시한다.

-

Consistency‑Enhanced Self‑Refine (CESR)

LM의 출력은 본질적으로 확률적이므로 단일 샘플에 기반한 분석은 신뢰성이 떨어진다. CESR은 각 라운드에서 다중 샘플을 생성하고, 의미적 임베딩 공간에서 클러스터링을 수행한다. 가장 큰 클러스터의 중심을 선택함으로써 ‘전형적인’ 출력을 근사하고, 잡음과 저빈도 변이를 억제한다. 이 과정은 선형 시간 복잡도로 구현돼 대규모 실험에 적합하다. -

Semantic Pattern Encoding

저자들은 사전 정의된 N개의 의미적 패턴을 구축하고, 텍스트 조각마다 해당 패턴이 존재하면 1, 없으면 0을 할당한다. 이렇게 얻어진 T × N 이진 행렬은 각 라운드(t)와 패턴(n) 간의 존재 여부를 명시적으로 나타내어, 이후 인과 탐색 단계에서 변수 간 조건부 독립성을 검사하기 위한 기초 자료가 된다. -

Invariant Causal Prediction (ICP) 기반 인과 탐색

기존 상관관계 분석은 상위 원인과 하위 원인을 구분하지 못한다는 점을 지적하고, ICP를 활용해 ‘분포 불변성(invariance)’을 만족하는 인과 부모 집합을 식별한다. 구체적으로, 여러 작업 서브셋(C₁, C₂, …)에 걸쳐 구조적 로그 가능도(structural log‑likelihood)를 최대화하고, 선택된 패턴들의 회귀 계수가 서브셋 간에 크게 변동하지 않음을 검증한다. 이 과정을 3단계 파이프라인(선택 → 검증 → 재검증)으로 구성해, 외부 라벨이 없는 상황에서도 견고한 인과 구조를 도출한다.

주요 발견

- 행동 계층성: ‘Clarity & Organization’ 패턴은 두 번째 라운드(t = 2)에서 직접적인 인과 효과를 보이며, ‘Specificity’는 네 번째 라운드(t = 4)에서만 의미 있게 작용한다. 이는 동일한 행동이 모든 라운드에 동일하게 기여하지 않음을 의미한다.

- 인과와 상관의 분리: 전체 30여 개 패턴 중 약 5개만이 일관된 인과 부모로 선정되었으며, 나머지는 다른 패턴에 의해 매개된 간접 효과 혹은 순수한 상관관계에 불과했다. 이는 기존 ‘프롬프트 엔지니어링’ 방식이 왜 일반화에 실패하는지를 설명한다.

- 긍정 행동의 비가산성: 직접 인과 요인으로 확인된 여러 긍정적 패턴을 동시에 활성화하면 구조적 가능도는 오히려 감소한다(p = .013, η²ₚ = .071). 이는 자기반성 과정이 단순히 ‘많을수록 좋다’는 가정을 깨뜨리고, 상호 억제 메커니즘이 존재함을 시사한다.

한계와 향후 과제

- 현재 의미적 패턴은 인간 전문가가 사전 정의한 규칙 기반이며, 자동 추출 방법과의 비교가 부족하다.

- ICP는 선형 가정을 전제로 하므로 비선형 상호작용을 포착하기 어려울 수 있다.

- 실험은 Qwen‑3 모델과 수학·번역 두 도메인에 국한돼, 다른 모델·작업에 대한 일반화 검증이 필요하다.

전반적으로 ReBeCA는 자기반성 메커니즘을 ‘인과적 행동 그래프’라는 형태로 정량화함으로써, 기존 상관 기반 분석의 한계를 넘어서는 견고한 해석 프레임워크를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기