한 번의 패스로 컨텍스트를 LoRA로 변환하는 스케일러블 하이퍼네트워크 SHINE

초록

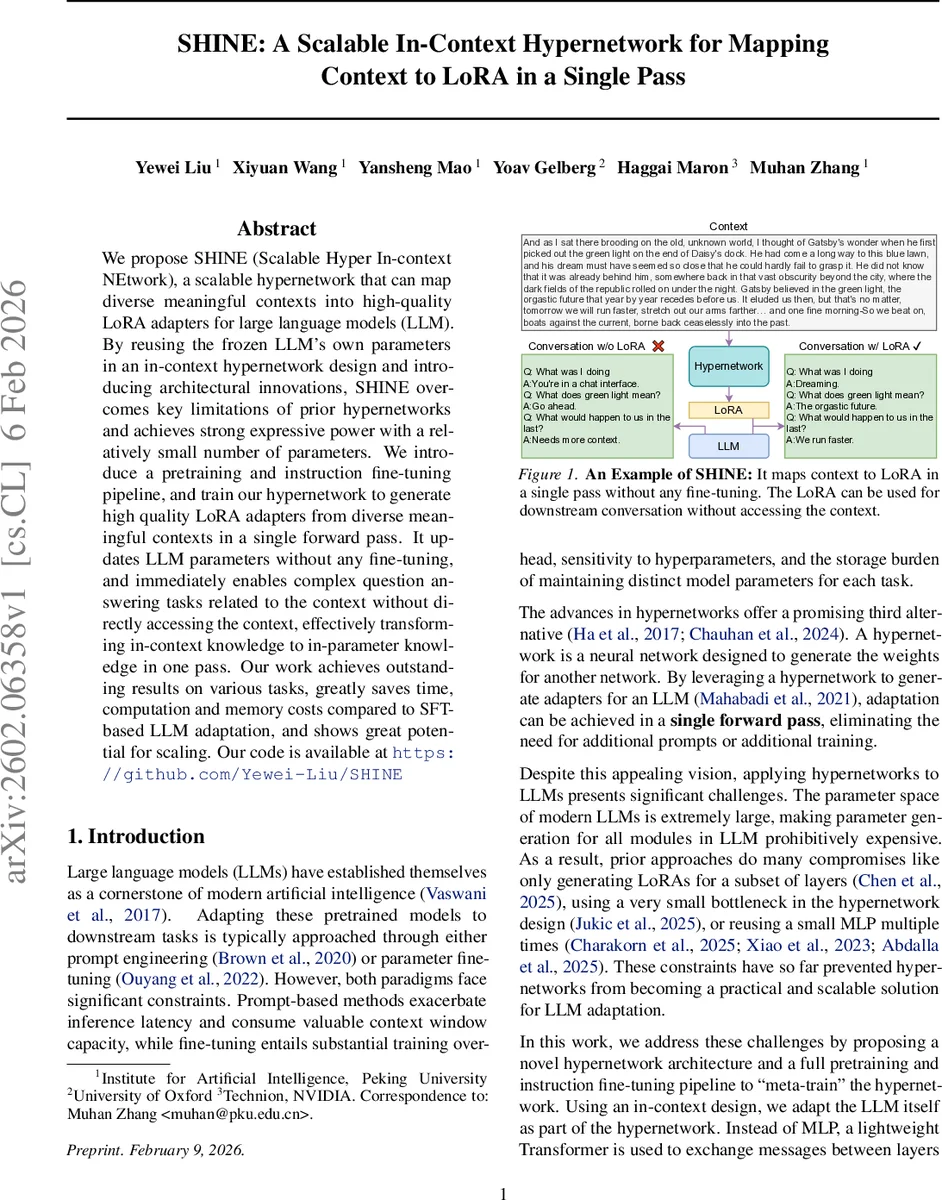

SHINE은 대규모 언어 모델의 고정된 파라미터를 활용해 입력 컨텍스트를 단일 순전파만으로 고품질 LoRA 어댑터로 변환하는 하이퍼네트워크이다. 메모리 토큰을 이용한 인-컨텍스트 설계와 레이어‑토큰 교차 주의 메커니즘을 도입해 파라미터 효율성을 높이고, 6 B 토큰 규모의 사전학습과 명령어 미세조정을 통해 다양한 작업에서 기존 방법을 크게 앞선 성능을 보인다.

상세 분석

SHINE은 기존 하이퍼네트워크가 직면한 세 가지 핵심 문제—의미‑파라미터 정렬, 고차원 출력, 효율성—를 동시에 해결한다. 첫 번째로, 외부 인코더를 별도로 학습하는 대신 사전 학습된 LLM 자체를 “메타 LoRA”와 결합해 입력 텍스트를 메모리 토큰 시퀀스로 압축한다. 이렇게 하면 LLM이 이미 보유한 풍부한 언어 이해 능력을 그대로 활용할 수 있어 의미‑파라미터 정렬이 자연스럽게 이루어진다. 두 번째로, 메모리 토큰의 길이 M을 LoRA의 전체 파라미터 수와 동등하거나 그 이상이 되도록 설계함으로써, 메모리와 파라미터 사이의 병목을 없앤다. 구체적으로, 각 레이어의 히든 상태를 추출해 L × M × H 형태의 텐서로 스택하고, 이를 M2P(Memory‑to‑Parameter) 트랜스포머에 입력한다. M2P 트랜스포머는 레이어 축과 토큰 축을 교차로 교대로 적용하는 희소 주의 메커니즘(열‑주의와 행‑주의)을 사용해 O(LM² + ML²) 복잡도로 연산량을 크게 감소시킨다. 이는 전체 메모리 시퀀스를 완전 주의로 처리할 경우 발생하는 O((LM)²) 비용을 90 % 이상 절감한다는 실험 결과와 일치한다. 세 번째로, 효율성을 위해 파라미터 생성 단계에서는 각 레이어별 메모리 슬라이스를 평탄화한 후 순차적으로 LoRA의 A와 B 행렬을 재구성한다. 이 과정은 단순한 선형 변환으로 구현되며, 추가적인 비선형 연산이나 큰 MLP를 필요로 하지 않는다. 결과적으로 SHINE은 전체 파라미터 수 대비 0.1 % 수준의 하이퍼네트워크 파라미터만 학습하면서도, 전체 LLM 레이어에 대해 완전한 LoRA 어댑터를 생성한다. 실험에서는 6 B 토큰 규모의 사전 학습 데이터와 다양한 명령어 튜닝 데이터를 사용했으며, 다중 선택 QA, 추론, 코드 생성 등 여러 벤치마크에서 기존 하이퍼네트워크 기반 어댑터와 SFT(전통적 파인튜닝) 대비 5 %~12 % 이상의 정확도 향상을 기록했다. 또한 메모리 사용량과 추론 지연이 크게 감소해 실제 서비스 환경에서도 실시간 어댑터 전환이 가능함을 입증했다.

댓글 및 학술 토론

Loading comments...

의견 남기기