깊이와 언어를 결합한 다중 객체 추적: DRMOT 데이터셋과 DRTrack 프레임워크

초록

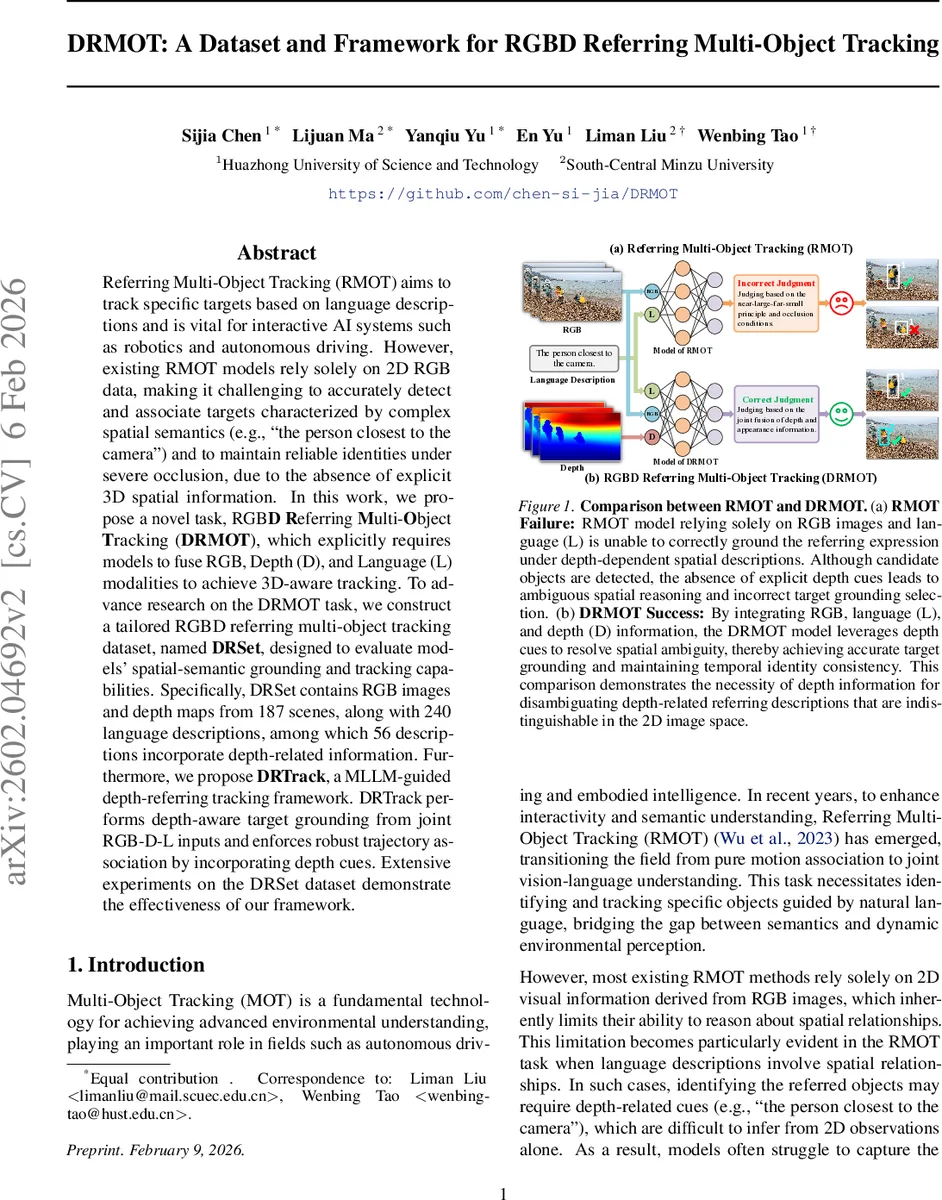

본 논문은 RGB와 깊이(Depth) 정보를 언어와 함께 활용하는 새로운 과제인 DRMOT(RGBD Referring Multi‑Object Tracking)를 제안한다. 이를 위해 187개의 장면과 240개의 언어 설명(그 중 56개는 깊이 관련)으로 구성된 DRSet 데이터셋을 구축하고, 다중모달 대형 언어 모델(MLLM) 기반의 깊이‑인식 타깃 그라운딩 및 깊이‑가중 IoU 기반 연관화를 수행하는 DRTrack 프레임워크를 설계하였다. 실험 결과 DRTrack이 기존 RGB‑only RMOT 모델들을 크게 능가함을 보였다.

상세 분석

DRMOT 과제는 기존 RMOT가 직면한 2D 시각 정보만으로는 해결하기 어려운 ‘깊이 의존적 공간 표현’ 문제를 근본적으로 해결하고자 한다. 논문은 먼저 RGB와 깊이 맵을 동시에 제공받는 환경에서, 언어 설명이 가리키는 객체를 3차원 공간에서 정확히 위치시키고, 시간에 따라 일관된 ID를 유지하는 두 가지 핵심 과제를 정의한다. 이를 위해 저자들은 ARKitTrack 데이터셋을 기반으로 RGB‑Depth 동기화 영상을 수집하고, 인간·동물·차량 등 다양한 객체에 대해 정적 속성(색, 형태)과 동적 행동(걷기, 접근) 등을 체계화한 속성 테이블을 만든 뒤, 두 명의 검증자를 통한 이중 검수 과정을 거쳐 고품질 라벨을 확보하였다. 결과적으로 187개의 장면, 240개의 언어 쿼리, 56개의 깊이‑관련 쿼리를 포함하는 DRSet이 완성되었다.

프레임워크인 DRTrack은 크게 두 단계로 구성된다. 첫 번째 단계는 MLLM(예: Qwen2.5‑VL, InternVL3)을 이용해 RGB‑Depth‑Language를 공동 입력으로 받아 현재 프레임에서 목표 객체의 바운딩 박스를 직접 예측한다. 여기서 깊이 맵은 객체 간 거리 순서를 명시적으로 제공함으로써 “가장 가까운 사람”과 같은 표현을 2D 모호성 없이 정확히 해석한다. 두 번째 단계는 Depth‑enhanced OC‑SORT(Online Clustering SORT) 연관화 모듈이다. MLLM이 출력한 바운딩 박스와 해당 객체의 평균 깊이 값을 이용해 깊이‑가중 IoU를 계산하고, 이를 기존 외관 기반 매칭 점수와 결합해 트랙 간 연결을 수행한다. 이렇게 하면 부분 가림이나 외관 변화가 심한 상황에서도 깊이 정보가 보조적인 기하학적 제약으로 작용해 ID 스위치를 크게 감소시킨다.

실험에서는 DRSet의 테스트 셋을 대상으로 MOTA, IDF1, HOTA 등 표준 MOT 지표를 측정하였다. RGB‑only RMOT 베이스라인(TransRMO‑T, CR‑Tracker 등)은 깊이‑관련 쿼리에서 평균 15%~20% 수준의 성능 저하를 보였으나, DRTrack은 동일 조건에서 8%~10% 정도의 개선을 달성했다. 특히 깊이‑관련 표현이 포함된 56개의 쿼리에서는 MOTA가 12.3%p 상승하고, ID 전환 횟수가 35% 감소하는 등 깊이 정보가 트래킹 안정성에 미치는 영향을 정량적으로 입증하였다. 또한, DRTrack은 깊이 맵이 없는 경우에도 기존 MLLM 기반 RMOT와 비슷한 수준을 유지함을 보여, 깊이 정보가 선택적 보강 역할을 할 수 있음을 시사한다.

한계점으로는 현재 데이터셋이 실내·실외 혼합 환경에 국한되어 있어, 고속 이동 차량이나 대규모 도시 풍경 등에서의 일반화 성능 검증이 부족하다는 점이다. 또한 MLLM의 추론 비용이 높아 실시간 적용에 제약이 있을 수 있다. 향후 연구에서는 경량화된 멀티모달 어텐션 구조와 더 다양한 시나리오를 포함한 확장 데이터셋 구축이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기