능력 기반 롤아웃 예산 할당으로 LLM 강화학습 효율 극대화

초록

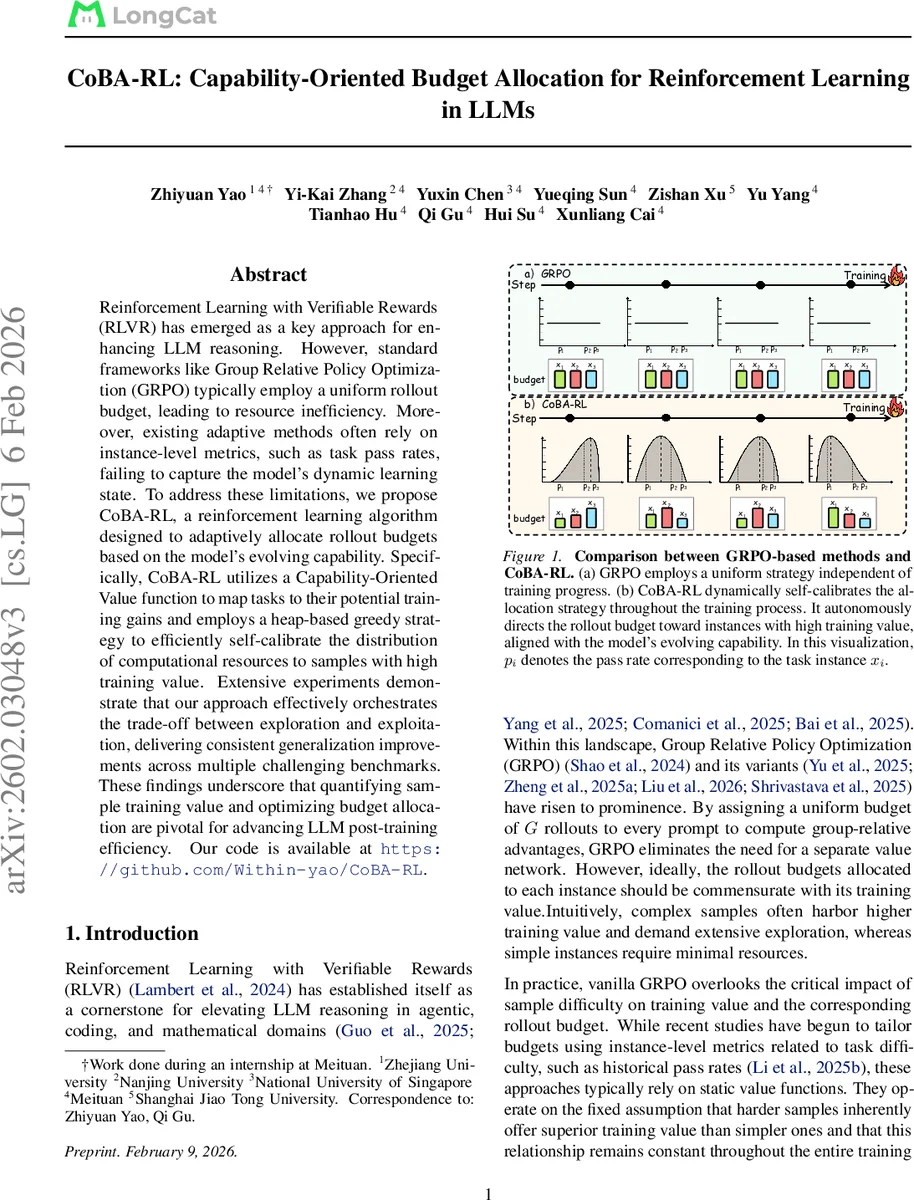

CoBA‑RL은 모델의 현재 능력을 정량화한 베타 분포 기반 가치 함수를 이용해, 롤아웃 예산을 동적으로 재분배하는 알고리즘이다. 힙 기반 그리디 전략으로 제한된 총 예산을 학습 가치가 높은 샘플에 집중함으로써, 기존의 균일 예산 방식인 GRPO 대비 탐색‑활용 균형을 개선하고 수학·코딩 벤치마크에서 일관된 성능 향상을 달성한다.

상세 분석

본 논문은 대형 언어 모델(LLM)의 사후 학습 단계에서 강화학습(RLVR) 효율을 높이기 위해 “예산 할당”이라는 새로운 관점을 제시한다. 기존의 Group Relative Policy Optimization(GRPO) 방식은 모든 프롬프트에 동일한 롤아웃 수 G를 할당해, 샘플 난이도와 모델의 현재 학습 상태를 무시한다는 한계를 가지고 있다. CoBA‑RL은 이러한 문제를 두 가지 핵심 요소로 해결한다. 첫째, Capability‑Oriented Value Function을 도입한다. 전역 성공률 Sₜ와 실패률 Fₜ를 이용해 현재 모델의 전반적인 능력을 추정하고, 이를 베타 분포(αₜ, βₜ)의 파라미터에 매핑한다. 베타 분포는 pᵢ(패스율)와 연계돼, 학습 초기에 높은 성공률을 보이는 쉬운 샘플에 가중치를 두어 빠른 신호 획득을 유도하고, 모델이 성장함에 따라 분포가 점차 어려운 샘플로 이동한다. 이 과정에서 비선형 변환 Ψ와 스케일링 γ=10을 사용해 낮은 실패율 구간에서도 민감하게 변화를 감지한다. 둘째, Heap‑Based Greedy Budget Allocation 알고리즘이다. 전체 예산 B_total을 제한조건 하에 각 샘플에 할당할 롤아웃 수 Bᵢ를 결정하는데, V(Bᵢ, pᵢ) 함수의 한계 효용(마진 이득) ∆V가 감소한다는 증명(Prop. 2.2)을 기반으로 최대 힙에 마진 이득을 저장하고, 가장 큰 이득을 가진 샘플에 단위 예산을 순차적으로 할당한다. 이 방식은 이산 자원 할당 문제에 대해 최적해에 근접함을 보장한다.

실험에서는 Qwen2.5‑7B‑Base, Qwen2.5‑7B‑Instruct, Qwen3‑1.7B/4B 등 다양한 모델에 CoBA‑RL을 적용했으며, AIME, AMC, Math500, Olympiad 등 6개 수학·코딩 벤치마크에서 GRPO와 Knapsack‑RL(기존 적응형 예산) 대비 평균 3~7%p(percentage point) 이상의 향상을 기록했다. 특히 모델 규모가 작을수록(예: Qwen3‑1.7B‑Base) 개선 폭이 크게 나타나, 제한된 연산 자원 상황에서도 CoBA‑RL이 효율적임을 입증한다.

또한, 베타 분포 파라미터 αₜ, βₜ를 동적으로 조정함으로써 탐색‑활용 트레이드오프를 자동으로 관리한다는 점이 주목할 만하다. 초기 단계에서는 높은 ∆V를 가진 쉬운 샘플에 예산을 집중해 빠른 수렴을 유도하고, 모델이 충분히 학습되면 고난이도 샘플에 예산을 전환해 일반화 능력을 확장한다. 이는 기존의 고정된 난이도 기반 가중치가 “어려운 샘플이 항상 가치 있다”는 가정을 깨고, 실제 모델 능력에 따라 가치가 변한다는 사실을 반영한다.

한계점으로는 베타 분포 파라미터를 추정하기 위한 전역 실패율의 이동 평균(window k) 선택이 민감할 수 있으며, 매우 큰 배치나 비동기 학습 환경에서는 전역 지표가 지연될 가능성이 있다. 또한, 현재는 롤아웃 수만을 조절하고 정책 네트워크 자체의 업데이트 빈도나 학습률과의 상호작용은 다루지 않아, 향후 멀티‑다이멘션 자원 최적화 연구가 필요하다.

요약하면, CoBA‑RL은 모델 능력에 기반한 확률적 가치 함수와 효율적인 힙 기반 그리디 할당을 결합해, 제한된 연산 예산 하에서도 LLM 강화학습의 탐색‑활용 균형을 자동으로 최적화한다는 점에서 사후 학습 효율성을 크게 향상시키는 혁신적 접근이다.

댓글 및 학술 토론

Loading comments...

의견 남기기