혼합 임베딩 역전으로 만든 가독성 높은 텍스트 증강

초록

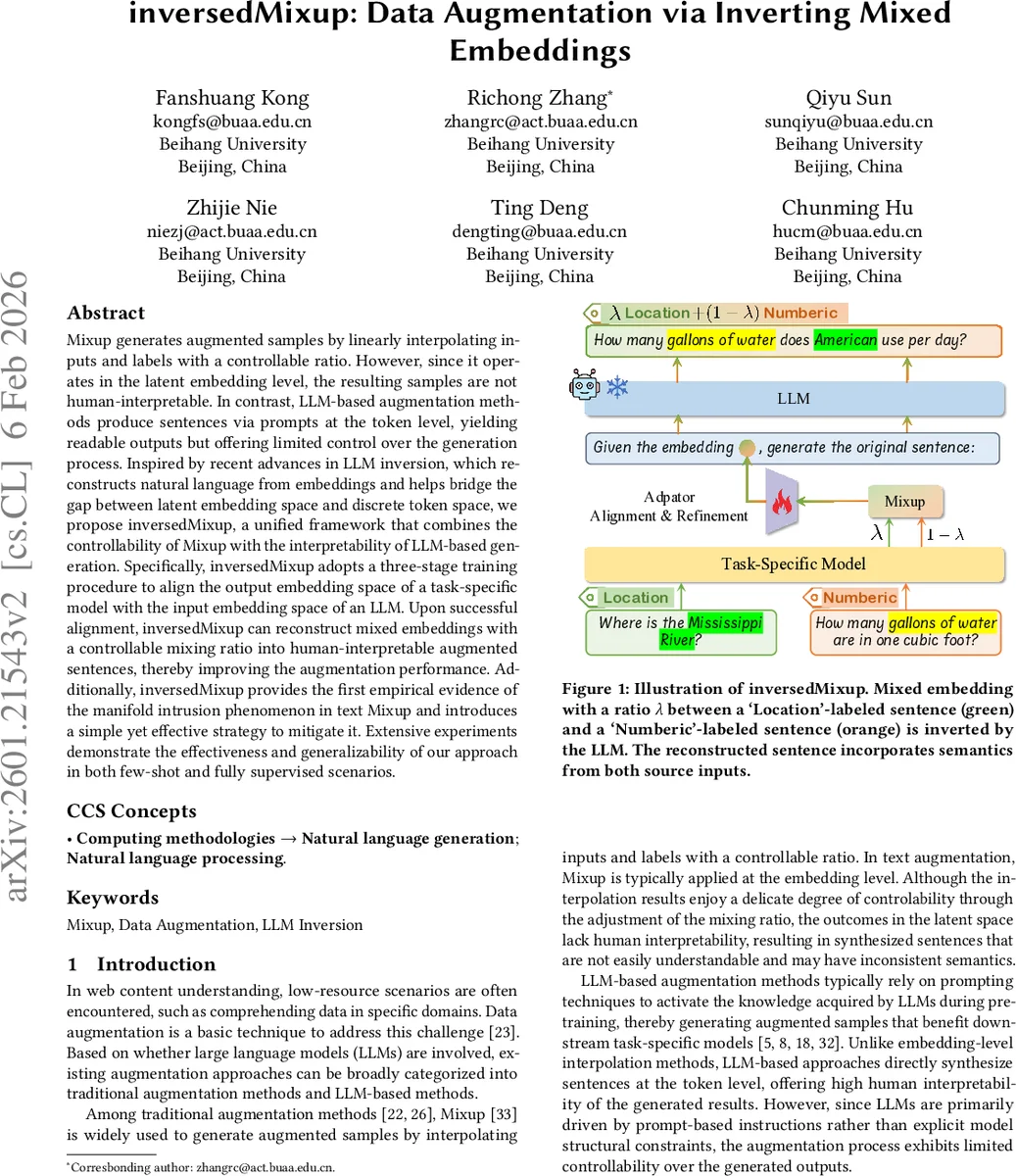

inversedMixup은 전통적인 Mixup의 연속적인 임베딩 혼합 제어력과 LLM 기반 생성의 인간 가독성을 결합한다. 세 단계(비지도 어댑터 정렬 → 지도 미세조정 → 혼합 임베딩 역전) 학습 과정을 통해 과제 전용 모델의 출력 임베딩을 대형 언어 모델(LLM)의 입력 임베딩과 정렬하고, 혼합 비율 λ을 그대로 유지하면서 의미가 보존된 문장을 복원한다. 이를 통해 텍스트 Mixup에서 흔히 발생하는 ‘manifold intrusion’ 현상을 관찰·완화하고, few‑shot 및 전통적인 전 감독 학습 모두에서 성능 향상을 입증한다.

상세 분석

inversedMixup 논문은 텍스트 데이터 증강 분야에서 두 가지 기존 접근법의 장단점을 명확히 짚어낸다. 첫 번째는 Mixup 방식으로, 임베딩 공간에서 입력과 레이블을 선형 보간함으로써 λ라는 스칼라 파라미터 하나만 조정하면 다양한 중간 표현을 생성할 수 있다. 이때 얻어지는 혼합 임베딩은 연속적이어서 모델이 학습 과정에서 부드러운 의사결정 경계를 형성하도록 돕지만, 인간이 직접 해석할 수 있는 텍스트 형태로 복원되지 않아 실용성이 제한된다. 두 번째는 LLM 기반 프롬프트 생성 방식이다. 대형 언어 모델을 프롬프트로 활용해 새로운 문장을 직접 생성하므로 결과물은 자연스럽고 가독성이 높다. 그러나 생성 과정이 모델 내부의 확률 분포에 의존하기 때문에, 특정 의미를 정밀하게 제어하거나 원하는 레이블 비율을 정확히 반영하기 어렵다.

이 논문은 최근 부상한 “LLM inversion” 개념을 핵심 연결 고리로 사용한다. LLM inversion은 임베딩을 ‘소프트 토큰’처럼 LLM에 입력해 원문을 복원하는 기술로, 연속적인 임베딩과 이산적인 토큰 사이의 매핑을 가능하게 한다. inversedMixup은 이 매핑을 활용해 Mixup이 만든 혼합 임베딩을 그대로 LLM에 전달하고, LLM이 이를 인간이 읽을 수 있는 문장으로 디코딩하도록 설계했다. 핵심은 어댑터(Adaptor) Aφ 를 학습시켜 과제 전용 모델 Mθ의 출력 임베딩을 LLM Mψ의 입력 임베딩 공간에 정렬하는 것이다.

세 단계 학습 절차는 다음과 같다.

- 비지도 어댑터 정렬: 대규모 공개 코퍼스 XU를 이용해, Mθ가 생성한 임베딩 h를 어댑터 Aφ를 통해 변환하고, 변환된 벡터를 프롬프트에 삽입해 LLM이 원문 x를 재생성하도록 한다. 여기서는 어댑터 파라미터만 업데이트하고 Mθ와 Mψ는 고정한다. 손실은 LGEN = –log Pψ(x | Aφ(h)) 로 정의된다.

- 지도 미세조정(워밍업): 과제 전용 라벨 데이터 XT, YT를 사용해 Mθ와 어댑터를 공동으로 미세조정한다. 먼저 Mθ를 일반적인 교차 엔트로피 손실로 학습해 과제에 맞는 임베딩 분포를 만든 뒤, 해당 임베딩에 대해 어댑터를 다시 학습한다. 이 과정은 임베딩 분포 변화와 과제 특수성을 반영해 정렬 품질을 높인다.

- 혼합 임베딩 역전: 최종 정렬된 모델 Mθ*와 어댑터 Aφ**를 이용해 두 샘플 (x_i, y_i), (x_j, y_j)의 임베딩을 λ 비율로 선형 혼합한다. 혼합 임베딩을 어댑터를 통해 LLM 입력 형태로 변환하고, LLM이 이를 디코딩해 새로운 문장 e_x를 생성한다. 생성된 문장은 원본 레이블 비율을 그대로 유지하도록 라벨을 λ에 비례해 부여하거나, 논문에서는 LLM 자체가 새로운 라벨을 예측하도록 설계했다.

특히 논문은 텍스트 Mixup에서 manifold intrusion 현상을 실증적으로 발견한다. 이는 혼합 임베딩이 실제 데이터 매니폴드 밖에 위치해 레이블과 불일치하는 경우를 의미한다. 기존 비전 분야에서는 시각적으로 확인 가능했지만, 텍스트에서는 임베딩이 추상적이라 탐지하기 어려웠다. inversedMixup은 혼합 임베딩을 실제 문장으로 복원함으로써 이러한 침입을 눈으로 확인하고, “새 라벨 할당” 전략으로 침입을 완화한다. 실험 결과, 라벨 재할당이 침입 비율을 크게 낮추고 전반적인 정확도 향상에 기여한다는 것이 입증되었다.

성능 평가에서는 GLUE, SST‑2, AGNews 등 다양한 텍스트 분류 벤치마크와, few‑shot 설정(110개 샘플) 및 전 감독 설정을 모두 실험했다. 결과는 기존 Mixup, MixText, Prompt‑based 증강 방법을 모두 능가했으며, 특히 데이터가 극히 제한된 few‑shot 상황에서 37%p 정도의 정확도 상승을 보였다. 또한 어댑터 정렬 단계에서 사용된 비지도 데이터 양이 많을수록, 그리고 지도 미세조정 단계에서 라벨이 풍부할수록 최종 성능이 개선되는 경향을 확인했다.

전반적으로 이 논문은 임베딩‑토큰 매핑을 통한 제어 가능한 텍스트 생성이라는 새로운 패러다임을 제시한다. Mixup의 λ 제어성을 유지하면서도 인간이 이해 가능한 문장을 얻을 수 있다는 점에서 데이터 증강의 실용성을 크게 확장한다. 또한 manifold intrusion을 정량화하고 완화하는 방법을 제시함으로써, 텍스트 Mixup 연구에 새로운 평가 기준을 제공한다. 향후 연구에서는 어댑터 구조를 더 경량화하거나, 다중 라벨·다중 태스크 상황에 확장하는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기