RMT 기반 인과 지식 증류로 모델 압축

초록

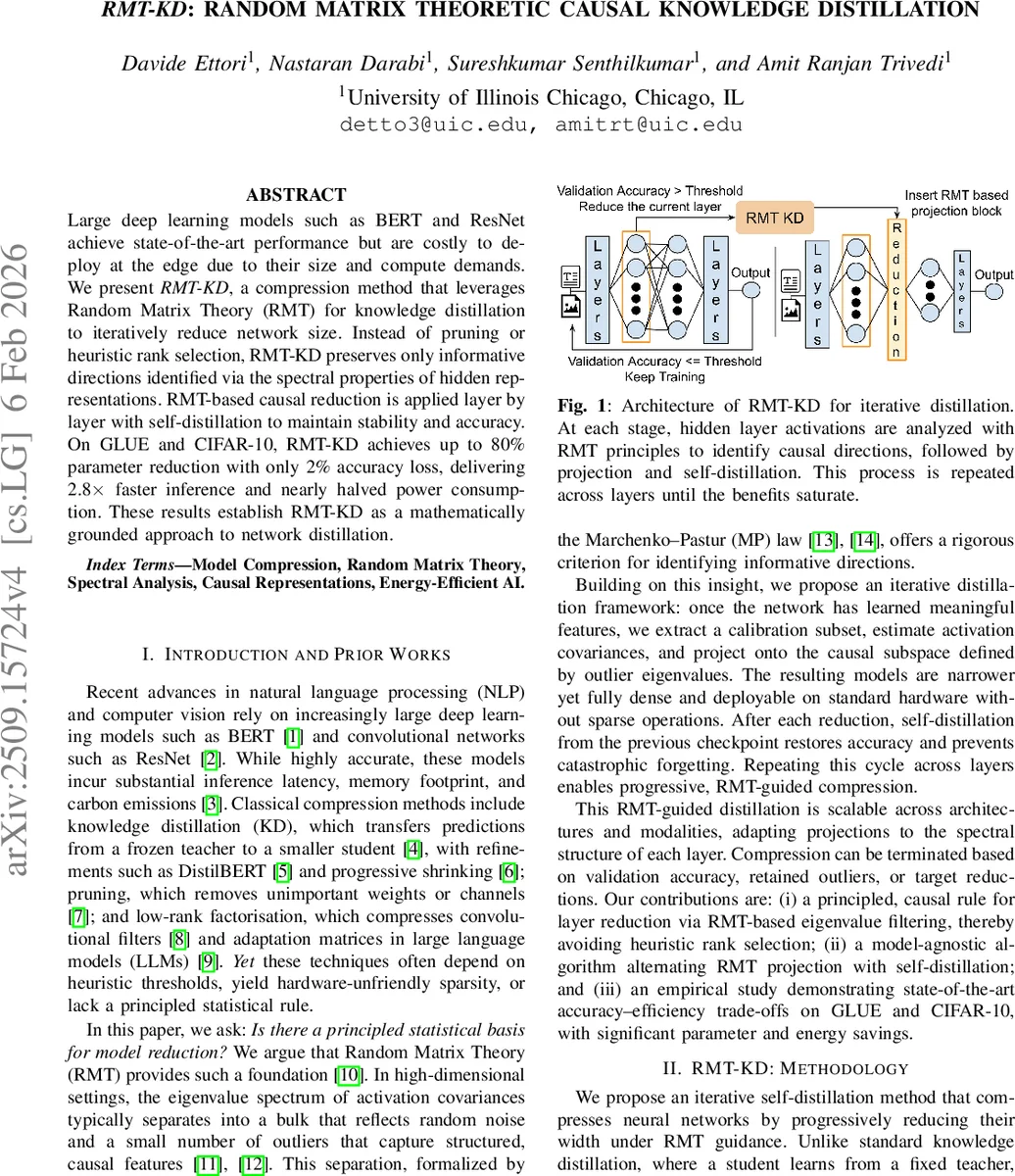

RMT‑KD는 랜덤 행렬 이론을 이용해 은닉층 활성화의 스펙트럼을 분석하고, Marchenko‑Pastur 경계 밖의 특이값을 인과적 정보로 판단한다. 이를 기반으로 각 층을 저차원 선형 투영으로 축소하고, 자체 교사(self‑distillation) 손실을 함께 최적화한다. GLUE와 CIFAR‑10 실험에서 파라미터를 최대 80 % 감소시키면서 정확도 손실은 2 % 이하에 그쳤으며, 추론 속도는 2.8배, 전력 소모는 절반 수준으로 감소했다.

상세 분석

본 논문은 대규모 딥러닝 모델을 경량화하기 위한 새로운 프레임워크인 RMT‑KD를 제안한다. 핵심 아이디어는 고차원 은닉 표현의 공분산 행렬이 랜덤 행렬 이론, 특히 Marchenko‑Pastur(MP) 법칙에 따라 잡음과 신호를 구분한다는 점에 있다. 저자들은 학습이 충분히 진행된 후, 전체 데이터의 10 %를 샘플링한 캘리브레이션 셋을 이용해 각 레이어의 활성화 행렬 X∈ℝ^{d×n}을 수집한다. 여기서 d는 레이어 차원, n은 샘플 수이며, 경험적 공분산 Σ=1/n·XXᵀ를 계산한다. Σ의 고유값 스펙트럼을 MP 분포와 비교해 λ₊(MP의 상한)보다 큰 고유값을 “스파이크”로 식별한다. 이러한 스파이크는 데이터에 내재된 구조적·인과적 정보를 담고 있다고 가정한다.

스파이크에 대응하는 고유벡터들로 구성된 투영 행렬 P∈ℝ^{k×d}(k<d)를 정의하고, 레이어의 출력에 선형 변환 X’ = P·X를 적용한다. 이렇게 차원을 축소한 뒤, 동일 모델을 교사(teacher)로 삼아 축소된 모델을 학생(student)으로 학습한다. 손실 함수는 L = α·CE(y, ŷ) + (1−α)·KL(p_teacher‖p_student) 로, 교차 엔트로피와 KL 발산을 가중합한다. 이 과정은 “자기 증류”라 불리며, 파라미터 감소에 따른 성능 저하를 최소화한다.

알고리즘은 레이어별로 순차적으로 적용되며, 각 단계마다 검증 정확도가 사전 정의된 임계값 이하로 떨어지면 압축을 중단한다. 압축 강도는 σ²(노이즈 분산)의 초기 추정값을 결정하는 분위수(quantile)를 조절함으로써 조절 가능하다. 높은 분위수는 λ₊를 크게 만들고 더 많은 차원을 제거하지만, 과도한 압축은 정확도 손실을 초래한다.

복잡도 측면에서 저자들은 공분산 행렬 구축 O(nd²)와 고유값 분해 O(d³)가 주요 비용이라고 밝힌다. 그러나 n은 전체 데이터의 10 %에 불과하고, d는 레이어 폭에 제한되므로 실제 학습 시간에 비해 무시할 수준이다. 또한 투영 연산은 밀집 행렬 곱으로 구현돼, 희소 마스크 기반 프루닝과 달리 GPU 가속에 최적화된다.

실험에서는 BERT‑base(139 M 파라미터)와 TinyBERT(44 M), ResNet‑50(23 M)을 대상으로 GLUE(SST‑2, QQP, QNLI)와 CIFAR‑10을 사용했다. RMT‑KD는 BERT‑base을 80 % 압축했음에도 평균 정확도 80.9 %를 유지했으며, TinyBERT는 58 % 압축, ResNet‑50은 48 % 압축을 달성했다. 추론 속도는 BERT‑base에서 2.8배, 전력 소모는 50 % 이상 감소했다. 비교 대상인 DistilBERT, Theseus, PKD 등과 비교했을 때, RMT‑KD는 파라미터 감소율과 정확도 유지 측면에서 일관되게 우수했다.

한계점으로는 캘리브레이션 셋의 품질에 의존한다는 점과, 스파이크가 실제 인과적 의미를 갖는지에 대한 정량적 검증이 부족하다는 점을 들 수 있다. 또한, 매우 작은 모델에서는 압축 여지가 제한적이며, 분산 환경에서의 적용 가능성에 대한 논의가 부족하다. 향후 연구에서는 랜덤 행렬 이론을 이용한 동적 압축 스케줄링, 다양한 모달리티에 대한 확장, 그리고 스파이크 검증을 위한 추가적인 통계적 테스트를 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기