다중 LLM 도덕 판단의 확률적 집합과 목표 임베딩 최적화

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

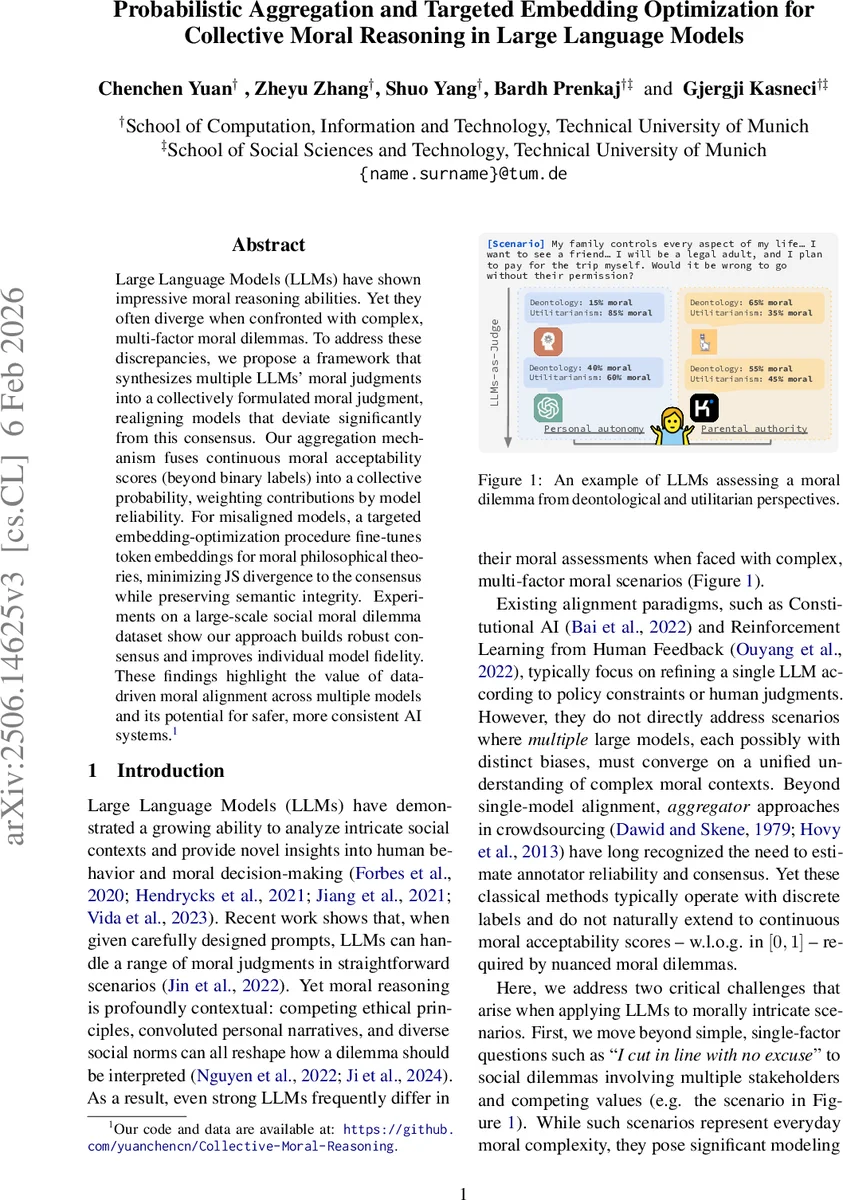

본 논문은 여러 대형 언어 모델(LLM)의 연속형 도덕 점수를 확률적 집합으로 결합하고, 합의와 크게 벗어나는 모델에 대해 도덕 이론 토큰 임베딩을 목표로 최적화하는 프레임워크를 제안한다. 트렁케이티드 정규 EM 알고리즘을 통해 모델별 신뢰도를 추정하고, 집합된 확률 γ를 도덕적 합의로 정의한다. 이후 JS 발산을 최소화하도록 선택된 토큰 임베딩을 미세조정해 모델을 정렬시킨다. 대규모 사회 도덕 딜레마 데이터(AITA) 실험에서 합의 정확도와 개별 모델의 일관성이 모두 향상됨을 보인다.

상세 분석

이 연구는 두 가지 핵심 기술적 기여를 제공한다. 첫째, 연속형 도덕 점수 aₘ,ⱼ,ᵢ∈

댓글 및 학술 토론

Loading comments...

의견 남기기