범용 열영상 인식 백본 AnyThermal

초록

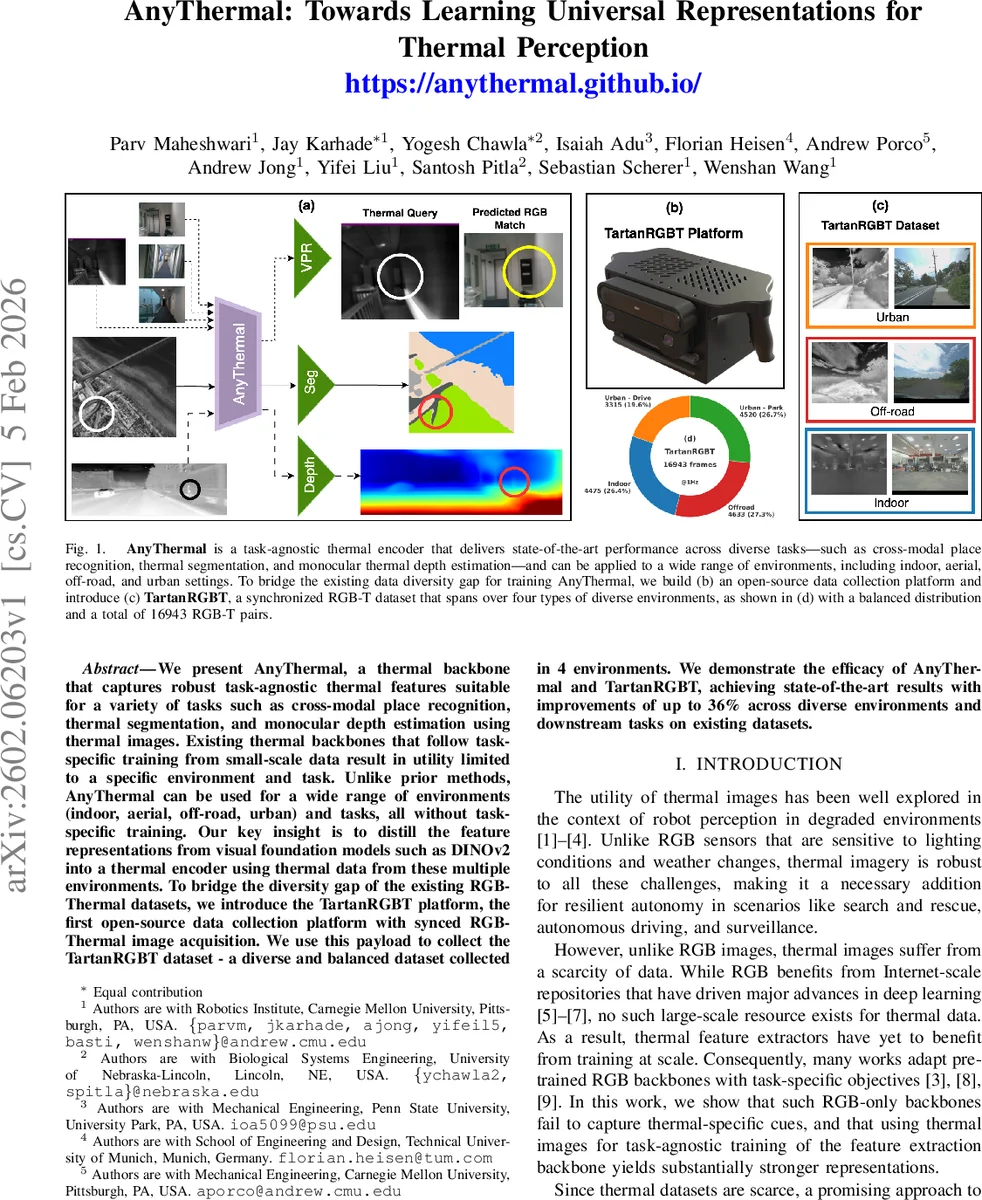

AnyThermal은 RGB 기반 대형 비전 모델(DINOv2)의 지식을 열영상에 증류하여, 별도 태스크 학습 없이도 열영상 분할, 교차 모달 장소 인식, 단일 이미지 깊이 추정 등 다양한 로봇 인식 작업에서 최첨단 성능을 달성한다. 이를 위해 저자들은 다양한 환경을 포괄하는 TartanRGBT 플랫폼과 데이터셋을 구축하고, 다중 RGB‑T 데이터로 학습된 열영상 백본을 공개한다.

상세 분석

본 논문은 열영상 인식에 대한 근본적인 한계, 즉 데이터 규모와 다양성 부족을 해결하고자 두 가지 핵심 전략을 제시한다. 첫째, 대규모 RGB 비전 파운데이션 모델인 DINOv2를 교사(teacher)로 설정하고, 동일 장면의 RGB‑열 영상 쌍을 이용해 학생(student) 모델인 열영상 인코더를 학습한다. 여기서 사용된 증류 손실은 CLS 토큰 간의 대조 손실이며, 이는 전역 의미 정보를 보존하면서도 픽셀‑레벨 정렬 요구를 완화한다. 따라서 시간 동기화가 완벽하지 않은 데이터셋에서도 효과적으로 학습할 수 있다. 둘째, 기존 RGB‑T 데이터셋은 단일 환경에 국한되는 경우가 많아 일반화가 어려웠는데, 저자들은 TartanRGBT 플랫폼을 설계해 실내, 실외(도시·주차·공원), 항공, 오프로드 등 네 가지 환경에서 16,943개의 고품질 RGB‑열 영상 쌍을 수집하였다. 이 데이터는 하드웨어 동기화, 열 카메라 캘리브레이션, 8‑bit 변환 파이프라인을 포함해 일관된 전처리를 거쳐 제공된다.

학습 과정에서 저자들은 VIT‑B/14 구조를 그대로 사용해 초기 가중치를 DINOv2에서 가져오고, 열영상 입력을 3채널(그레이스케일 복제) 형태로 변환한다. 교사 네트워크는 고정된 상태로 RGB 이미지를 처리하고, 학생 네트워크는 열영상에 대해 파라미터를 업데이트한다. 이렇게 얻어진 AnyThermal 백본은 이후 다양한 태스크‑특화 헤드와 결합된다. 예를 들어, 장소 인식에서는 SALAD 헤드와 트리플렛 마진 손실을 사용해 열 이미지 쿼리를 RGB 데이터베이스와 매칭하고, 분할에서는 두 층 비선형 MLP 헤드와 Dice 손실을 적용한다. 깊이 추정에서는 MiDaS 파이프라인에 AnyThermal를 삽입해 멀티스케일 패치 특징을 활용한다.

실험 결과는 세 가지 다운스트림 태스크 모두에서 기존 RGB‑전용 백본이나 기존 열영상 백본 대비 10 %~36 %의 성능 향상을 보여준다. 특히, 도시·주차·공원 등 복합 환경에서의 교차 모달 장소 인식에서 최고 36 %의 Recall 향상을 기록했으며, 실내 및 오프로드 환경에서도 일관된 개선을 확인했다. 또한, AnyThermal는 학습 시 사용된 다중 데이터셋 덕분에 제로샷 상황에서도 강인한 일반화를 보이며, 데이터 다양성이 증류 효율에 미치는 영향을 실증한다.

이 논문은 (1) 대규모 RGB 파운데이션 모델을 열영상에 효과적으로 전이하는 증류 프레임워크, (2) 다양한 환경을 포괄하는 오픈소스 RGB‑T 수집 플랫폼 및 데이터셋, (3) 여러 로봇 비전 태스크에 적용 가능한 범용 열영상 백본이라는 세 가지 주요 기여를 제공한다. 향후 연구에서는 더 큰 규모의 열영상 데이터와 멀티모달(라이다·레이더 등)와의 통합을 통해 로봇 인식 시스템의 전반적인 견고성을 높일 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기