LLM 구조 최적화를 위한 깊이·폭 혼합 프루닝 MoP

초록

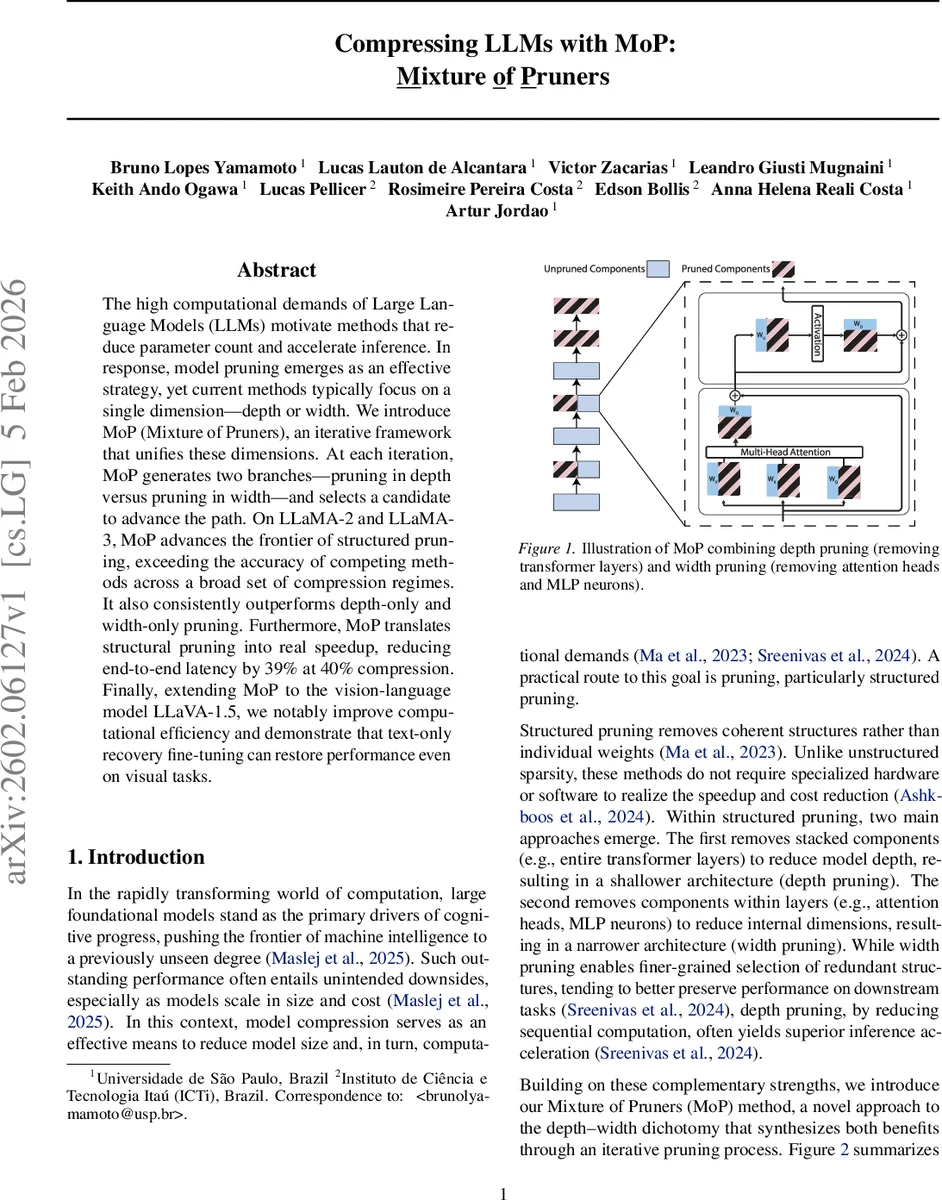

MoP는 매 반복마다 깊이 프루닝(층 제거)과 폭 프루닝(어텐션 헤드·MLP 뉴런 제거) 두 후보를 생성하고, 동일한 파라미터 감소량을 기준으로 성능 점수를 비교해 최적 경로를 선택하는 반복 프루닝 프레임워크이다. LLaMA‑2/3와 LLaVA‑1.5에 적용해 40 % 압축 시 39 % 지연 감소와 기존 단일 차원 프루닝 대비 전반적인 정확도 향상을 달성했으며, 텍스트 전용 복구 파인튜닝으로 시각‑언어 작업 성능도 회복한다.

상세 분석

MoP( Mixture of Pruners )는 구조적 프루닝의 두 축, 즉 모델 깊이(층 수)와 폭(내부 차원)을 동시에 탐색하는 새로운 반복 알고리즘이다. 핵심 아이디어는 매 단계에서 “깊이 후보”(하나의 트랜스포머 레이어 제거)와 “폭 후보”(AMP 기반 어텐션 헤드·MLP 뉴런 제거)를 동일한 파라미터 감소 비율 cₜ 로 생성하고, 짧은 파인튜닝 후 경로 기준 P(코사인 유사도, KL 발산, 퍼플렉시티 등)로 두 후보의 원본 모델 대비 손실을 정량화한다. 손실이 더 작은 후보를 실제 모델 업데이트에 반영하고, 이 과정을 목표 압축 비율 ρ 에 도달할 때까지 반복한다.

깊이 프루닝은 레이어 전체를 제거함으로써 순차 연산을 감소시켜 실제 추론 속도에 큰 이득을 주지만, 레이어 하나가 차지하는 파라미터가 많아 압축 granularity가 거칠다. 반면 폭 프루닝은 어텐션 헤드·MLP 뉴런을 세밀하게 제거해 파라미터 감소량을 미세하게 조정할 수 있지만, 연산 구조 자체는 크게 변하지 않아 속도 개선이 제한적이다. MoP는 이 두 접근법을 동적으로 조합해, 압축 단계마다 가장 손실이 적은 방향을 선택함으로써 “깊이‑폭 트레이드오프”를 자동으로 최적화한다.

알고리즘 1에서 강조된 점은 cₜ 를 레이어 하나가 차지하는 파라미터 비율로 정의하고, 폭 후보에서도 동일한 cₜ 만큼 파라미터를 제거하도록 설계했다는 것이다. 이는 두 후보가 파라미터 수에서 정확히 동등하게 비교될 수 있게 하여, 선택 편향을 최소화한다. 또한, 매 단계마다 작은 학습 서브셋 Dₜ₍tune₎ 으로 빠른 복구 파인튜닝을 수행해 후보 모델의 실제 성능을 추정한다. 이 과정은 전체 파인튜닝 비용을 크게 절감하면서도 충분히 신뢰할 만한 스코어를 제공한다.

실험에서는 LLaMA‑2 7B와 LLaMA‑3 8B에 대해 20 %60 % 압축 비율을 적용했으며, 표 1(코사인, KL, 퍼플렉시티)에서 가장 높은 평균 정확도를 보인 경로 기준은 코사인 유사도와 퍼플렉시티였지만, 차이는 미미했다. MoP는 동일 압축률에서 기존 깊이‑전용(예: LLM‑Streamline) 및 폭‑전용(예: AMP) 방법보다 평균 1.22.5 % 높은 정확도를 기록했고, 40 % 압축 시 실제 추론 지연을 39 % 감소시켰다.

멀티모달 모델 LLaVA‑1.5에 MoP를 적용한 결과, 텍스트‑전용 복구 파인튜닝만으로도 시각 질문 응답(VQA) 및 이미지 캡션 성능이 원본 대비 85 % 이상 회복되었다. 이는 폭 프루닝이 내부 표현을 크게 손상시키지 않으며, 깊이 프루닝이 남은 레이어의 순차 연산을 유지하면서도 충분한 표현력을 보존한다는 점을 시사한다.

MoP의 모듈러 설계는 향후 더 정교한 레이어 선택 기준(예: 학습 기반 메타프루닝)이나 최신 폭 프루닝 기법(예: Subset Fidelity)과도 손쉽게 결합 가능하다. 또한, 파라미터 수와 실제 하드웨어 지연 사이의 비선형 관계를 고려한 cₜ 조정 전략을 추가하면, 특정 디바이스에 최적화된 프루닝 스케줄을 설계할 여지도 있다. 전반적으로 MoP는 구조적 프루닝 연구에서 깊이와 폭을 별도 문제로 다루던 패러다임을 깨고, 두 차원을 통합적으로 탐색함으로써 압축 효율성과 실시간 추론 성능을 동시에 달성한 의미 있는 진전이다.

댓글 및 학술 토론

Loading comments...

의견 남기기