공유 LoRA 서브스페이스를 이용한 거의 엄격 연속 학습

초록

Share는 하나의 저차원 공유 서브스페이스를 지속적으로 업데이트하면서 다중 태스크와 모달리티에 대한 파라미터 효율적인 연속 학습을 가능하게 한다. 기존 LoRA 대비 100배 적은 파라미터와 281배 적은 메모리로 성능 저하 없이 지속적인 지식 축적을 달성한다.

상세 분석

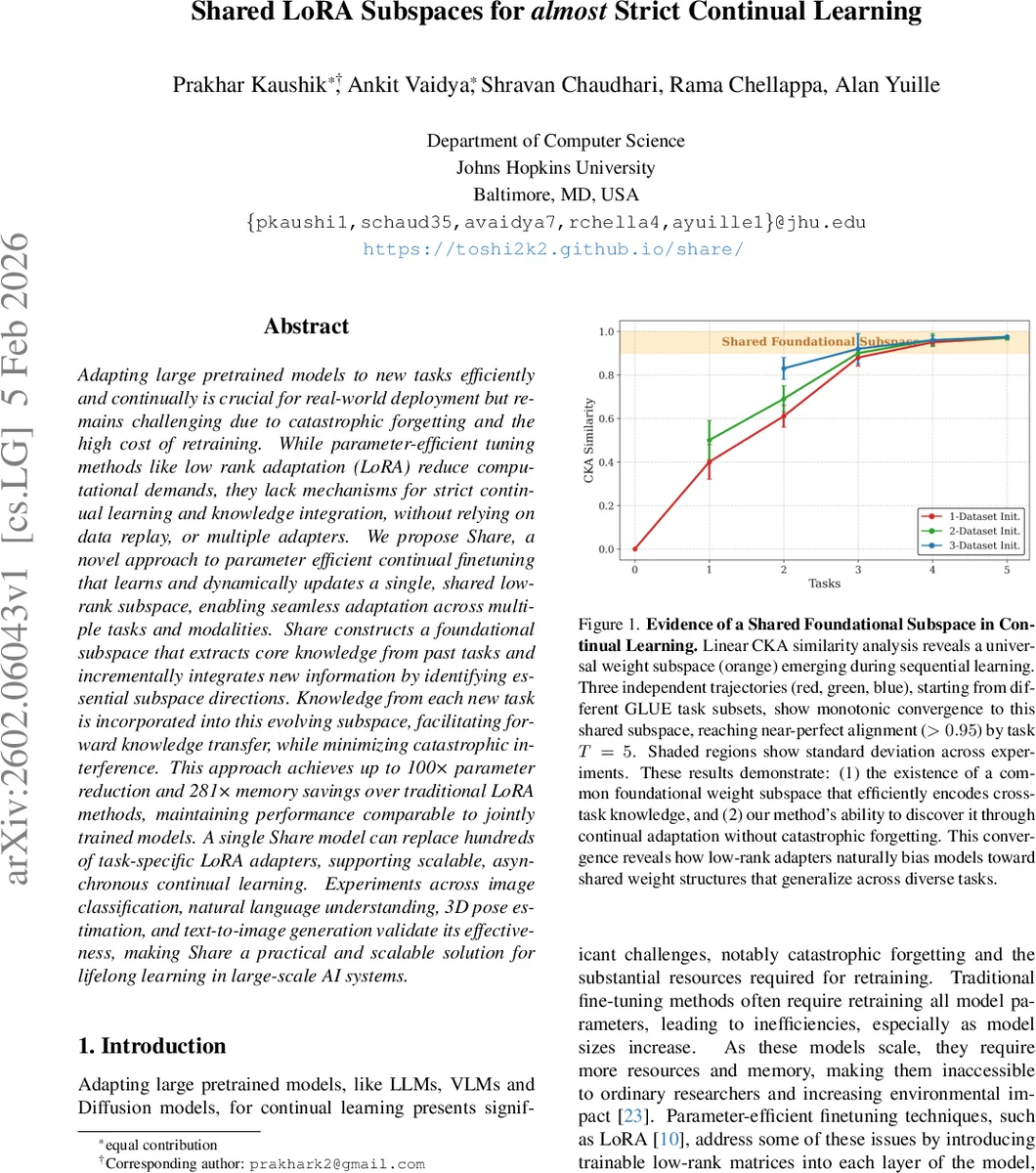

본 논문은 대규모 사전학습 모델을 연속적으로 파인튜닝할 때 발생하는 재학습 비용과 재앙적 망각(catastrophic forgetting) 문제를 해결하고자, LoRA와 같은 저차원 적응 기법을 기반으로 “공유 서브스페이스” 개념을 도입한다. 핵심 아이디어는 여러 태스크에 대해 학습된 LoRA 어댑터들이 공통된 저차원 서브스페이스에 투영될 수 있다는 가정이다. 이를 실증하기 위해 저자들은 GLUE 태스크들 사이에서 Linear CKA 유사도를 측정했으며, 태스크가 진행될수록 서브스페이스가 거의 완벽하게 수렴한다는 현상을 관찰한다(유사도 >0.95).

Share는 세 단계로 구성된다. 첫 번째 단계인 초기화에서는 기존 LoRA 어댑터(또는 초기 데이터에 대해 학습된 어댑터)들을 모아 행렬을 구성하고, 평균 중심화 후 SVD를 수행해 상위 k개의 주성분(β, α)을 추출한다. 이 주성분들은 “기본 서브스페이스”로 고정되고, 이후 학습에서는 매우 작은 차원(p)만큼의 계수 ε만을 업데이트한다. 두 번째 단계인 연속 적응에서는 새로운 태스크가 도착하면 φ (< k)개의 임시 기반 벡터와 해당 계수를 추가 학습한다. 이때 추가 파라미터는 기존 LoRA의 r·(n+d) 대비 현저히 적으며, 학습 비용이 크게 감소한다. 세 번째 단계인 병합·미세조정에서는 임시 기반을 기존 서브스페이스와 결합해 새로운 주성분을 재계산하고, Moore‑Penrose 역행렬을 이용해 각 태스크별 계수를 폐쇄형 형태로 재구성한다. 이 과정은 그래디언트가 필요 없는 분석적 절차이므로 메모리와 연산량이 최소화된다.

이론적 분석에서는 누적된 LoRA 파라미터 행렬 Dₜ를 스택한 뒤, k개의 주성분으로 근사했을 때 발생하는 서브스페이스 근사 오차를 상한으로 제시한다. 제안된 방법은 “증분 서브스페이스 오류 한계”를 만족함을 보이며, 이는 새로운 태스크가 기존 서브스페이스에 크게 왜곡을 주지 않음을 의미한다.

실험에서는 이미지 분류, 3D 포즈 추정, 자연어 이해(GLUE), 텍스트‑투‑이미지 생성 등 네 가지 도메인에 걸쳐 Share를 평가한다. GLUE 연속 학습 실험에서 Share는 LoRA 대비 파라미터를 0.012 M(≈100배 감소)로 줄였음에도 평균 정확도/상관계수에서 0.3~1.5% 수준의 미세한 손실만 보였다. 특히 “Share‑full” 변형에서는 이전 태스크 데이터에 제한적으로 접근해 계수를 추가 미세조정함으로써 약간의 역전이(backward transfer)까지 달성한다. 메모리 측면에서는 기존 LoRA 어댑터가 수백 개 필요했던 상황을 하나의 Share 모델로 대체함으로써 281배 메모리 절감 효과를 확인했다.

강점으로는 (1) 데이터 리플레이 없이 순수 연속 학습을 지원한다는 점, (2) 파라미터와 메모리 효율성이 극대화돼 실제 배포 환경에 적합하다, (3) 다양한 모달리티와 모델 아키텍처에 일반화 가능하다는 점을 들 수 있다. 반면 제한점으로는 (a) 초기 서브스페이스를 형성하기 위해 충분한 수의 초기 어댑터가 필요할 수 있다는 점, (b) φ와 k, p와 같은 하이퍼파라미터 선택이 태스크 특성에 따라 민감하게 작용할 가능성, (c) 현재는 주성분을 고정하고 계수만 학습하는 구조이므로, 급격히 다른 도메인으로 전이될 때 서브스페이스 자체의 재구성이 필요할 수 있다.

전체적으로 Share는 “공유 저차원 서브스페이스”라는 새로운 관점을 통해 파라미터 효율적인 연속 학습을 실현했으며, 기존 LoRA 기반 어댑터들의 저장·전송 비용을 획기적으로 낮추는 동시에 성능 저하를 최소화한다는 점에서 실용적 가치가 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기