GUARDIAN 적대적 공격에 대비한 인식 모델 안전 필터링

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

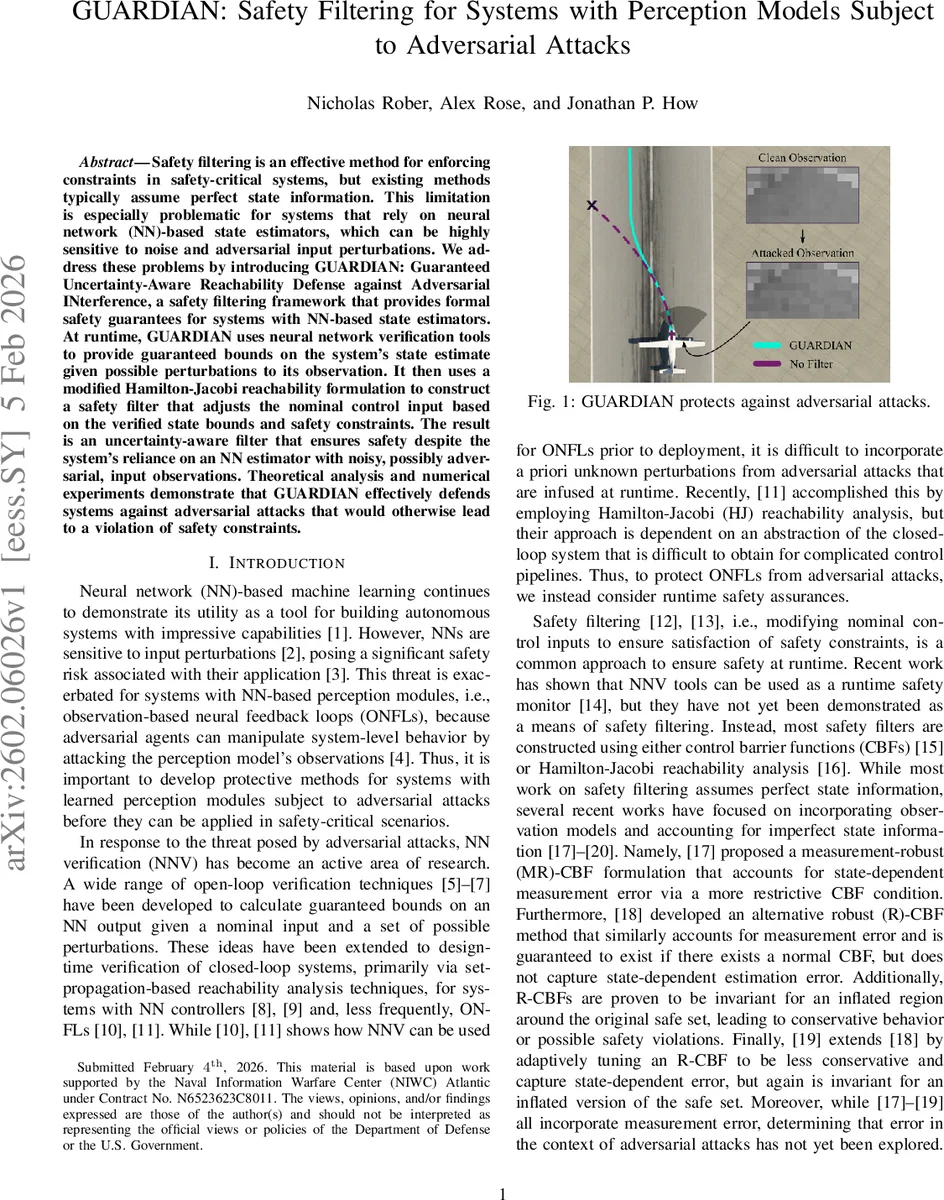

본 논문은 신경망 기반 상태 추정기가 노이즈와 적대적 교란에 취약한 문제를 해결하기 위해, 런타임에 신경망 검증 도구로 추정 오차 경계를 확보하고, 이를 수정된 Hamilton‑Jacobi 도달 가능성 분석에 통합한 안전 필터링 프레임워크 GUARDIAN을 제안한다. 이 방법은 상태 불확실성을 고려한 제어 입력 조정을 통해, 적대적 교란이 존재하더라도 시스템이 안전 집합을 이탈하지 않도록 보장한다.

상세 분석

GUARDIAN은 기존 안전 필터링이 완전한 상태 정보를 전제로 하는 한계를 극복한다. 핵심 아이디어는 두 단계로 구성된다. 첫 번째 단계에서는 최신 신경망 검증(NNV) 기법—예를 들어 CROWN, auto‑LiRPA, jax‑verify—을 활용해 관측값 y에 대한 ℓ∞ 반경 ϵ의 적대적 교란을 고려한 입력 집합 (\bar Y_t)를 정의하고, 이 집합에 대해 신경망 추정기 (L_\theta)의 출력 상하한 (

댓글 및 학술 토론

Loading comments...

의견 남기기