효율적인 비디오 융합을 위한 상태공간 모델 MambaVF

초록

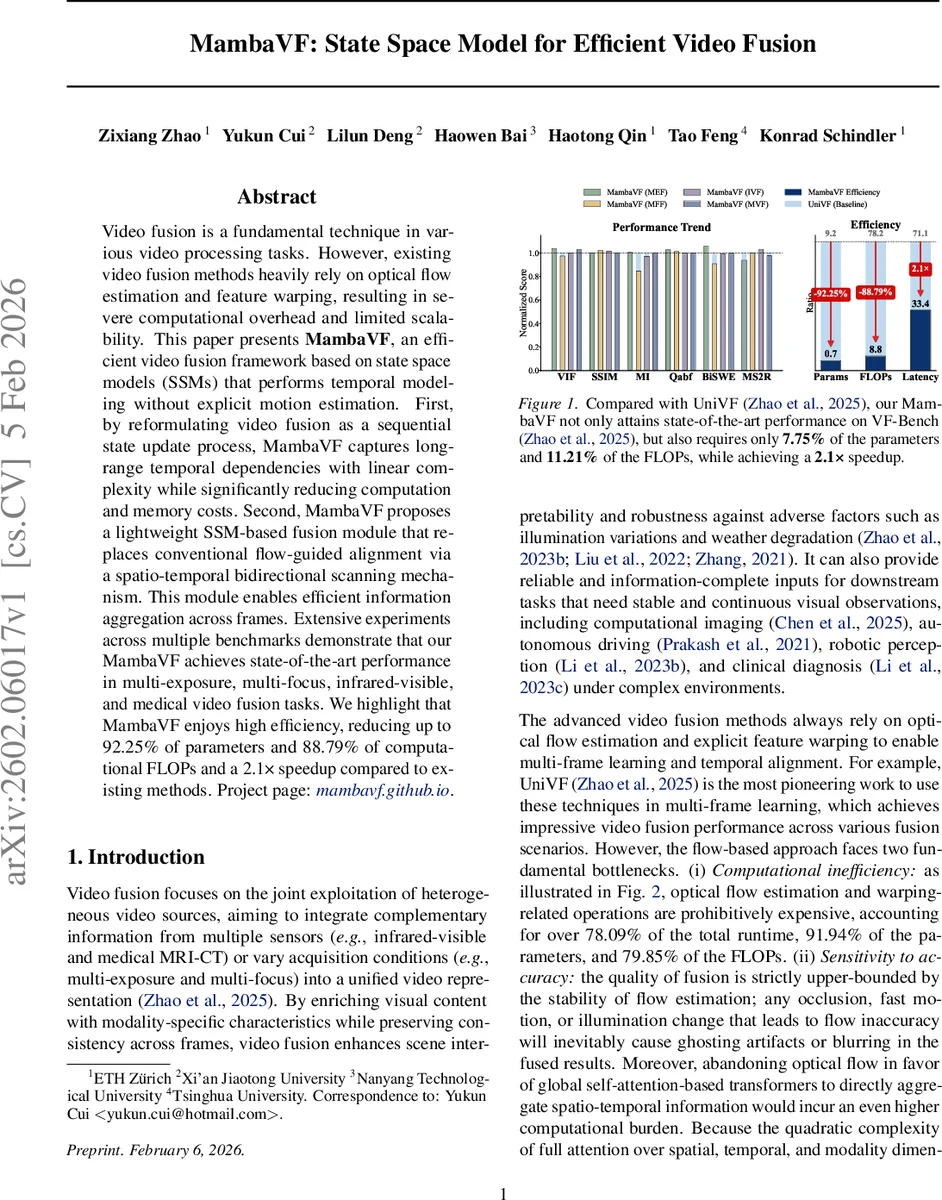

MambaVF는 광학 흐름과 특징 워핑 없이 상태공간 모델(SSM)을 이용해 영상 간 시간적 의존성을 선형 복잡도로 학습한다. 8방향 시공간 양방향 스캔(STB) 메커니즘을 도입해 다중 모달·다중 노출·다중 초점·의료 영상 등 다양한 융합 시나리오에서 기존 최첨단 방법과 동등하거나 우수한 성능을 보이며, 파라미터 92 %·FLOPs 89 % 절감과 2.1배 속도 향상을 달성한다.

상세 분석

본 논문은 비디오 융합 분야에서 가장 큰 병목으로 지목되는 광학 흐름 추정과 특징 워핑을 완전히 배제하고, 상태공간 모델(SSM) 기반의 Mamba 아키텍처를 활용한 새로운 프레임워크 MambaVF를 제안한다. 기존 UniVF와 같은 흐름 기반 방법은 전체 연산량의 78 % 이상을 흐름 추정·워핑에 소비하며, 흐름 오류에 취약해 급격한 움직임이나 조명 변화 시 고스트 현상이 발생한다. 반면 MambaVF는 시퀀스를 연속적인 상태 업데이트 과정으로 재구성함으로써, 시간적 연속성을 내부 hidden state가 자연스럽게 유지하도록 설계하였다.

핵심 기술은 두 가지로 요약된다. 첫째, “Spatio‑Temporal Bidirectional (STB) scanning” 메커니즘이다. 기존 2D Mamba가 4방향(대각선) 스캔을 이용해 이미지 내 전역 정보를 포착하던 것에 대비해, MambaVF는 8방향(공간‑우선, 시간‑우선, 그리고 각각의 역방향) 스캔을 적용한다. 이는 영상 큐브를 (W, H, T) 순서와 (T, W, H) 순서 등 다양한 축으로 재배열해 토큰 시퀀스를 생성하고, 각 시퀀스에 대해 선택적 스캔(selective scan) 연산을 수행함으로써, 프레임 간 움직임을 명시적 흐름 없이도 암묵적으로 정렬한다. 두 번째는 “Tri‑Axis Mamba Encoder‑Decoder” 구조이다. 두 입력 소스(예: 적외선·가시광) 각각에 독립적인 트리‑축 Mamba 인코더를 두어 소스 고유의 특성을 보존하고, 인코더 출력은 채널 차원에서 concat 후 Mamba 디코더에 전달한다. 디코더는 4‑way 공간 스캔만을 사용해 중심 프레임을 고해상도로 복원함으로써, 시공간 모델링은 인코더에서, 세부 복원은 디코더에서 각각 최적화된다.

학습 손실은 공간·그라디언트·시간 일관성을 동시에 고려한 다중 항 손실(L_spatial, L_grad, L_temp)로 구성된다. 특히 L_temp는 흐름 기반 보정 없이도 프레임 간 부드러운 전이를 강제한다. 실험에서는 VF‑Bench의 네 가지 대표 시나리오(MEF, MFF, IVF, MVF)에서 PSNR, SSIM, MI 등 정량 지표와 시각적 품질 모두에서 기존 최고 성능을 유지하면서, 파라미터는 7.75 %, FLOPs는 11.21 % 수준으로 크게 감소하였다. 또한 GH200 GPU 4대 기준 2.1배 실시간 속도 향상을 기록, 경량화와 고성능을 동시에 달성한 점이 주목할 만하다.

이러한 설계는 (1) 흐름 추정 오류에 대한 내성, (2) 선형 복잡도에 기반한 장시간 시퀀스 처리 가능성, (3) 다중 모달 간 교차 정보를 효과적으로 통합하는 구조적 장점으로 요약된다. 향후 연구에서는 STB 스캔의 방향성을 학습적으로 최적화하거나, 압축된 토큰 표현을 이용해 초저전력 디바이스에 적용하는 방안이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기