다국어 대형 언어 모델의 가치 선택, 폴리글롯인가 다중성인가

초록

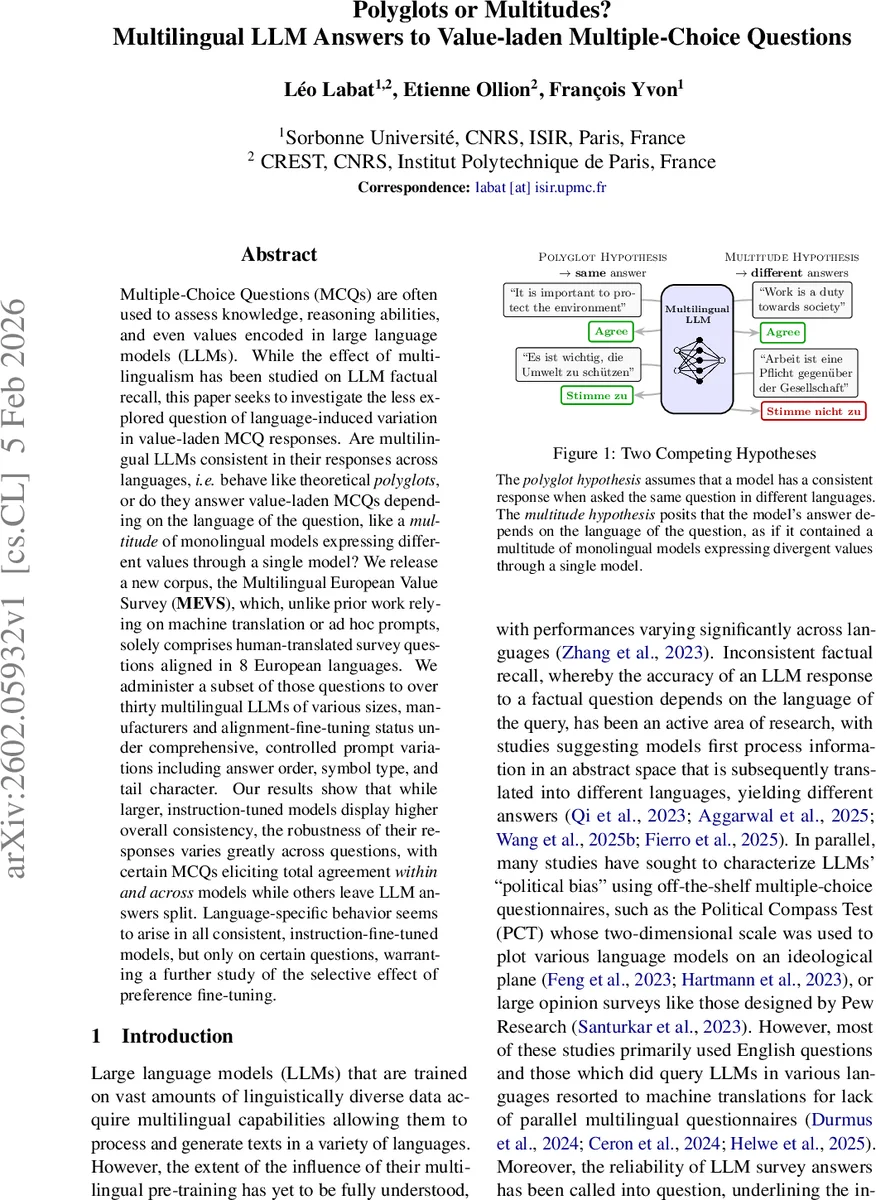

본 논문은 8개 유럽 언어로 인간 번역된 설문 문항을 모은 MEVS 코퍼스를 활용해, 30여 개의 다국어 LLM이 가치‑중심 MCQ에 대해 언어별 일관성을 보이는지 조사한다. 모델 크기와 instruction‑fine‑tuning 여부가 일관성에 미치는 영향을 측정하고, 답변 순서·기호·마지막 문자 등 프롬프트 변형에 대한 민감성을 분석한다. 결과는 대형 instruction‑tuned 모델이 전반적으로 높은 일관성을 보이지만, 질문마다 일관성 정도가 크게 차이나며, 일부 질문에서는 언어에 따라 뚜렷한 차이가 나타남을 보여준다.

상세 분석

이 연구는 기존의 기계 번역 기반 다국어 평가가 갖는 의미론적 왜곡을 배제하기 위해, 인간 번역으로 정제된 8개 언어(체코어, 영어, 프랑스어, 독일어, 노르웨이어, 포르투갈어, 러시아어, 스페인어)로 구성된 Multilingual European Value Survey(MEVS)를 구축하였다. MEVS는 5점 Likert 척도의 가치‑관련 질문 142개를 포함하며, 각 질문은 정확히 동일한 의미와 선택지를 유지하도록 다단계 정렬 과정을 거쳤다.

실험에는 EuroLLM, LLaMA 3, Qwen 2.5, Mistral Nemo, Salamandra, Aya, Gemma 2 등 다양한 오픈‑소스 다국어 모델을 포함했으며, 모델 크기와 instruction‑fine‑tuning 여부에 따라 30여 종을 비교하였다. 각 질문에 대해 답변 순서(5! = 120가지), 기호 유형(문자·숫자), 마지막 문자(공백·줄바꿈·없음) 등 3가지 프롬프트 변형을 전부 적용해 총 720 × 8 = 5760개의 프롬프트를 생성, 모델별 로그 확률 기반 MCP(Multiple‑Choice Prompting) 방식으로 답을 추출하였다.

일관성 평가는 Rényi 엔트로피와 Proportion of Plurality Agreement(PPA)를 사용했으며, 전체 5점 척도와 의미적으로 묶은 Agree/Neutral/Disagree 3점 척도로 각각 계산하였다. 결과는 크게 두 가지 패턴을 보였다. 첫째, 대형 instruction‑tuned 모델(예: LLaMA 3‑70B, Qwen 2.5‑7B)은 평균 PPA가 85 % 이상으로 높은 일관성을 유지했지만, 특정 질문에서는 엔트로피가 급격히 상승해 답변이 2‑3가지로 분산되는 현상이 관찰되었다. 둘째, 언어별 차이는 전체 모델에서 일관된 방향성을 보이지 않았다. 일부 질문에서는 독일어와 프랑스어에서 ‘강하게 동의’가 우세했으나, 영어와 스페인어에서는 ‘중립’이 다수였으며, 이는 해당 질문이 문화적·사회적 배경에 민감함을 시사한다.

또한 프롬프트 변형 실험에서 답변 순서에 대한 민감도가 가장 크게 나타났으며, 특히 특정 순서에서는 로그 확률이 급변해 다른 선택지가 최고 확률을 차지했다. 기호 유형과 마지막 문자 역시 미세하지만 통계적으로 유의한 영향을 미쳤다. 이러한 결과는 현재 LLM이 “첫 토큰 확률”에 과도하게 의존하고 있음을 보여주며, 가치‑중심 설문에서 신뢰할 수 있는 결과를 얻기 위해서는 프롬프트 표준화가 필수적임을 강조한다.

결론적으로, 모델 규모와 instruction‑fine‑tuning이 일관성을 향상시키지만, 질문별로 언어‑특정 편향이 존재하고, 프롬프트 미세 조정에 따라 답변이 변동한다는 점에서 “폴리글롯”과 “다중성” 가설이 모두 부분적으로 타당함을 확인했다. 향후 연구는 preference‑fine‑tuning이 언어별 편향을 어떻게 완화하거나 강화하는지, 그리고 인간 설문 응답과의 정량적 일치도를 어떻게 개선할 수 있는지를 탐구해야 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기