작은 추론 모델의 환각 단계 보상 중단: 신뢰성 인식 단계별 강화학습

초록

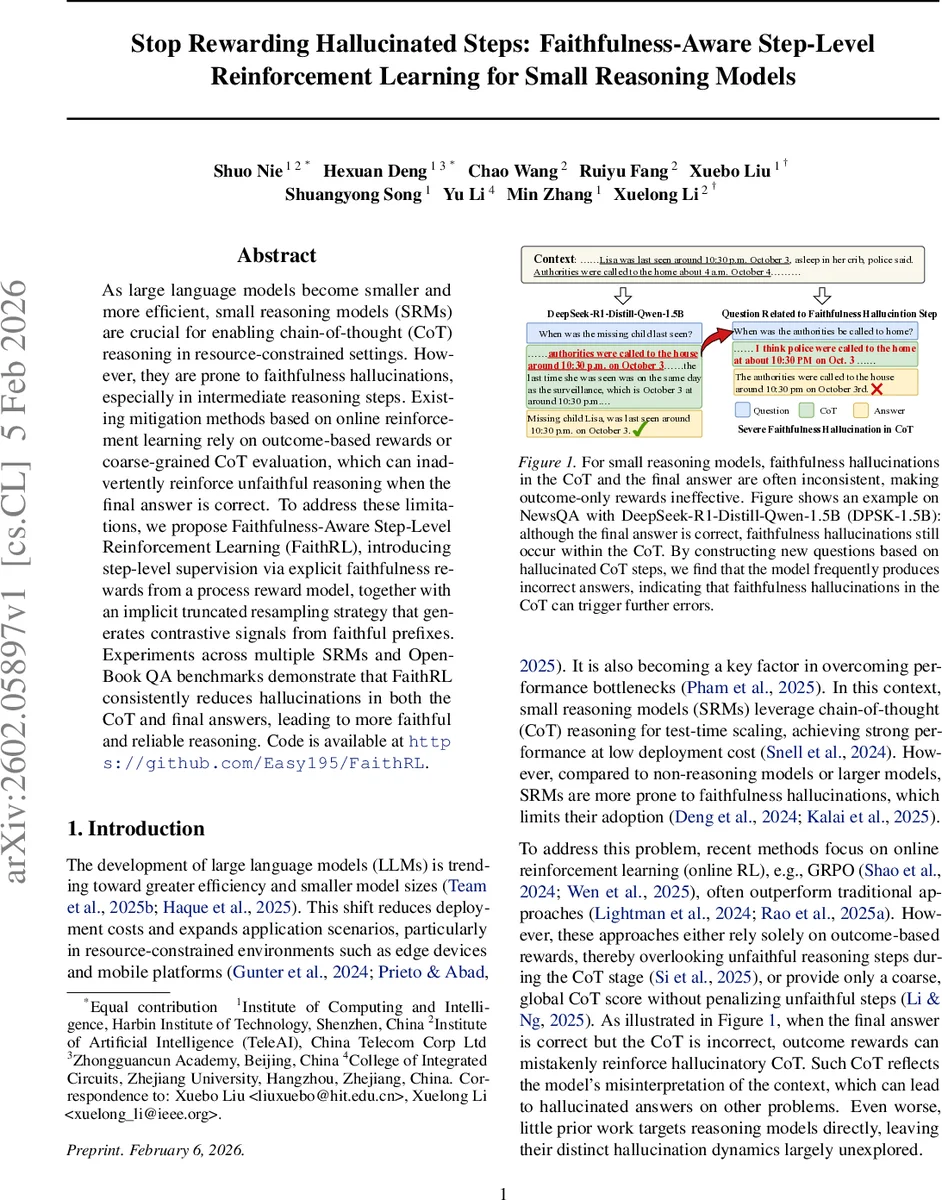

본 논문은 소형 추론 모델(SRM)이 체인‑오브‑쓰(Chain‑of‑Thought, CoT) 과정에서 발생시키는 신뢰성 환각을 해결하기 위해, 단계별 신뢰성 보상을 제공하는 FaithRL(Faithfulness‑Aware Step‑Level Reinforcement Learning) 방법을 제안한다. 명시적 단계 보상과 암시적 트렁케이션 재샘플링을 결합해, 중간 추론 단계가 원문과 일치하는지를 평가하고, 비신뢰성 단계가 포함된 경로를 교정한다. 다양한 SRM과 오픈북 QA 벤치마크에서 기존 방법 대비 답변 및 CoT의 신뢰성 지표를 평균 3~4% 향상시켰다.

상세 분석

본 연구는 소형 추론 모델이 대규모 언어 모델에 비해 연산 비용은 낮지만, 중간 추론 단계에서 원문과 불일치하는 ‘신뢰성 환각(faithfulness hallucination)’을 빈번히 일으키는 문제를 지적한다. 기존의 온라인 강화학습 기법(GRPO 등)은 최종 정답의 정확도만을 보상으로 사용하거나 CoT 전체에 대한 거친 점수를 부여한다. 이러한 방식은 최종 정답이 맞더라도 중간 단계가 비신뢰성일 경우, 오히려 그 비신뢰성 단계가 강화되는 역효과를 초래한다. 논문은 이를 해결하기 위해 두 가지 핵심 메커니즘을 도입한다. 첫째, ‘프로세스 보상 모델(Process Reward Model, PRM)’을 활용해 각 CoT 단계마다 신뢰성 점수를 계산하고, 명시적 단계 보상(explicit step‑level reward)으로 부여한다. PRM은 사전 학습된 LLM을 파인튜닝해, 단계가 주어진 컨텍스트와 일치하는지를 0‑1 형태로 판단한다. 둘째, ‘동적 트렁케이션 재샘플링(Dynamic Truncated Resampling, DTR)’이라는 암시적 보상 방식을 제안한다. 비신뢰성 단계가 탐지되면 해당 단계 이후의 토큰을 재생성하고, 원본과 재생성된 경로를 비교해 대조 신호(contrastive signal)를 만든다. 이 과정은 트리 구조의 롤아웃을 형성해, 동일한 프리픽스를 공유하는 두 경로 간의 차이를 통해 비신뢰성 단계에 대한 페널티를 자동으로 부여한다. 또한, 보상 해킹을 방지하기 위해 보상 스케일링과 클리핑을 적용하고, PRM의 출력에 일정 수준의 노이즈를 주입해 과도한 보상 집중을 완화한다. 실험에서는 DPSK‑1.5B, Qwen‑3‑0.6B 등 다양한 규모의 SRM을 대상으로 SQuAD, NewsQA, TriviaQA, NQ, HotpotQA 등 오픈북 QA 데이터셋에서 평가하였다. 결과는 FaithRL이 기존 GRPO, Dual‑GRPO, FSPO 등과 비교해 답변 정확도(F1)와 신뢰성 비율(Faithful Rate) 모두 평균 3.8%p, 3.5%p씩 개선함을 보여준다. 특히 CoT 단계별 신뢰성 지표인 CoT Faith와 Key CoT Faith가 크게 상승했으며, ‘정답은 맞지만 CoT가 비신뢰성인 경우’를 공격해 새로운 질문을 생성했을 때의 성공률이 기존 방법 대비 15~20%p 감소했다. 이는 모델이 비신뢰성 추론을 학습 단계에서 억제함을 의미한다. 전반적으로 FaithRL은 단계별 보상을 통해 SRM이 보다 투명하고 검증 가능한 추론 과정을 학습하도록 유도하며, 작은 모델에서도 고신뢰성 CoT를 구현할 수 있음을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기