시점 전환으로 할당 중심 추론을 풀다

초록

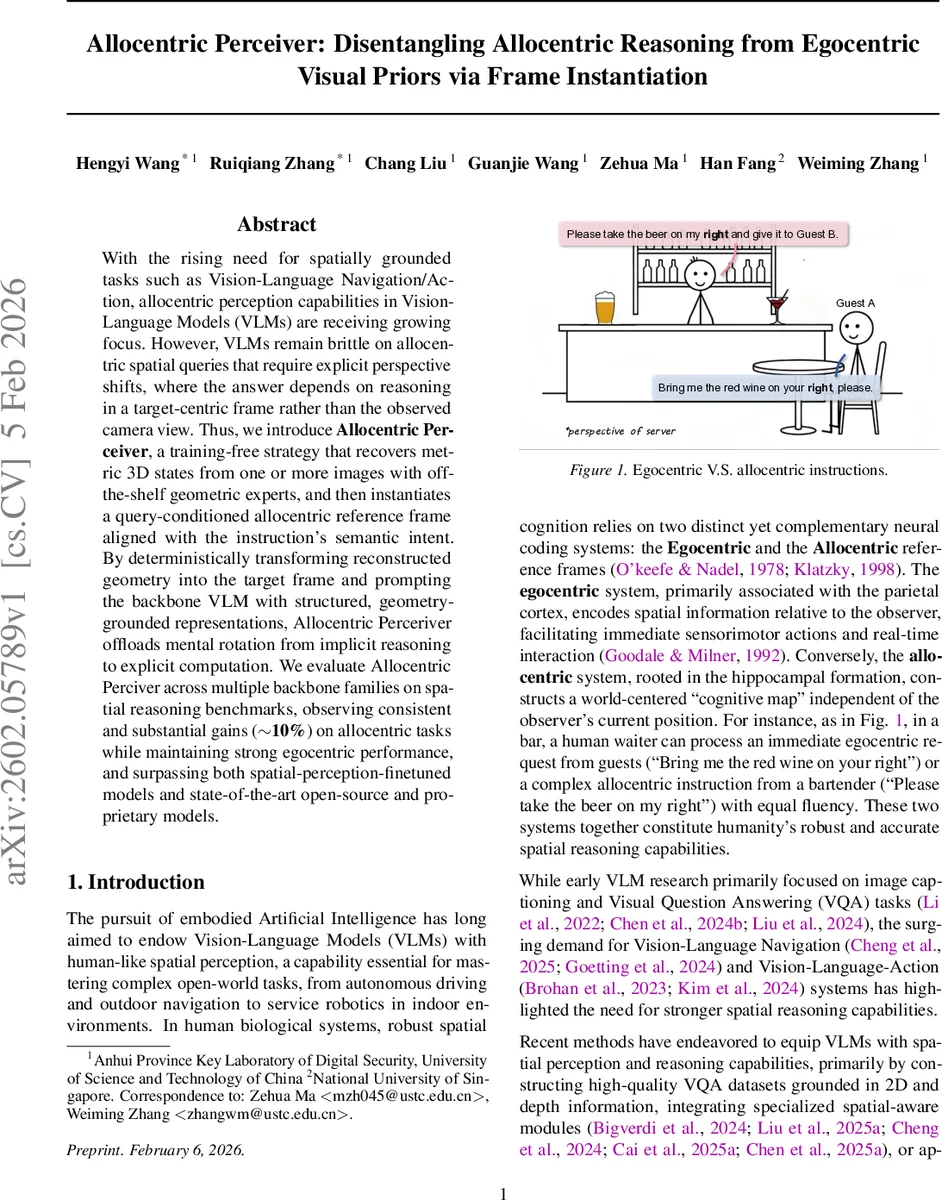

본 논문은 Vision‑Language Model(VLM)이 카메라 시점(egocentric)에서 할당 중심(allocentric) 공간 질문에 취약한 문제를 해결하기 위해, 사전 학습 없이 이미지에서 메트릭 3D 상태를 복원하고, 질의 의도에 맞는 할당 중심 좌표계를 동적으로 생성한 뒤, 기하학적으로 정형화된 텍스트 프롬프트로 VLM에 전달하는 “Allocentric Perceiver” 프레임워크를 제안한다. 다양한 백본 모델에 적용했을 때 할당 중심 작업에서 평균 10% 이상의 정확도 향상을 보이며, 기존 egocentric 성능도 유지한다.

상세 분석

Allocentric Perceiver는 VLM이 내재하고 있는 “시점 격차(Reference Frame Gap)”를 명시적으로 해소한다는 점에서 혁신적이다. 기존 VLM은 대규모 이미지‑텍스트 쌍을 학습하면서 시점 정보를 구분하지 못해, egocentric 시각적 편향이 allocentric 질의에 혼란을 주는 현상을 보였다. 논문은 이를 “시각‑의미 모호성(Visual‑Semantic Ambiguity)”이라 명명하고, 텍스트만으로는 해결하기 어려운 구조적 문제임을 실험적으로 입증한다.

프레임워크는 세 단계로 구성된다. 첫 번째 단계인 Metric‑Aware Egocentric Perception에서는 LangSAM을 이용해 질의에 등장하는 객체를 2D에서 검출하고, Depth‑Anything‑3과 카메라 내·외부 파라미터를 활용해 각 객체의 픽셀을 3D 포인트 클라우드로 역투영한다. 다중 뷰가 존재할 경우 DBSCAN 기반 클러스터링으로 잡음과 파편을 정제하고, 가장 높은 이미지‑텍스트 매칭 점수를 가진 클러스터를 최종 객체 표현으로 채택한다.

두 번째 단계인 Dynamic Frame Instantiation은 질의에서 추출한 “참조 객체(Reference Object)”를 새로운 좌표계의 원점으로 삼고, 해당 객체의 방향성을 추론해 회전 행렬을 구성한다. 여기서는 객체의 내재적 의미(예: 사람의 앞쪽)와 주변 관계(예: “왼쪽에 있는”)를 결합해 v_front, v_right, v_down 축을 정의한다. 이렇게 정의된 allocentric 프레임 F_allo는 세계 좌표계 W와 명시적인 변환 T: W→F_allo를 제공한다.

세 번째 단계인 Symbolic Geometry Reasoning에서는 변환된 3D 좌표를 “Object (x,y,z)”, “distance (dx,dy,dz)”와 같은 구조화된 텍스트로 요약하고, 이를 VLM에 프롬프트한다. VLM은 이제 순수히 기하학적 관계에 기반해 질문에 답변하므로, 기존에 필요했던 “정신적 회전(mental rotation)”을 외부 계산으로 대체한다.

실험에서는 Qwen2.5‑VL‑7B와 InternVL2.5‑8B 등 여러 최신 VLM에 동일 파이프라인을 적용했으며, ViewSpatial‑Bench의 allocentric 서브셋에서 평균 10% 이상의 정확도 상승을 기록했다. 흥미롭게도 egocentric 성능도 소폭 개선되었는데, 이는 정밀한 3D 복원이 이미지‑텍스트 매칭을 강화시켰기 때문으로 해석된다. 또한, 기존의 fine‑tuned 혹은 프롬프트‑기반 방법보다 훈련 비용이 전혀 들지 않음에도 불구하고 경쟁력 있는 결과를 보여, 실제 로봇 시스템이나 AR/VR 응용에 바로 적용 가능함을 시사한다.

핵심 기여는 (1) 시점 격차를 정의하고 실증적 근거를 제시한 점, (2) 외부 3D 전문가와 기하학적 변환을 결합한 훈련‑프리 프레임워크를 제안한 점, (3) 다양한 백본에 대해 일관된 성능 향상을 입증한 점이다. 향후 연구는 더 정교한 객체 방향 추정, 실시간 다중 뷰 통합, 그리고 인간‑로봇 협업 시나리오에서의 인터랙티브 프레임 전환 등에 확장될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기