재무 RAG에서 세밀한 지식 검증으로 환각 방지

초록

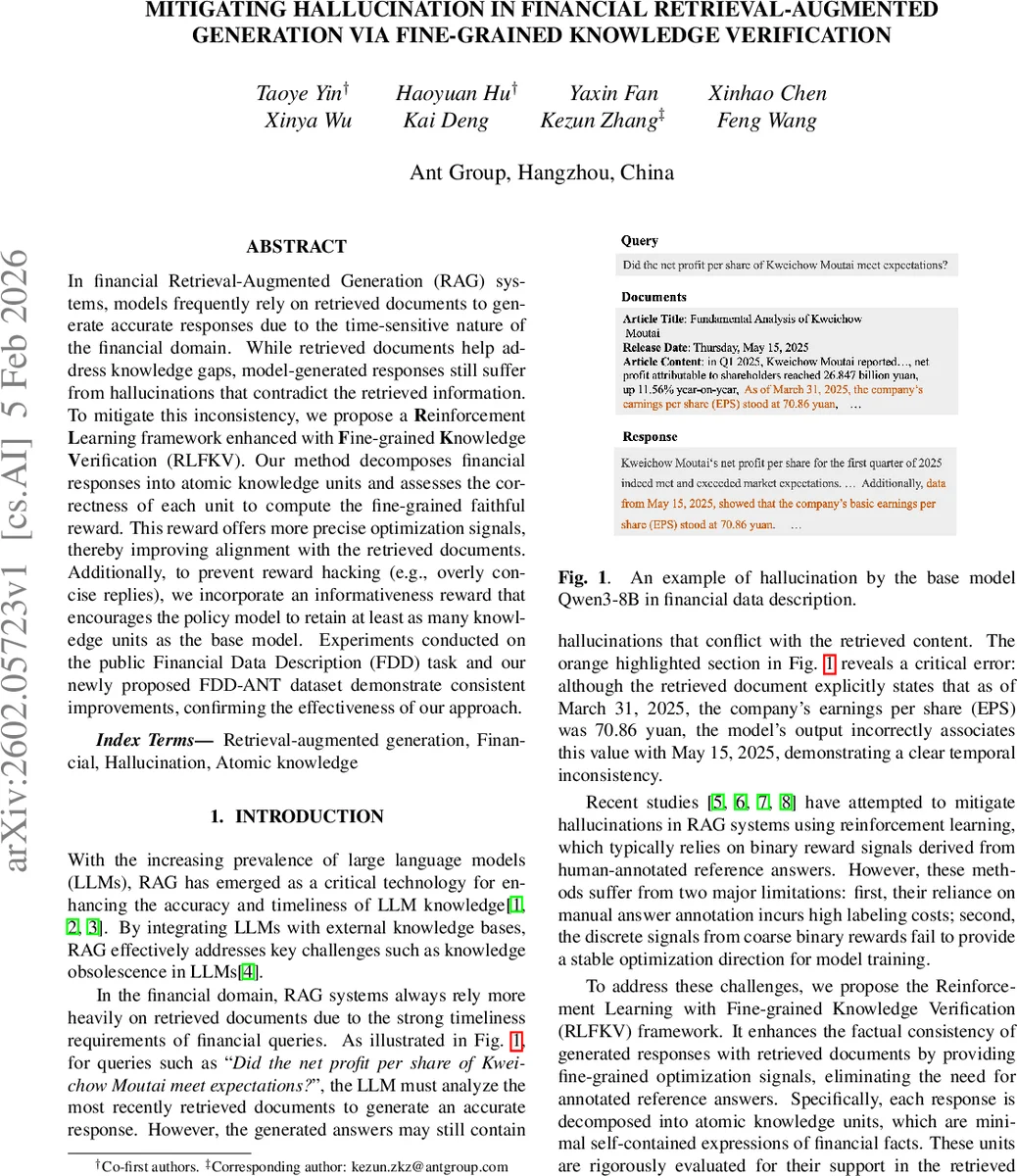

본 논문은 금융 분야의 검색‑증강 생성(RAG) 시스템에서 발생하는 사실 왜곡(환각)을 줄이기 위해, 응답을 원자적 지식 단위로 분해하고 각 단위의 정합성을 문서와 비교해 세밀한 보상을 제공하는 강화학습 프레임워크(RLFKV)를 제안한다. 또한, 과도한 응답 축소를 방지하기 위해 정보량 보상을 도입하였다. FDD와 새로 구축한 FDD‑ANT 데이터셋에서 기존 모델 대비 사실성·정보성 모두에서 유의미한 향상을 입증한다.

상세 분석

RLFKV는 두 단계로 구성된다. 첫 번째 단계에서는 사전 학습된 평가 모델(Qwen3‑32B)을 활용해 생성된 답변을 “원자적 지식 단위”(atomic knowledge unit, AKU)로 분해한다. 금융 텍스트의 특성을 반영해 (엔터티, 메트릭, 값, 타임스탬프) 네 요소로 구성된 4‑튜플 형태를 정의함으로써, 시간 민감도와 수치 정확성을 동시에 포착한다. 이 과정은 특수 프롬프트와 금융 메트릭 사전을 이용해 자동화되며, 각 AKU는 독립적인 사실 검증 대상이 된다.

두 번째 단계에서는 동일한 평가 모델이 AKU와 검색된 문서 D 사이의 일치 여부를 0/1 이진 점수(s_i)로 판단한다. 이 점수를 기반으로 두 종류의 보상이 계산된다. 첫 번째인 사실성 보상(r_f)은 오류 AKU 개수(score)를 지수 감쇠 함수와 상한 γ를 적용해 부드러운 페널티를 부여한다. 이는 다수의 오류가 존재하더라도 보상이 급격히 감소하지 않게 하여 학습 안정성을 높인다. 두 번째인 정보성 보상(r_i)은 정책 모델이 기본 모델(π_0)이 생성한 AKU 수 k_0 이상을 유지했는지를 확인하는 이진 제약이다. 이렇게 설계된 보상은 “보상 해킹”을 방지하면서도 응답의 풍부함을 유지한다.

전체 보상 r은 r_f와 r_i의 평균이며, GRPO(Generalized PPO) 기반 정책 업데이트식에 KL 발산 제약을 추가해 급격한 파라미터 변화를 억제한다. 학습은 1 epoch, 학습률 1e‑6, 배치 1, 8 GPU 환경에서 수행되었다.

실험에서는 공개된 FDD 데이터와 저자들이 새로 만든 FDD‑ANT(주식, 펀드, 거시경제 지표 포함) 두 데이터셋을 사용했다. 평가 지표는 GPT‑4o 기반 사실성 점수(100/60/0)와 AKU 개수 기반 정보성 점수이다. RLFKV를 적용한 Qwen3‑8B와 LLaMA3.1‑8B는 각각 기본 모델 대비 사실성 3.03.6점, 정보성 0.51.5점 상승을 보였다. 특히 정보성 보상을 제외한 경우 사실성은 유지되지만 정보성 점수가 현저히 감소함을 통해 두 보상의 상호 보완성을 확인했다.

세부 오류 분석에서는 시간 누락(55%), 시간 부정확(28%), 수치 오차(17%)가 주요 남은 문제로 드러났다. 이는 현재 AKU 검증이 “존재 여부”만 판단하고 “정확한 시간 표현”이나 “소수점 처리”까지는 다루지 못함을 시사한다. 향후 연구에서는 시간 표현 정규화와 수치 오차 최소화를 위한 추가 검증 모듈을 도입할 여지가 있다.

전반적으로 RLFKV는 인간 라벨링 없이도 세밀한 사실성 신호를 생성해 RAG 모델을 효과적으로 정제하며, 금융처럼 최신성·정확성이 중요한 도메인에 적합한 접근법임을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기