공정성 제약을 고려한 투사 부스팅: 공정 학습 분포의 비용 정량화

초록

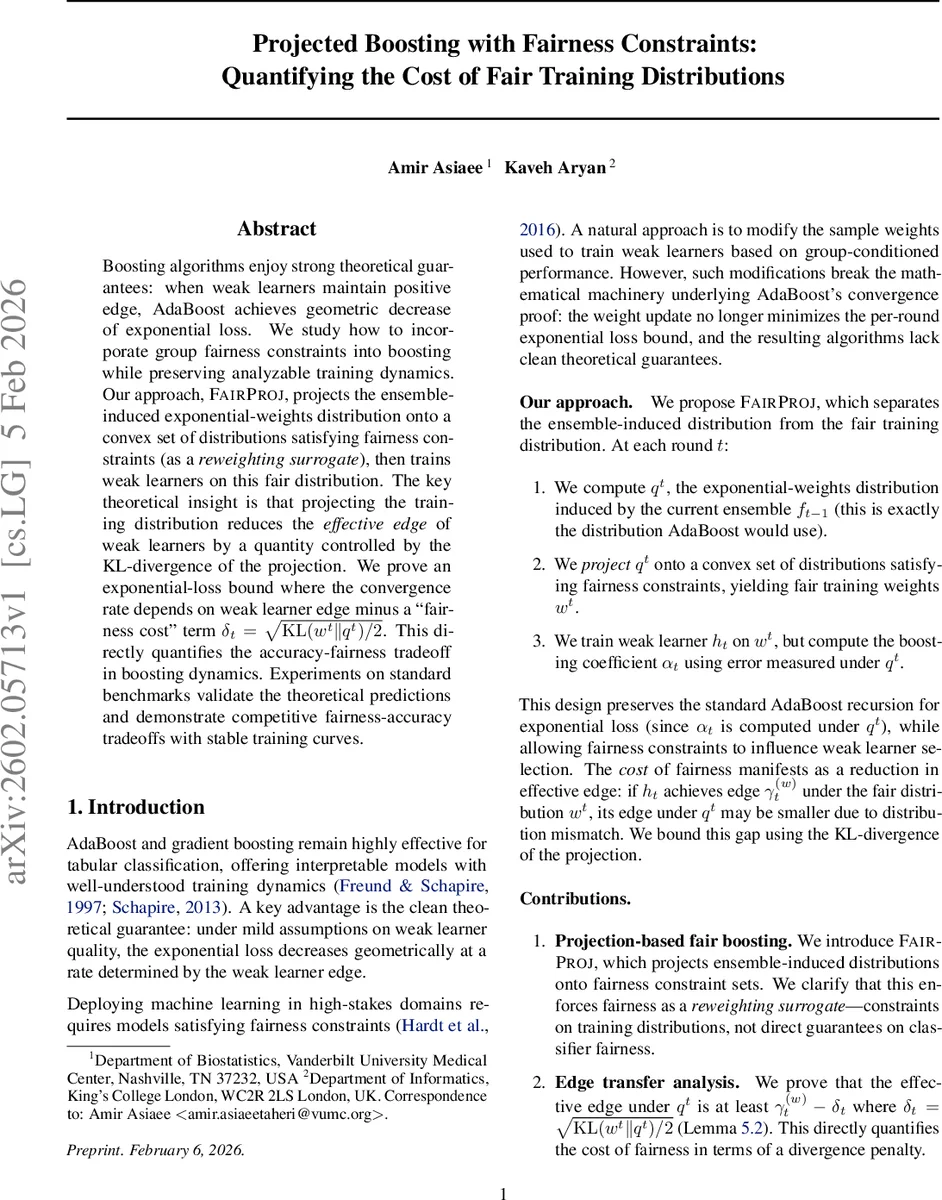

본 논문은 AdaBoost의 이론적 수렴성을 유지하면서 그룹 공정성 제약을 적용하는 새로운 알고리즘 FairBoost(FairPROJ)를 제안한다. 매 라운드마다 현재 앙상블이 만든 지수 가중 분포 qₜ를 공정성 제약 집합 Cₑ에 KL‑투사하여 공정 가중치 wₜ를 얻고, 이를 이용해 약학습자를 학습한다. 그러나 부스팅 계수 αₜ는 여전히 qₜ 위에서 계산하므로 기존의 지수 손실 재귀식이 보존된다. 핵심 이론은 투사로 인한 KL 발산이 약학습자의 유효 엣지를 δₜ=√(KL(wₜ‖qₜ)/2)만큼 감소시킨다는 점이며, 이를 통해 “공정성 비용”을 명시적으로 정량화한 지수 손실 상한을 증명한다. 실험은 이론적 예측과 정확‑공정성 트레이드오프가 실제 데이터셋에서 기대대로 나타남을 확인한다.

상세 분석

FairBoost는 AdaBoost의 핵심 메커니즘을 두 단계로 분리한다. 첫 번째 단계는 기존 AdaBoost와 동일하게 현재 앙상블 fₜ₋₁이 만든 지수 가중 분포 qₜ를 계산한다. 두 번째 단계에서는 이 qₜ를 공정성 제약을 만족하는 집합 Cₑ에 KL‑투사하여 새로운 가중치 wₜ를 만든다. 여기서 Cₑ는 선형 모멘트 제약 ∑₁ⁿ wᵢ g_k(i) ≤ ε (k=1,…,K) 로 정의되며, g_k는 그룹‑조건부 통계량을 나타내는 함수이다. KL‑투사는 엔트로피 기하학에서 자연스러운 거리이며, 라그랑주 이중화에 의해 닫힌 형태 wᵢ ∝ qᵢ·exp(−λᵀg(i)) 와 λ* 를 최소화하는 K‑차원 볼록 최적화 문제로 변환된다.

학습자는 wₜ 에 따라 약학습자 hₜ를 훈련하고, 그 오류 ε(q)ₜ는 qₜ 위에서 측정한다. 따라서 부스팅 계수 αₜ = ½·ln

댓글 및 학술 토론

Loading comments...

의견 남기기