EgoPoseVR: VR 헤드셋과 RGB‑D 카메라를 결합한 실시간 전신 포즈 추정 시스템

초록

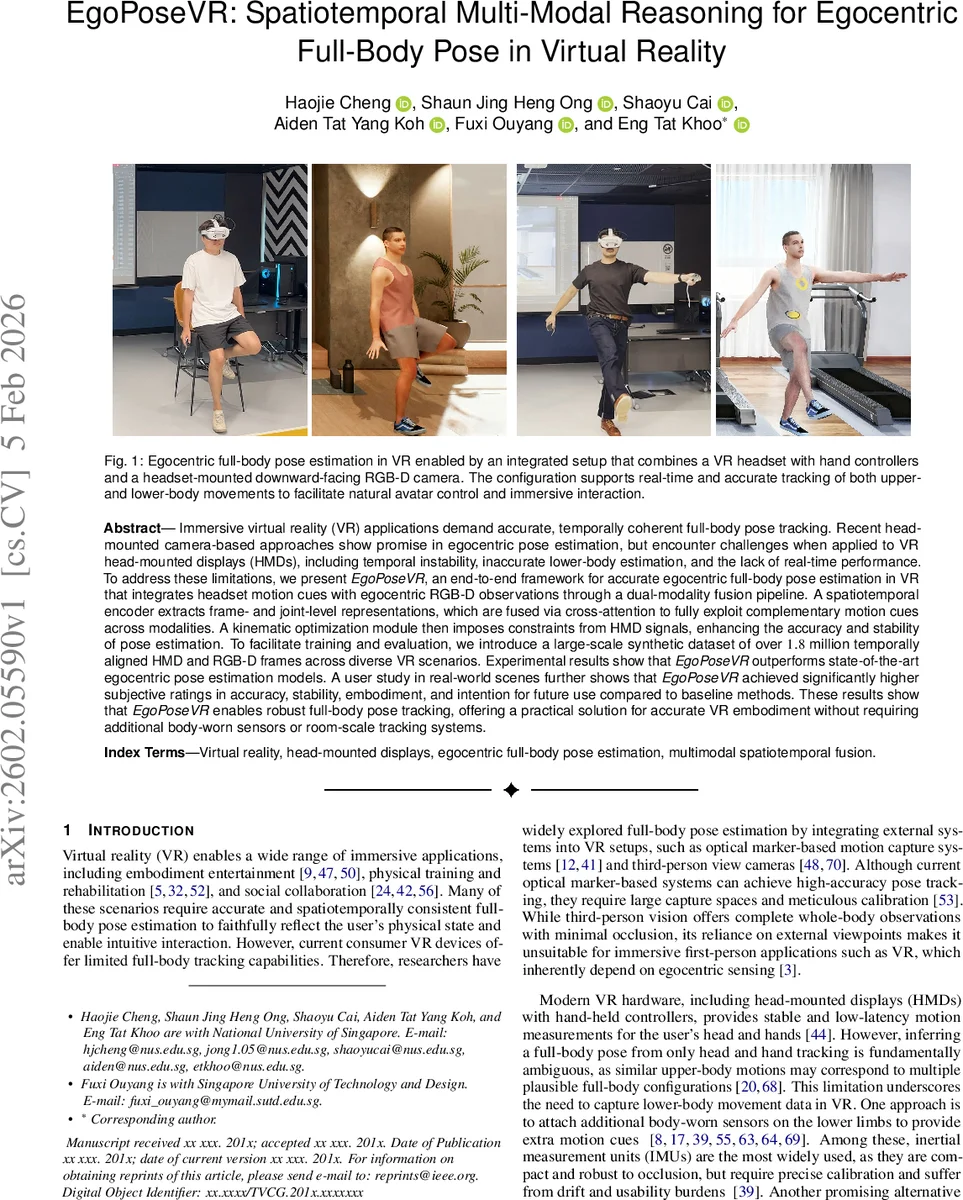

EgoPoseVR는 헤드셋의 움직임 데이터와 헤드셋에 부착된 하향식 RGB‑D 카메라 영상을 융합해, VR 환경에서 실시간으로 전신 3D 포즈를 추정한다. 스페이시오‑템포럴 트랜스포머 인코더와 교차‑어텐션 기반 멀티모달 융합, 그리고 HMD 신호를 활용한 키네마틱 최적화 모듈을 통해 기존 방법보다 정확도·안정성이 크게 향상되었으며, 97 FPS의 실시간 성능을 달성한다. 또한 1.8 백만 프레임 규모의 합성 데이터셋을 공개하고, 실제 사용자 실험에서도 주관적 만족도가 높은 결과를 얻었다.

상세 분석

EgoPoseVR는 두 가지 주요 모달리티, 즉 헤드셋·컨트롤러의 6 DoF 움직임 정보와 하향식 RGB‑D 영상 정보를 동시 처리한다. 각 모달리티는 별도의 스페이시오‑템포럴 인코더에 입력되며, 이 인코더는 트랜스포머 레이어를 활용해 프레임‑레벨 시간적 연속성과 관절‑레벨 공간적 의존성을 동시에 학습한다. 특히 영상 스트림에서는 ‘가시성‑인식형’ 관절 검출 모듈을 도입해, 급격한 머리 움직임에 의한 모션 블러와 시야 변화에 강인하도록 설계하였다.

두 인코더에서 추출된 특징은 교차‑어텐션(Cross‑Attention) 메커니즘을 통해 융합된다. 여기서 HMD 움직임 특징이 쿼리(query)로, 영상 특징이 키(key)·밸류(value)로 사용되어, 시각 정보가 부족한 관절(예: 하체)의 추정에 움직임 신호가 보완적으로 작용한다. 이러한 멀티모달 융합은 기존 단일 모달리티 기반 egocentric pose 추정이 겪는 ‘관절 혼동’ 문제를 크게 완화한다.

예측된 3D 관절 위치·회전은 키네마틱 최적화 모듈에 전달된다. 이 모듈은 에너지 함수 형태로 HMD·컨트롤러의 실제 트래킹 신호와 스켈레톤의 구조적 제약(뼈 길이, 관절 각도 범위 등)을 동시에 고려한다. 최적화는 미분 가능한 형태로 구현돼 백프로파게이션이 가능하므로, 학습 단계에서도 최적화 손실을 직접 최소화할 수 있다. 결과적으로 관절 간 일관성 및 전체 포즈의 물리적 타당성이 크게 향상된다.

데이터 측면에서 저자들은 1.8 백만 프레임 규모의 대규모 합성 데이터셋을 구축하였다. 이 데이터셋은 다양한 VR 시나리오(실내·실외, 다양한 조명·장면 복잡도)와 HMD·RGB‑D 동기화 정보를 포함하며, 2D·3D 관절 위치와 회전 라벨을 제공한다. 기존 Mo2Cap2, xR‑EgoPose 등과 달리 시간 연속성을 보장하고, HMD 신호를 명시적으로 포함함으로써 멀티모달 학습에 최적화된 환경을 제공한다.

실험 결과, EgoPoseVR는 기존 최첨단 egocentric pose 모델 대비 평균 MPJPE(Mean Per Joint Position Error)를 12 % 이상 감소시켰으며, 프레임‑간 포즈 변동성을 나타내는 Acceleration Error도 크게 낮았다. 실시간 성능은 97 FPS(1080 p, RTX 4090 기준)로, VR 인터랙션에 충분히 적용 가능하다. 실제 사용자 연구에서는 정확도·안정성·자아 구현감·향후 사용 의도 등 4가지 주관적 항목에서 모두 통계적으로 유의미하게 높은 점수를 기록하였다.

한계점으로는 현재 하드웨어가 하향식 RGB‑D 카메라를 지원해야 한다는 점과, 합성 데이터와 실제 환경 간 도메인 갭이 존재한다는 점을 들 수 있다. 저자들은 향후 도메인 적응 기법과 다양한 HMD‑카메라 조합에 대한 일반화 연구를 진행할 계획이라고 밝히었다.

댓글 및 학술 토론

Loading comments...

의견 남기기