파라메트릭 3D 객체 인식을 위한 로봇용 트랜스포머

초록

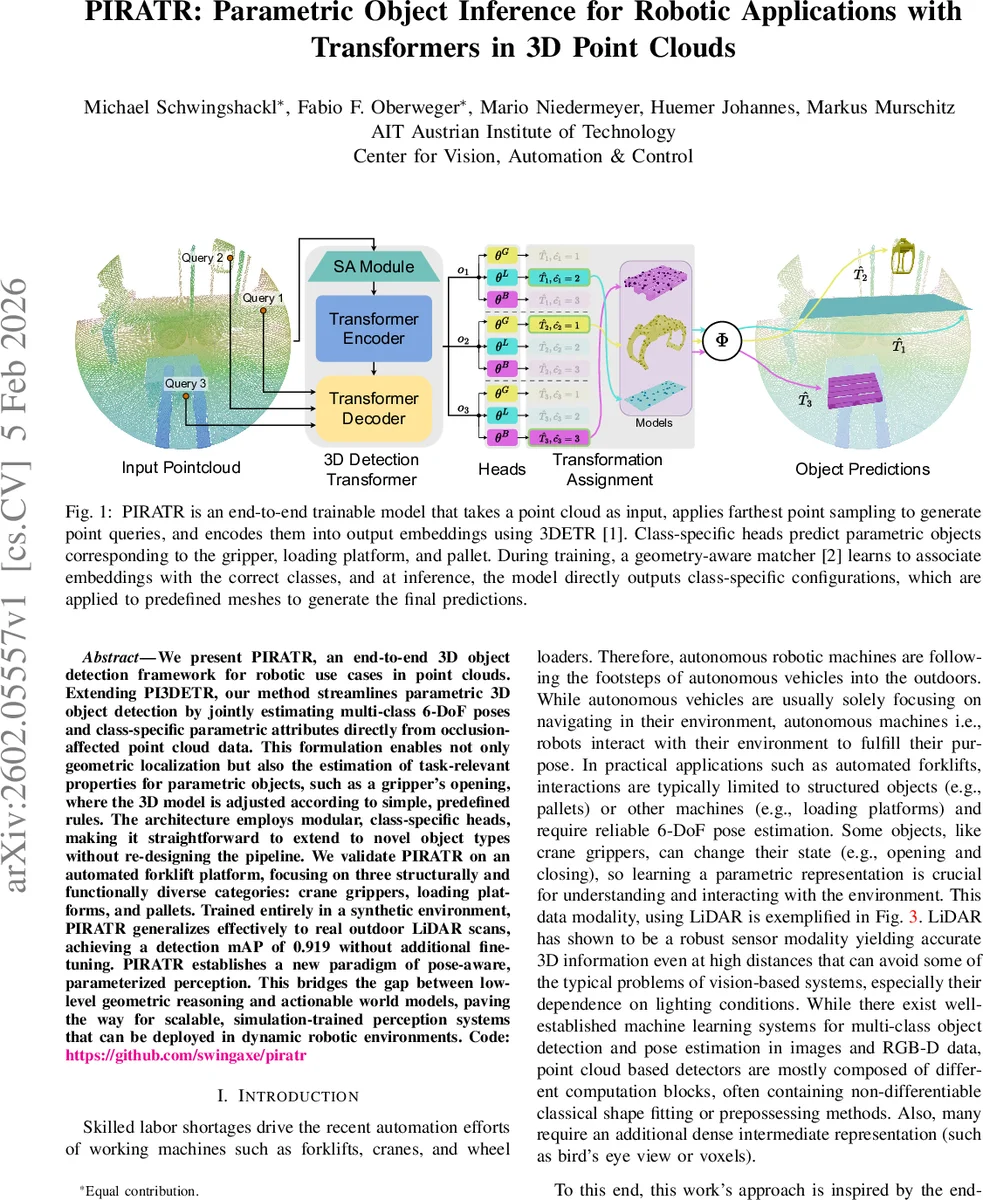

PIRATR는 LiDAR 포인트클라우드에서 로봇이 직접 사용할 수 있는 6자유도 자세와 객체별 파라메터(예: 그리퍼 개폐각)를 동시에 추정하는 엔드‑투‑엔드 모델이다. PI3DETR를 기반으로 클래스별 FFN 헤드를 추가하고, 대칭을 고려한 geometry‑aware 매처를 도입했다. 5천 개의 합성 데이터만으로 학습했으며, 실제 야외 LiDAR 스캔에 대해 0.919의 mAP를 달성한다.

상세 분석

PIRATR는 기존 3D DETR 계열 모델인 PI3DETR의 구조를 그대로 차용하면서, 로봇 조작에 필수적인 파라메트릭 정보를 출력하도록 확장하였다. 입력 포인트클라우드는 SAModule을 통해 farthest‑point‑sampling(FPS)으로 K개의 쿼리 포인트를 추출하고, 각 쿼리는 sinusoidal positional encoding을 거쳐 Transformer 인코더‑디코더에 전달된다. Transformer는 쿼리마다 고차원 임베딩을 생성하고, 이 임베딩을 클래스별 Feed‑Forward Network(FFN) 헤드에 입력한다.

헤드 설계는 세 가지 객체(그리퍼, 로딩 플랫폼, 팔레트)에 대해 각각 별도의 파라메터를 예측하도록 구성된다. 그리퍼 헤드는 위치 p, 회전 q, 개폐각 α를 한 번에 출력하며, 나머지 두 클래스는 위치와 회전만을 반환한다. 위치는 쿼리 포인트에 대한 offset 형태로 예측되어, 실제 좌표와 쿼리 간의 관계를 학습한다.

학습 단계에서는 geometry‑aware 매처가 핵심 역할을 한다. 객체마다 대칭성이 존재하는데(예: 180° 회전 대칭), 매처는 예측된 쿼터니언과 정답 쿼터니언 사이의 L1 손실을 최소화하도록 대칭 집합을 고려한다. 이를 통해 대칭에 민감한 회전 추정 오류를 크게 감소시킨다.

데이터 측면에서는 Blender 기반 파이프라인으로 5 000개의 합성 씬을 생성하고, Livox‑Mid70 스캔 패턴을 그대로 재현한다. Lissajous‑형 레이저 궤적을 시뮬레이션하고, 각 레이와의 교차점을 레이캐스트하여 실제 LiDAR 포인트 분포와 노이즈 특성을 모사한다. 또한, 객체 배치, 트럭·포크리프트 위치, 나무·벽 등 주변 환경을 도메인 랜덤화하여 시뮬‑투‑리얼 격차를 최소화한다.

실험 결과는 두 가지 축에서 평가된다. 첫째, 합성 검증 세트에서 0.95 이상의 mAP를 기록했으며, 특히 그리퍼 개폐각 추정에서 평균 절대 오차가 3° 이하로 매우 정확했다. 둘째, 실제 야외 LiDAR 데이터에 그대로 적용했을 때 0.919의 mAP를 달성, 별도 파인‑튜닝 없이도 높은 일반화 능력을 입증했다. 추가적인 ablation study에서는 클래스별 헤드 분리, 대칭 매처, 그리고 합성 데이터의 도메인 랜덤화가 각각 성능 향상에 크게 기여함을 확인했다.

한계점으로는 현재 3가지 객체에 한정된 클래스 스케일링, 그리고 파라메트릭 속성이 단일 스칼라(그리퍼 개폐각) 수준에 머물러 있다는 점을 들 수 있다. 향후 연구에서는 복합적인 기구학 파라메터(예: 다관절 로봇 팔)와 더 다양한 대칭 형태를 지원하도록 헤드와 매처를 확장할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기