공유 지식이 모델 병합을 해치는 이유와 스펙트럼 보정 방법

초록

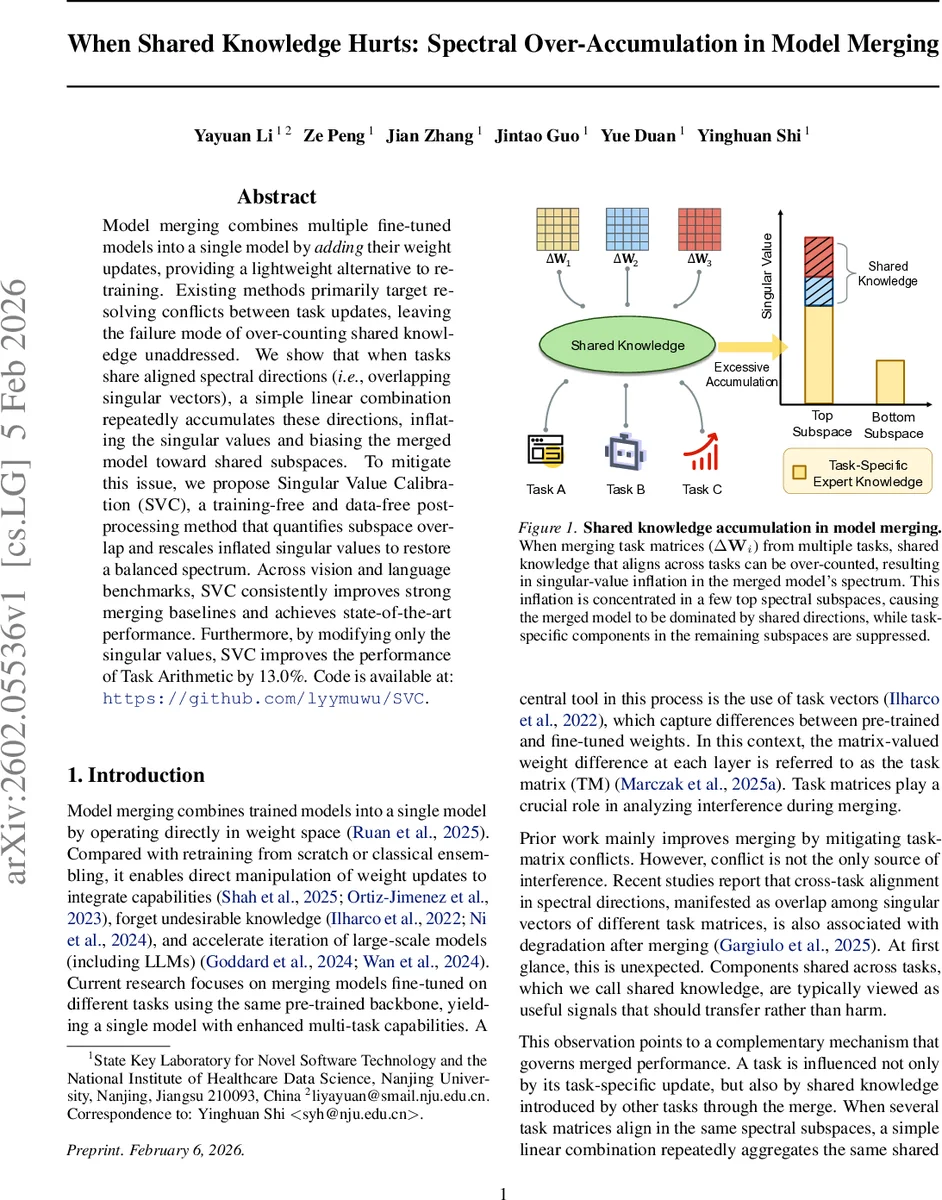

모델 병합 시 여러 과제가 동일한 스펙트럼 방향을 공유하면, 해당 방향이 반복적으로 누적돼 특잇값이 과도하게 커지고 모델이 몇몇 지배적 서브스페이스에 편향된다. 저자는 이를 “스펙트럼 오버‑누적”이라 정의하고, 특잇값을 정규화해 스펙트럼 균형을 회복하는 훈련·데이터‑프리 post‑processing 기법인 Singular Value Calibration(SVC)을 제안한다. SVC는 병합된 업데이트를 특잇값 기준으로 재조정함으로써 Vision·Language 벤치마크에서 기존 병합 방법들을 일관되게 개선하고, Task Arithmetic 성능을 13 % 끌어올린다.

상세 분석

본 논문은 모델 병합 과정에서 발생하는 두 번째 주요 실패 모드, 즉 “공유 지식의 과다 집계”를 체계적으로 규명한다. 기존 연구는 주로 서로 충돌하는 파라미터를 완화하는 데 초점을 맞추었으나, 서로 다른 과제가 동일한 특잇값 방향(공통 singular vector)을 공유할 경우, 단순 가중치 합산이 해당 방향을 반복적으로 누적시켜 특잇값이 비정상적으로 팽창한다는 점을 발견한다. 이 현상은 병합 모델이 상위 몇 개의 스펙트럼 서브스페이스에 과도하게 의존하게 만들고, 나머지 서브스페이스에 존재하는 과제‑특이적 정보를 억제한다.

이론적 분석에서는 병합된 task matrix ΔW_merge 를 SVD(ΔW_merge = UΣVᵀ) 로 분해하고, 각 과제 행렬 ΔW_i 를 동일한 좌측 특이벡터 u_r 에 투영해 서브스페이스별 응답 a_{r i} 를 정의한다. 이후 병합 응답 a_{r merge}=∑i a{r i} 와 각 과제 응답 a_{r i} 사이의 투영 계수 s_{r i}=⟨a_{r merge},a_{r i}⟩/‖a_{r i}‖² 를 도입해, s_{r i}>1이면 해당 서브스페이스에서 과제들이 동일 방향을 과다 집계하고 있음을 정량화한다. Lemma 3.2와 Theorem 3.3을 통해 s_{r i}>1이면 특잇값 σ_r 가 최적(투영‑기반) 값보다 크게 부풀어오른다는 것을 증명한다. 즉, 양의 교차‑내적 ⟨a_{r j},a_{r i}⟩ 가 누적될수록 σ_r 은 불필요하게 커진다.

이러한 현상을 교정하기 위해 제안된 Singular Value Calibration(SVC)은 다음 절차를 따른다. 1) 병합된 ΔW_merge 를 SVD 로 분해해 특이벡터 집합 U 를 공유 좌표계로 사용한다. 2) 각 과제 ΔW_i 를 동일한 좌표계에 투영해 a_{r i} 를 계산하고, s_{r i} 를 구한다. 3) s_{r i} 를 기반으로 서브스페이스별 보정 강도 γ_{r i}=1/s_{r i} (s_{r i}>0) 를 정의한다. 4) 동일 서브스페이스 내 모든 과제에 대해 γ_{r i} 를 평균해 γ_r^* 를 얻고, 원래 특잇값 σ_r 에 γ_r^* 를 곱해 보정된 특잇값 σ_r^* 를 만든다. 5) 보정된 Σ^* 와 원래 U, V 를 재조합해 새로운 병합 가중치를 생성한다. 이 과정은 추가 학습이나 데이터가 전혀 필요 없으며, 특이벡터 방향은 그대로 유지하면서 스펙트럼 균형만을 회복한다.

실험에서는 CLIP‑ViT, ResNet, LLaMA 등 다양한 비전·언어 모델에 대해 기존 Task Arithmetic, Simple Averaging, Weighted Averaging 등 여러 병합 기법에 SVC를 적용하였다. 모든 설정에서 상위 특잇값의 과다 팽창이 완화되고, 전체 성능이 평균 2~5 %p 상승했으며, 특히 Task Arithmetic에 SVC를 적용했을 때 13 %p의 큰 개선을 기록했다. 또한, 선호 최적화(preference optimization)와 같은 특정 과제에 대해 서브스페이스별 보정이 어떻게 효과를 발휘하는지 정성·정량 분석을 제공한다.

결론적으로, 논문은 “공유 지식이 과도하게 누적될 때 발생하는 스펙트럼 오버‑누적”이라는 새로운 실패 모드를 제시하고, 이를 정량화·보정하는 SVC 방법을 통해 모델 병합의 효율성을 크게 향상시켰다. SVC는 훈련·데이터‑프리라는 실용적 장점과 이론적 근거를 동시에 갖추어, 앞으로 대규모 멀티태스크 LLM 병합에도 적용 가능할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기