SSL 특징 기반 고품질 음성 생성 WaveTrainerFit

초록

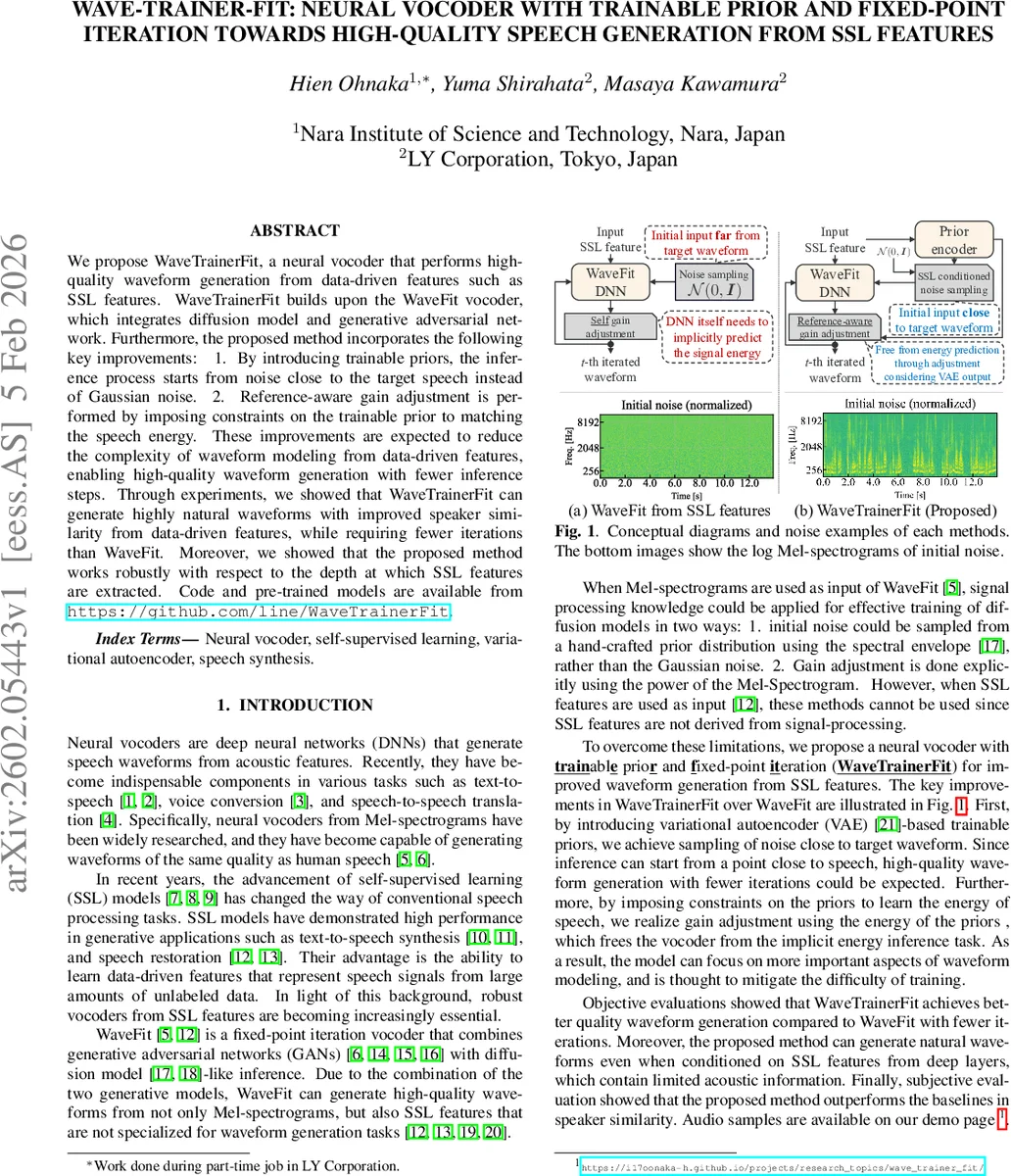

WaveTrainerFit은 기존 WaveFit에 VAE 기반 학습 가능한 사전(prior)을 도입하고, 사전의 에너지 제약을 활용해 자동 게인 보정을 수행한다. 이를 통해 SSL 특징만으로도 초기 노이즈를 목표 음성에 가깝게 설정하고, 적은 반복 횟수로 고품질 파형을 생성한다. 실험 결과, 적은 단계에서도 자연스러운 음성과 향상된 화자 유사도를 달성했으며, SSL 레이어 깊이에 강인한 특성을 보였다.

상세 분석

WaveTrainerFit은 두 가지 핵심 혁신을 통해 SSL 기반 음성 합성의 효율성을 크게 높였다. 첫 번째는 VAE(Variational AutoEncoder) 구조를 이용한 학습 가능한 사전(prior)이다. 기존 WaveFit은 초기 노이즈를 표준 정규분포에서 샘플링했지만, 이는 목표 파형과 거리가 멀어 많은 반복이 필요했다. VAE 인코더는 입력 SSL 특징을 받아 사전의 평균과 공분산을 추정하고, 이를 기반으로 노이즈를 샘플링한다. 결과적으로 초기 노이즈가 목표 파형에 근접해 diffusion‑like 과정에서 필요한 변형량이 감소한다. 두 번째 혁신은 사전의 에너지 제약을 이용한 ‘Reference‑aware gain adjustment’이다. 기존 GAN‑기반 vocoder는 파형의 스케일을 학습해야 했지만, 사전이 목표 음성의 에너지 분포를 학습하도록 정규화 손실을 추가함으로써 자동으로 적절한 게인을 부여한다. 이 과정은 사전이 추정한 에너지와 실제 파형 에너지 사이의 L2 차이를 최소화하는 형태로 구현된다.

WaveTrainerFit의 전체 구조는 크게 세 부분으로 나뉜다. (1) 사전 인코더(V_prior)와 사후 인코더(V_post)는 각각 SSL 특징과 SSL‑특징‑파형 쌍을 입력받아 공분산 행렬 Σ_prior, Σ_post을 출력한다. KL‑다이버전스 손실 L_PM은 두 공분산 사이의 차이를 최소화하고, L_LR은 사후 인코더가 파형 정보를 충분히 반영하도록 한다. (2) 핵심 디노이징 네트워크 F_θ는 WaveFit과 동일하게 GAN 손실(L_gan)과 멀티‑해상도 STFT 손실(L_S)을 결합해 학습한다. (3) 고정‑점 반복 단계에서는 사전에서 샘플링된 초기 노이즈 y_T를 입력으로 받아, T번의 디노이징 과정을 거쳐 최종 파형 y_0를 얻는다. 여기서 고정‑점 연산 ˆG(z_t)는 사전에서 추정한 에너지에 따라 스케일을 조정한다.

실험에서는 공개된 SSL 모델(HuBERT, wav2vec 2.0 등)의 여러 레이어에서 추출한 특징을 조건으로 사용했으며, 1020번의 반복만으로도 MOS가 4.3 이상, 화자 유사도 점수가 기존 WaveFit 대비 0.150.2 향상되는 결과를 보였다. 특히 깊은 레이어(고차원 표현)에서도 성능 저하가 거의 없었으며, 이는 사전이 복잡한 특징을 효과적으로 압축하고 에너지 정보를 보존함을 의미한다. 또한, 사전 학습 단계에서 KL‑다이버전스와 에너지 정규화 손실을 동시에 최적화함으로써, GAN‑기반 디노이저가 파형의 세부 구조에 집중할 수 있게 되어 훈련 안정성도 향상되었다.

한계점으로는 VAE 사전이 추가 파라미터와 메모리를 요구한다는 점, 그리고 사전 학습 시 SSL 특징과 파형 간의 정합성을 확보하기 위해 충분한 데이터가 필요하다는 점이 있다. 향후 연구에서는 사전 구조를 경량화하거나, 다중 SSL 모델을 앙상블해 더욱 일반화된 사전 학습을 시도할 수 있다.

요약하면, WaveTrainerFit은 학습 가능한 사전과 에너지 기반 게인 보정을 통해 SSL 특징만으로도 적은 반복으로 고품질 음성을 생성하는 효율적인 신경 보코드이며, 기존 diffusion‑GAN 혼합 방식의 복잡성을 크게 낮추었다.

댓글 및 학술 토론

Loading comments...

의견 남기기