언어모델의 문자 수준 정보 습득 메커니즘 분석

초록

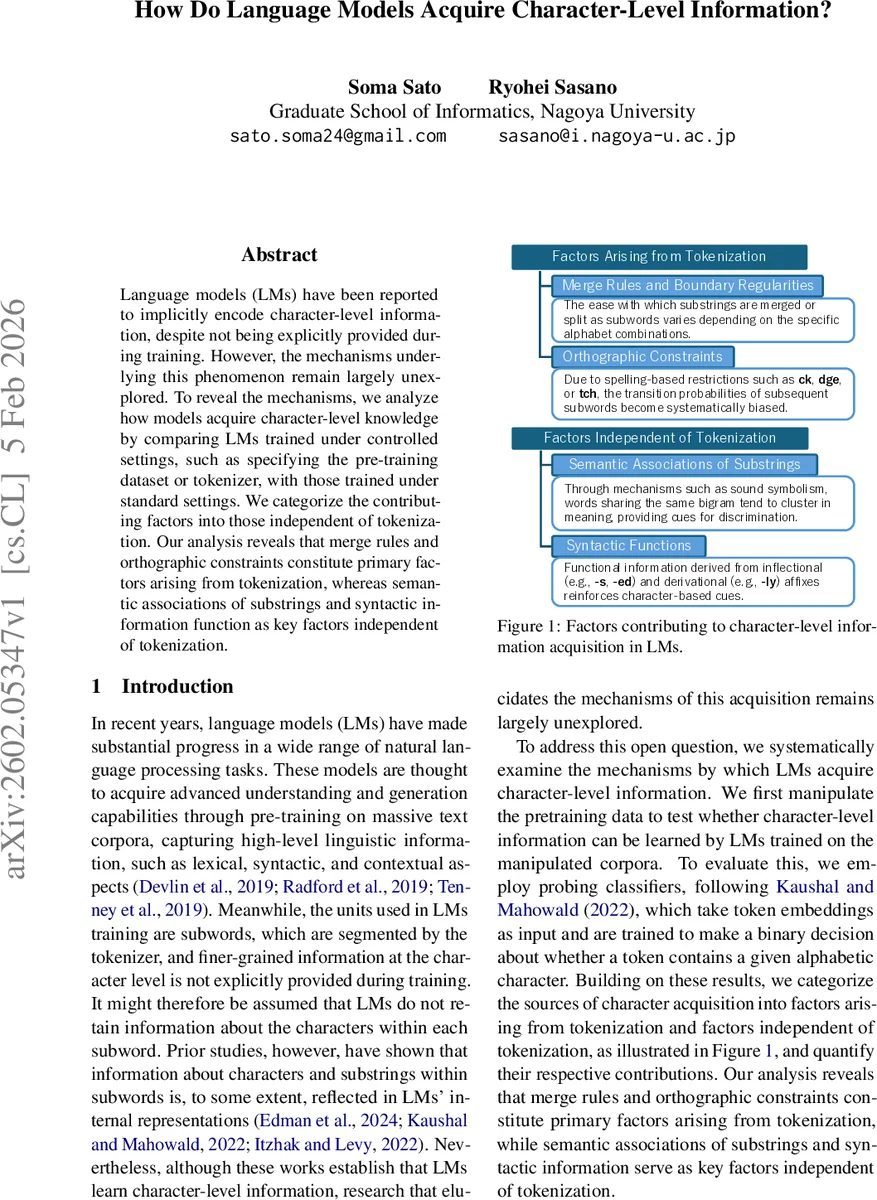

본 논문은 사전학습 단계에서 문자 수준 정보를 명시적으로 제공받지 않은 언어모델이 어떻게 해당 정보를 내재하게 되는지를 체계적으로 조사한다. 토크나이저 종류·병합 규칙·정규화 제약 등 토크나이징에서 파생되는 요인과, 토크나이징에 독립적인 의미 연관성·구문 정보 등 두 축으로 요인을 구분하고, 각각의 기여도를 정량화한다. 실험은 BPE·WordPiece·Unigram 토크나이저와 제어된 데이터 변형(WordSub, CharPert)을 이용해 작은 규모의 BERT‑Tiny와 nanoGPT를 사전학습한 뒤, 토큰 임베딩을 활용한 문자 존재 여부 탐지 프로빙으로 평가한다. 결과는 토크나이징에 의해 형성되는 병합 규칙과 정서적 제약이 주요 원천이며, 의미‑구문적 단서가 토크나이징 독립적인 보조 요인임을 보여준다.

상세 분석

본 연구는 언어모델이 문자 수준 정보를 어떻게 습득하는지를 두 가지 큰 범주, 즉 “토크나이징에 의한 요인”과 “토크나이징에 독립적인 요인”으로 나누어 정밀히 분석한다. 토크나이징에 의한 요인으로는 BPE와 WordPiece에서 발생하는 병합 규칙(merge rules)과 토큰 경계(orthographic constraints)가 핵심이다. 병합 규칙은 훈련 코퍼스에서 가장 빈번한 문자 쌍을 반복적으로 결합함으로써 형성되며, 이 과정에서 특정 문자 조합이 하나의 토큰으로 고정된다. 따라서 모델은 해당 토큰을 학습하면서 자연스럽게 그 내부 문자들의 존재 여부를 암시적으로 파악한다. 또한, 토큰 경계는 공백 문자와 같은 구분 기호에 의해 강제되는데, 이는 토큰 길이와 문자 분포에 일정한 패턴을 부여한다. 실험 결과, BPE 기반 nanoGPT는 토큰 길이가 짧을수록(특히 3~4자) 프로빙 정확도가 현저히 높았으며, 이는 짧은 토큰이 더 빈번히 등장하고 의미적 정보를 풍부히 담고 있기 때문이다.

토크나이징에 독립적인 요인으로는 두 가지가 강조된다. 첫째는 서브스트링의 의미 연관성(semantic associations)이다. 논문은 WordSub 변환을 통해 토큰 자체를 무작위 문자열로 교체했을 때, 모델의 문자 탐지 성능이 약 12%p 감소함을 보여준다. 이는 원래 토큰이 갖는 의미적 힌트가 문자 수준 정보를 보강한다는 증거다. 둘째는 구문적 단서(syntactic functions)이다. 접미사·접두사와 같은 형태소적 패턴은 특정 문자 집합을 일관되게 포함하므로, 모델은 이러한 구문적 규칙을 통해 문자 존재 여부를 추론한다. 특히, -s, -ed, -ly와 같은 파생 접미사는 문자‑기반 단서와 결합해 토큰 임베딩에 추가적인 신호를 제공한다.

데이터 변형 실험에서는 CharPert(문자 무작위 교체)와 WordSub(토큰 무작위 교체)를 각각 적용하였다. CharPert 데이터에서도 BPE 모델은 58.2%의 정확도를 유지했으며, 이는 토크나이징 자체가 문자 패턴을 어느 정도 보존한다는 것을 의미한다. 반면, Word 수준 토크나이징(Whitespace segmentation)에서는 정확도가 50% 수준으로 떨어져, 토크나이저가 없을 경우 문자 수준 정보가 거의 사라짐을 확인한다. 이러한 결과는 토크나이저가 문자 정보를 구조화하고, 모델이 이를 활용하도록 만드는 핵심 메커니즘임을 뒷받침한다.

또한, 토큰 길이와 문자 존재 여부 사이의 상관관계를 통제하기 위해 ‘matched’와 ‘unmatched’ 실험을 설계하였다. 길이 분포를 맞춘 ‘matched’ 설정에서는 정확도가 전반적으로 낮아졌지만, 여전히 60% 이상을 유지했으며, 이는 토큰 길이 자체가 아닌 토큰 내부의 문자·의미·구문적 특성이 모델에 내재된다는 점을 시사한다. 마지막으로, 사전학습된 대형 모델(GPT‑2, GPT‑J, BERT‑base)과 비교했을 때, 소규모 nanoGPT가 비슷한 수준의 문자 탐지 성능을 보였으며, 이는 모델 규모보다 토크나이징 및 데이터 특성이 더 결정적인 역할을 함을 암시한다.

요약하면, (1) 토크나이징 과정에서 형성되는 병합 규칙과 경계 제약이 문자 수준 정보를 가장 크게 기여하고, (2) 의미적 연관성과 구문적 패턴이 토크나이징에 독립적으로 보완적인 역할을 수행한다. 이러한 발견은 향후 토크나이저 설계 시 문자‑레벨 정보를 의도적으로 강화하거나, 특정 언어·도메인에 맞는 토크나이징 전략을 선택함으로써 모델의 문자 이해 능력을 조절할 수 있는 실용적 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기