멀티모달 임베딩을 위한 시각 토큰 압축과 단계적 학습 혁신

초록

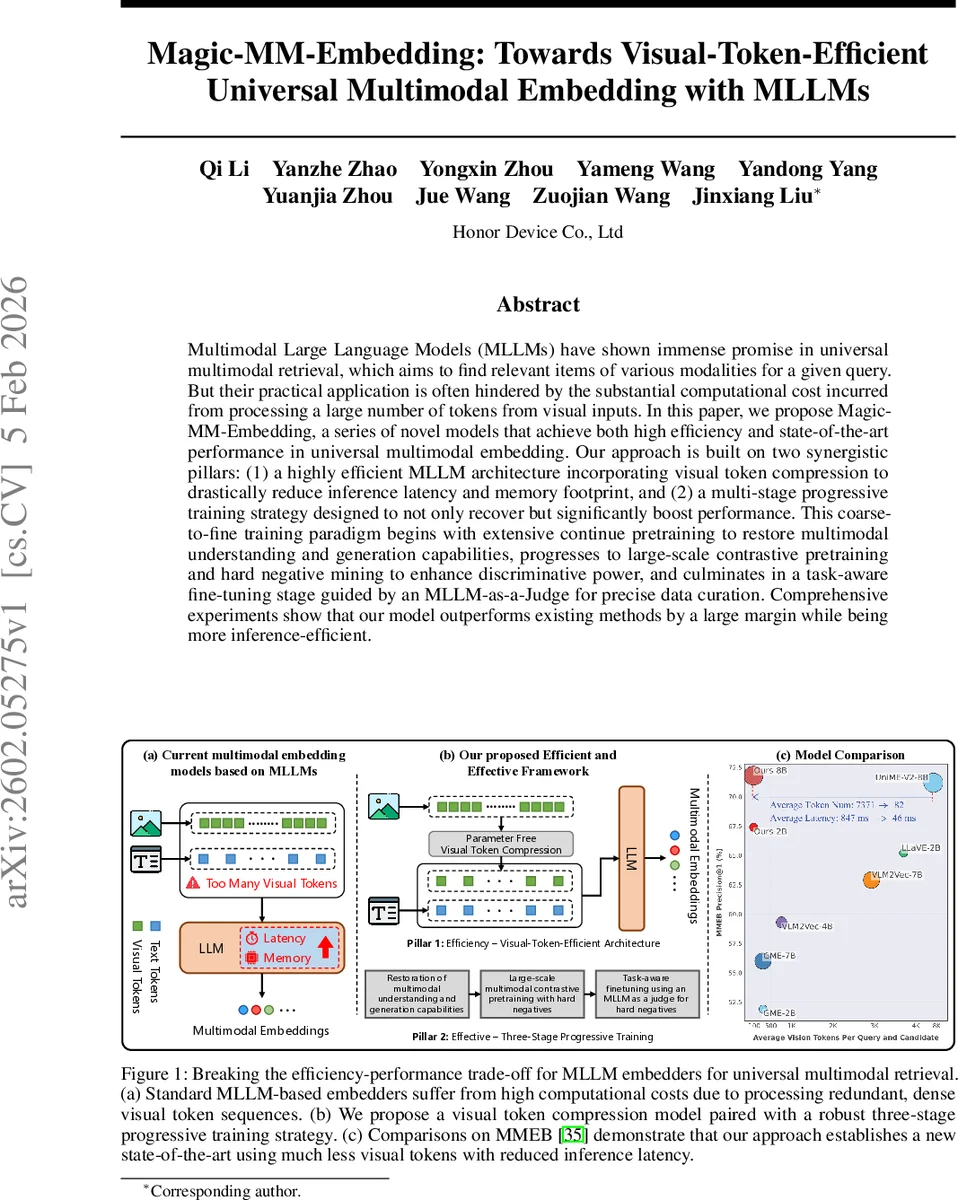

Magic‑MM‑Embedding은 시각 토큰을 75 % 압축하는 파라미터‑프리 보간 모듈과, 세 단계(기초 복원 → 대규모 대조 학습 → 태스크‑특화 파인튜닝)로 구성된 진행형 학습 파이프라인을 결합한다. 압축에도 불구하고 정보 손실을 최소화하고, MLLM‑as‑Judge를 활용한 하드 네거티브 큐레이션으로 성능을 크게 끌어올린다. 실험 결과, 기존 MLLM 기반 임베더 대비 4배 적은 시각 토큰으로도 다양한 이미지·문서 검색 벤치마크에서 최고 수준의 정확도를 달성한다.

상세 분석

Magic‑MM‑Embedding은 현재 MLLM 기반 멀티모달 임베딩이 직면한 가장 큰 병목인 “시각 토큰 과다” 문제를 근본적으로 해결한다. 기존 LLaVA‑1.5와 같은 모델은 336×336 이미지당 576개의 패치 토큰을 그대로 LLM에 투입해, 어텐션 연산의 2차 복잡도와 메모리 사용량을 급격히 증가시킨다. 저자는 이를 “Parameter‑free Visual Token Compression”이라는 단계에서 bilinear interpolation을 이용해 공간 해상도를 1/2 혹은 1/4로 축소한다. 이 과정은 학습 가능한 파라미터를 전혀 도입하지 않으며, 단순히 H×W → H′×W′(H′=H/s, W′=W/s) 로 다운샘플링함으로써 토큰 수를 s² 배 감소시킨다. 예를 들어 s=2이면 토큰 수가 75 % 감소하고, s=4이면 94 %까지 감소한다. 중요한 점은, 보간이 이미지의 전역 구조와 주요 시각 정보를 보존한다는 점이다. 따라서 압축 후에도 LLM이 충분히 의미 있는 시각 정보를 받아들일 수 있다.

하지만 압축된 토큰을 바로 대조 학습에 투입하면, 사전 학습된 LLM이 기대하던 토큰 분포와 크게 달라 성능이 급격히 저하될 위험이 있다. 이를 방지하기 위해 저자는 3단계 “Coarse‑to‑Fine” 학습 파이프라인을 설계했다. 첫 번째 단계인 “Multimodal Foundational Capability Restoration”에서는 일반 멀티모달 인스트럭션 데이터(예: GPT‑4V‑style 이미지‑텍스트 대화)를 사용해 NTP(Next Token Prediction) 손실을 최소화한다. 이 과정은 압축된 시각 토큰이 LLM의 언어 모델링 흐름에 자연스럽게 녹아들게 하여, 기존의 이미지‑텍스트 이해·생성 능력을 회복한다.

두 번째 단계는 “Multimodal Contrastive Pretraining”이다. 여기서는 16 M 규모의 멀티모달 샘플을 활용해 InfoNCE 손실로 임베딩을 학습한다. 초기에는 in‑batch 네거티브만 사용해 기본적인 구분 능력을 길러놓고, 이후 “Global Hard Negative Mining”을 도입한다. 구체적으로 각 쿼리에 대해 전체 후보 풀에서 50~100위 사이에 위치한 샘플을 하드 네거티브로 선정한다. 이는 Top‑10에 존재할 수 있는 “false‑negative”를 회피하면서도, 미묘한 시각·텍스트 차이를 학습하도록 만든다.

세 번째 단계는 “Task‑aware Fine‑tuning”이며, 여기서 가장 혁신적인 요소가 “MLLM‑as‑Judge”이다. 이전 단계에서 학습된 임베더를 이용해 훈련 쿼리마다 후보를 검색하고, MLLM에게 “이 후보가 정답과 얼마나 유사한가?”를 물어 하드 네거티브를 자동으로 라벨링한다. 이렇게 자동 생성된 고품질 하드 네거티브를 사용해 최종 대조 학습을 수행하면, 다양한 다운스트림 태스크(자연 이미지 검색, 문서 이미지 검색 등)에서 강인한 일반화 성능을 확보한다.

실험에서는 MMEB, Flickr30K, DocVQA 등 7개 이상의 벤치마크에 대해 기존 최첨단 모델 대비 3~7 % AP·Recall 향상을 보였으며, 시각 토큰을 1/4로 줄였음에도 불구하고 latency는 40 % 이상 감소했다. Ablation 연구에서는 압축 없이 학습한 모델보다 압축+3단계 학습 모델이 일관적으로 우수함을 확인했다. 또한 파라미터‑프리 보간 방식이 학습 가능한 압축 모듈보다 안정적이며, 하드 네거티브 큐레이션 없이 진행하면 성능 격차가 크게 벌어지는 것을 보여준다. 전체적으로 이 논문은 “효율성 vs. 성능” 트레이드오프를 깨뜨리고, 실시간 멀티모달 검색 서비스에 바로 적용 가능한 설계와 학습 전략을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기