모바일 매니퓰레이션 검증을 위한 대규모 시뮬레이션 벤치마크

초록

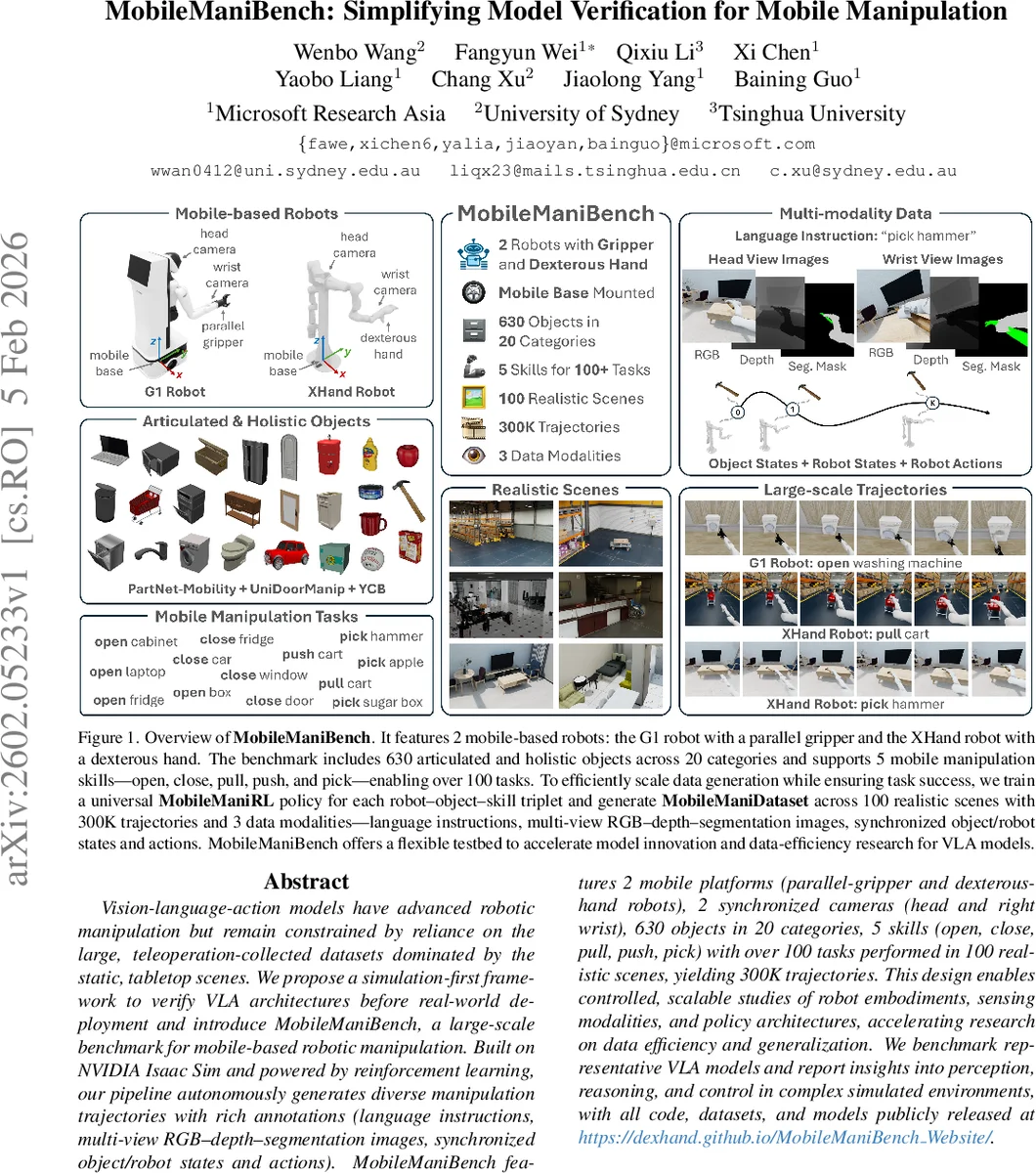

MobileManiBench은 NVIDIA Isaac Sim 기반의 시뮬레이션 파이프라인을 활용해, 모바일 베이스와 두 종류의 손(평행 그리퍼, 12 DOF 손)을 가진 로봇이 630개의 객체와 5가지 조작 스킬을 수행하도록 30만 개 이상의 멀티모달 트래젝터리를 자동 생성한다. 이를 통해 VLA(비전‑언어‑액션) 모델의 데이터 효율성과 일반화 능력을 대규모로 평가·비교할 수 있다.

상세 분석

본 논문은 현재 VLA 모델이 정적인 테이블탑 환경에 국한된 대규모 텔레옵 데이터에 의존한다는 한계를 지적하고, 모바일 매니퓰레이션이라는 보다 복합적인 문제 설정을 시뮬레이션‑퍼스트 방식으로 해결하고자 한다. 핵심 기여는 두 가지 로봇 플랫폼(G1 평행 그리퍼 로봇, XHand 12 DOF 손 로봇)과 두 개의 동기화 카메라(헤드와 손목)로 구성된 하드웨어 스택을 가상화한 뒤, 강화학습 기반의 범용 정책(MobileManiRL)을 각 로봇‑객체‑스킬 조합에 대해 학습시켜 자동으로 성공적인 트래젝터리를 생성한다는 점이다.

-

데이터 규모와 다양성: 20개의 카테고리(630개 객체), 5가지 스킬(열기·닫기·당기기·밀기·집기), 100개의 현실감 있는 씬을 조합해 100 + 작업을 정의하고, 각 작업당 평균 3 000개의 성공 트래젝터리를 수집해 총 300 K 트래젝터리를 확보했다. 이는 기존 시뮬레이션 벤치마크(예: RLBench, ManiSkill2)보다 객체·스킬·시나리오 조합이 훨씬 풍부하며, 특히 모바일 기반 이동·조작을 동시에 다루는 점이 차별화된다.

-

멀티모달 입력 설계: 각 프레임마다 텍스트 명령, RGB‑Depth‑Segmentation 이미지(헤드·손목 2‑뷰), 로봇 관절·위치·속도 등 78 + 135 차원의 proprioceptive 데이터, 객체‑그리퍼 거리, 이전 액션 등을 포함한다. 이러한 풍부한 센서 융합은 VLA 모델이 시각·언어·동작을 동시에 학습하도록 설계된 최신 아키텍처와 자연스럽게 매핑될 수 있다.

-

범용 RL 정책 구조: MobileManiRL은 4‑layer MLP(1024‑1024‑512‑512)와 단일 FC 액션 헤드로 구성되며, 입력으로 시간 임베딩, 객체 상태, 로봇 상태, 거리, 이전 액션을 사용한다. 보상 함수는 거리 보상, 접근 보상, 잡기·이동·성공 보상을 단계적으로 결합해, 단일 정책이 다양한 스킬을 학습하도록 유도한다. 특히 “그립 플래그”를 도입해 잡기와 이동을 명확히 구분함으로써, 복합 스킬(예: 열기·닫기)에서도 안정적인 학습을 가능하게 한다.

-

벤치마크 평가: 논문은 기존 VLA 모델(예: RT‑1, PerAct, VIMA 등)과 자체 제안 모델(MobileManiVLA)을 동일 데이터셋에 적용해 퍼포먼스를 비교한다. 결과는 (1) 손목 카메라와 깊이 정보가 추가될 때 성공률이 평균 12 % 상승, (2) 모바일 베이스 이동을 포함한 태스크에서는 전통적인 고정 베이스 모델이 30 % 이상 성능 저하, (3) dexterous hand 로봇이 복잡한 조작(예: 레버 도어 열기)에서 평행 그리퍼 대비 18 % 높은 성공률을 보였음을 보여준다.

-

연구 파급 효과: 시뮬레이션에서 자동으로 생성된 대규모 멀티모달 데이터는 VLA 모델의 사전 학습(pre‑training) 및 파인튜닝에 활용될 수 있어, 실제 로봇에 적용하기 전 비용·위험을 크게 낮춘다. 또한, 모바일·손목·깊이 등 다양한 센서 구성을 실험적으로 검증할 수 있는 “가상 실험실”을 제공함으로써, 향후 로봇 하드웨어 설계와 인공지능 알고리즘 공동 최적화 연구에 핵심 인프라가 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기