통합 이벤트 인식을 통한 영상 시간 구간 정밀 매칭

초록

E.M.Ground는 하나의

상세 분석

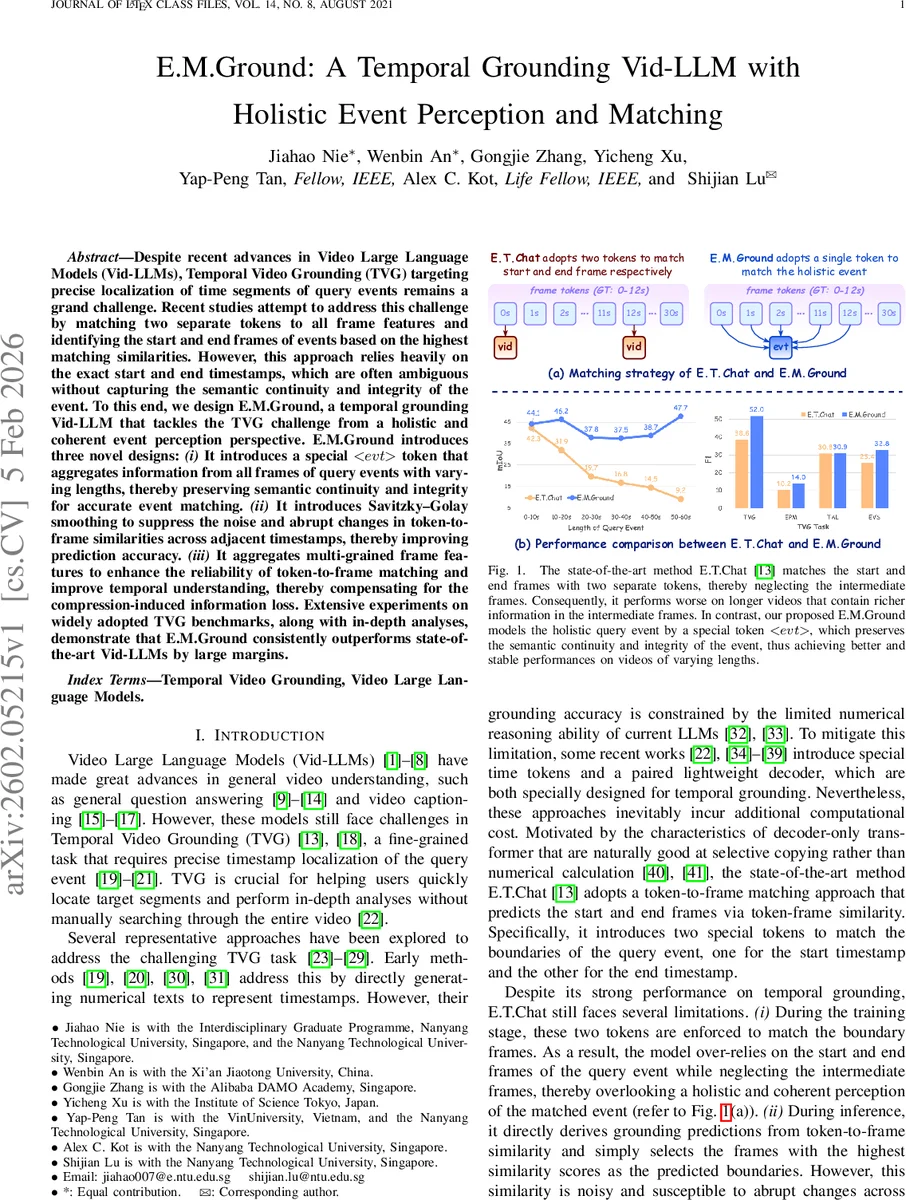

E.M.Ground는 기존 TVG(Temporal Video Grounding) 접근법이 시작·종료 프레임을 각각 별도 토큰으로 매칭하는 방식에서 벗어나, 이벤트 전체를 하나의

첫 번째 혁신은

두 번째 핵심은 Savitzky‑Golay 평활화이다. 토큰‑프레임 유사도 시퀀스는 영상 잡음, 프레임 압축, 시각적 변동 등에 의해 급격히 변동할 수 있다. Savitzky‑Golay 필터는 다항식 회귀 기반의 이동 평균을 적용해 고주파 노이즈를 억제하면서도 피크 형태를 보존한다. 결과적으로 짧은 이벤트나 VHD(Video Highlight Detection)와 같이 미세한 구간을 정확히 포착하는 데 유리하며, 기존의 단순 최대값 선택 방식보다 안정적인 경계 추정을 가능하게 한다.

세 번째 기여는 다중‑그레인 프레임 특징 집합이다. 기존 Vid‑LLM은 aggressive visual compression(예: 4×, 8× 프레임 샘플링)으로 인해 중간 프레임의 세부 정보가 손실되는 문제를 안고 있었다. E.M.Ground는 각 프레임을 L‑계층(L=1…L)에서 추출한 특징을 평균화해 다층 정보를 융합한다. 이렇게 얻어진 f_v_t는 저해상도 프레임에서도 풍부한 의미 정보를 담아,

학습 손실은 두 부분으로 구성된다. 기본 NLL(Negative Log‑Likelihood) 손실은 멀티모달 LLM의 텍스트 생성 목표를 유지하고, 별도 auxiliary loss L_matching은 프레임‑레벨 유사도와 스무딩 라벨 간의 교차 엔트로피를 최소화한다. 이중 손실 구조는 텍스트‑비디오 정합성뿐 아니라 시간적 정밀도도 동시에 최적화한다.

실험 결과는 Charades‑STA, TACoS, ActivityNet‑Caption 등 주요 TVG 벤치마크에서 기존 최첨단 모델(E.T.Chat, VTG‑LLM 등)을 크게 앞선 성능을 보였다. 특히 긴 영상(>30 s)에서의 R@0.5, mIoU 향상이 두드러졌으며, VHD 태스크에서도 peak‑preserving 특성 덕분에 F1 점수가 크게 상승했다. Ablation study는

요약하면, E.M.Ground는 “전체 이벤트를 하나의 토큰으로 인식하고, 시계열 노이즈를 평활화하며, 다층 시각 정보를 활용한다”는 세 가지 핵심 아이디어를 결합해, 기존 Vid‑LLM 기반 TVG의 구조적 한계를 근본적으로 해소한다. 이는 향후 멀티모달 LLM이 시간적 정밀성을 요구하는 다양한 응용(예: 영상 편집, 자동 요약, 인터랙티브 검색)으로 확장될 가능성을 열어준다.

댓글 및 학술 토론

Loading comments...

의견 남기기