KANFIS: 해석 가능하고 불확실성 인식이 가능한 신경‑기호 통합 프레임워크

초록

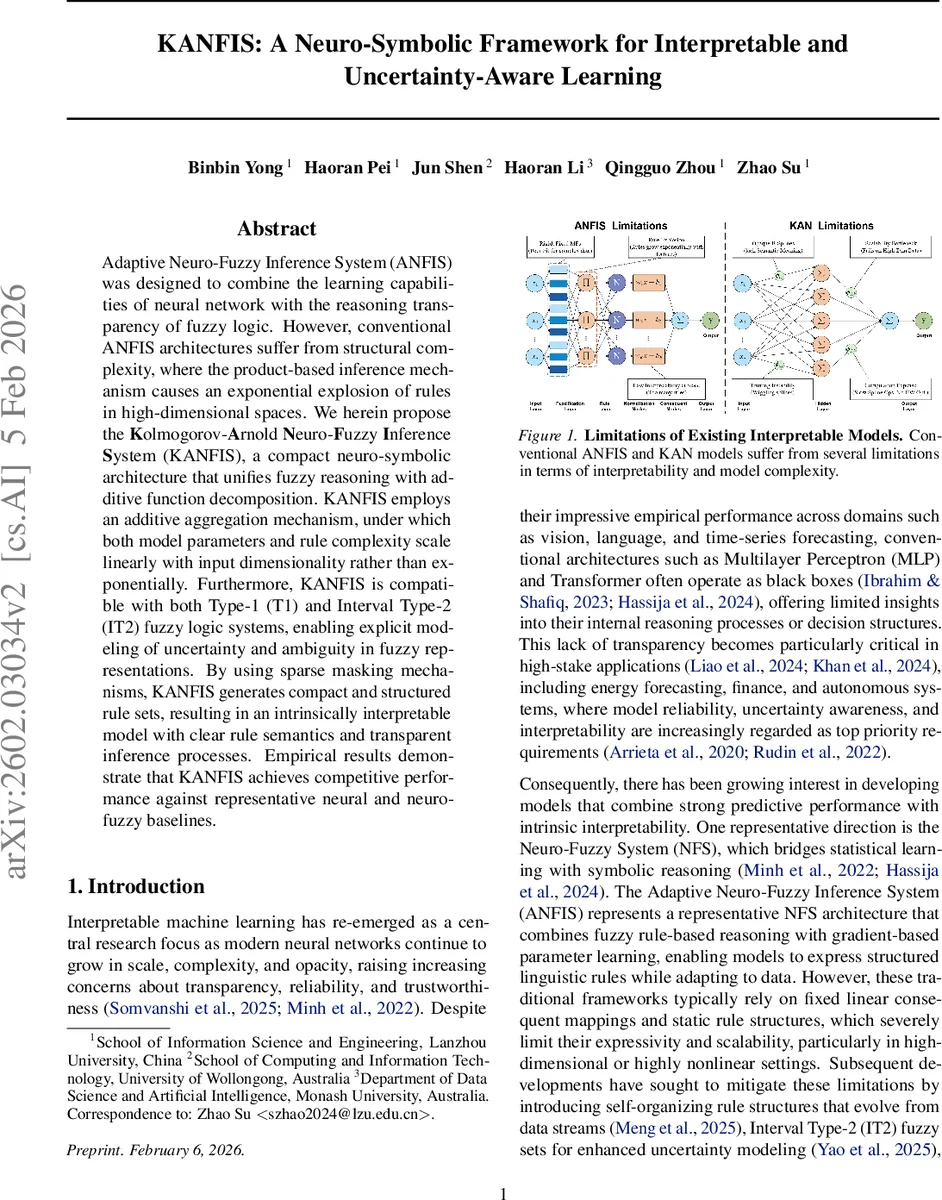

KANFIS는 Kolmogorov‑Arnold 정리를 기반으로 ANFIS의 퍼지 규칙을 선형이 아닌 가산 형태로 재구성한 신경‑기호 모델이다. 입력 차원이 증가해도 규칙 수와 파라미터가 선형으로 성장하도록 설계했으며, T1·IT2 퍼지 집합을 모두 지원해 불확실성을 명시적으로 표현한다. 희소 마스킹과 규칙 다양성 정규화를 통해 규칙을 압축하고 해석 가능성을 확보한다. 실험 결과, 기존 ANFIS·MLP·KAN 등과 비교해 예측 정확도와 해석 가능성 모두에서 경쟁력을 보인다.

상세 분석

KANFIS는 기존 ANFIS가 제품 기반(곱셈) 추론으로 인해 차원이 늘어날수록 규칙 수가 기하급수적으로 폭발하는 문제를 Kolmogorov‑Arnold(이하 KAN) 이론의 가산(superposition) 구조로 근본적으로 해결한다. KAN은 다변량 연속 함수를 유한 개의 일변량 함수와 덧셈으로 표현할 수 있다는 정리를 실현하는데, 이를 퍼지 시스템의 전제부(antecedent)와 결합하면 각 입력 특성마다 학습 가능한 멤버십 함수를 독립적으로 배치하고, 이들을 단순 가산 연산으로 결합한다. 따라서 규칙당 활성화는 “특정 입력이 어떤 멤버십 함수를 통과했는가”라는 이진 마스크에 의해 결정되며, 전체 규칙 수는 입력 차원 d와 선택된 함수 개수 K에 대해 O(d·K) 수준으로 제한된다.

모델은 두 가지 주요 확장을 제공한다. 첫째, T1 퍼지 집합뿐 아니라 Interval Type‑2(IT2) 퍼지를 도입해 하위·상위 멤버십 함수를 동시에 학습한다. 이는 데이터의 알레아터릭(aleatoric) 불확실성을 직접 파라미터화함으로써 예측 구간을 제공하고, 불확실성에 민감한 응용 분야에서 신뢰성을 높인다. 둘째, 희소 마스킹(sparse masking)과 규칙 다양성(diversity) 정규화 항을 손실에 추가한다. 희소 마스크는 각 규칙이 활성화되는 입력 차원을 제한해 “몇 개의 핵심 특성만을 사용한다”는 직관을 구현하고, 다양성 항은 서로 다른 규칙이 동일한 특성 조합을 중복 학습하지 않도록 강제한다. 결과적으로 규칙은 인간이 읽을 수 있는 형태(예: IF x₁ IS Gaussian(µ,σ) AND x₃ IS Bell…)로 유지되면서도 불필요한 중복을 최소한다.

학습 측면에서는 기존 ANFIS가 고정된 선형 가중치와 정해진 규칙 구조에 의존해 역전파 시 파라미터 수가 급증하는 반면, KANFIS는 각 에지마다 B‑spline 기반의 가변형 일변량 함수를 파라미터화한다. 이러한 함수는 미분 가능하고, 스플라인의 제어점 수가 직접 파라미터 수를 결정하므로 메모리와 연산량을 세밀하게 조절할 수 있다. 또한, KAN의 이론적 일반화 경계가 적용돼 모델 복잡도가 명시적으로 제어될 수 있다는 점이 학술적으로도 의미가 크다.

실험에서는 6개 공개 데이터셋(시간‑시계열, 의료, 스팸 분류 등)에서 IT2‑KANFIS와 T1‑KANFIS를 각각 비교하였다. 결과는 MAPE, RMSE, MAE 등 회귀 지표와 정확도·F1·AUROC 등 분류 지표에서 기존 ANFIS·MLP·전통 KAN보다 동등하거나 약간 우수함을 보여준다. 특히 고차원 데이터(예: CCPP)에서는 규칙 수가 10배 이하로 감소했음에도 불구하고 성능 저하가 거의 없었다. 이는 선형 성장 구조와 희소 정규화가 실제로 규칙 폭발을 억제함을 실증한다.

종합하면 KANFIS는 (1) 규칙 복잡도 선형화, (2) T1·IT2 퍼지를 통한 불확실성 명시화, (3) 해석 가능한 일변량 멤버십 함수 시각화, (4) 희소·다양성 정규화에 기반한 규칙 압축이라는 네 축을 동시에 만족하는 최초의 신경‑기호 프레임워크라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기