오디오·비디오 이해를 위한 능동 인식 에이전트 OmniAgent

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

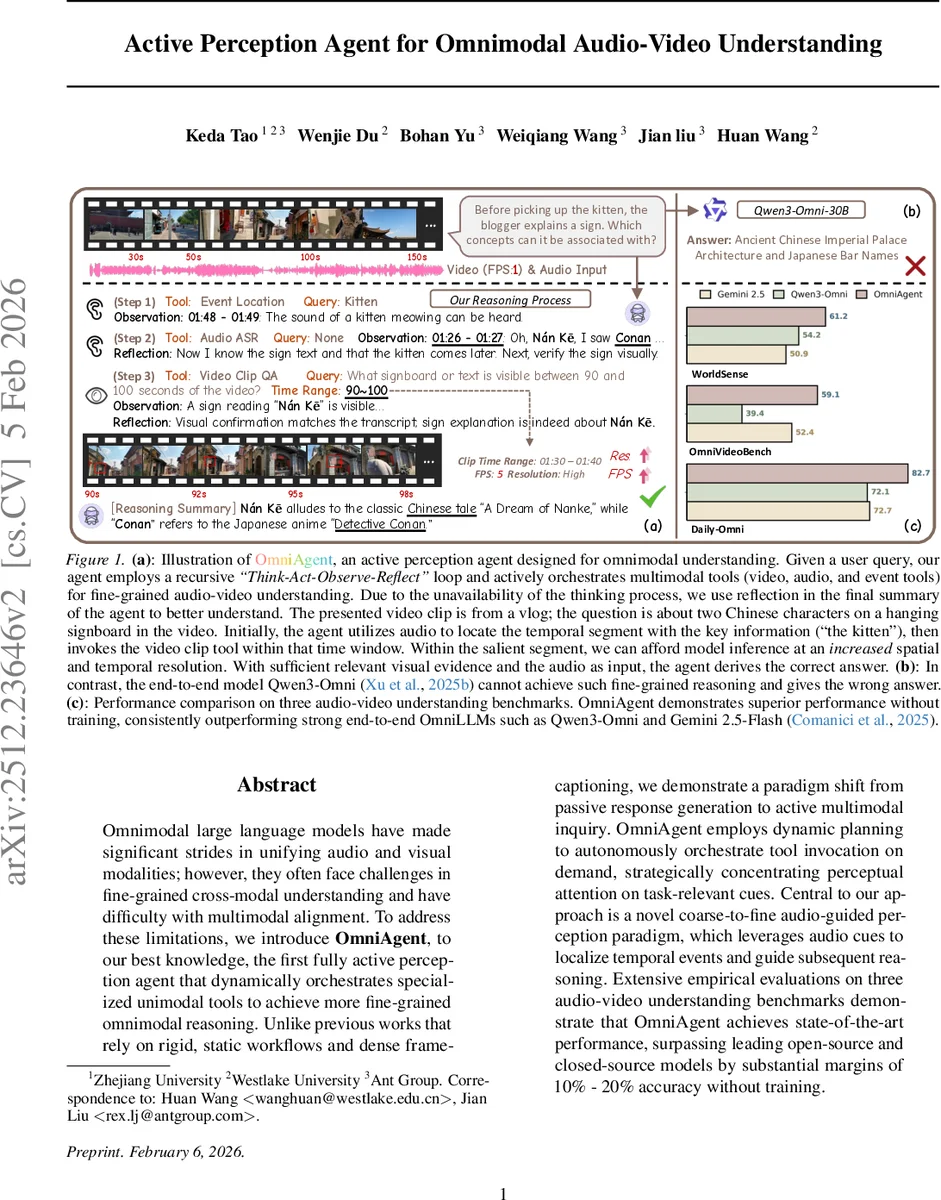

OmniAgent는 오디오와 비디오를 각각 전문화된 도구로 호출해 동적으로 조합함으로써, 정밀한 시공간 탐색과 교차 모달 정렬 문제를 해결한다. 음성 신호를 이용해 사건을 빠르게 위치하고, 필요 시 고해상도 비디오 클립을 분석해 질문에 대한 정확한 답을 도출한다. 훈련 없이도 기존 최첨단 OmniLLM을 10~20% 상회하는 성능을 기록한다.

상세 분석

본 논문은 기존의 엔드‑투‑엔드 옴니모달 대형 언어 모델(OmniLLM)이 겪는 두 가지 핵심 한계—미세한 교차 모달 이해와 고비용의 다중 모달 정렬 학습—를 근본적으로 재구성한다. 저자들은 “능동 인식(Active Perception)”이라는 새로운 패러다임을 제시하고, 이를 구현하기 위해 LLM을 중앙 제어 유닛으로 삼아 다양한 단일 모달 도구(tool)를 호출하는 구조를 설계하였다. 핵심 아이디어는 Think‑Act‑Observe‑Reflect 루프를 통해 질문에 가장 효율적인 감각(청취 vs 시청)과 처리 granularity를 스스로 선택하도록 하는 것이다.

-

Coarse‑to‑Fine Audio‑Guided Perception

- 오디오 스트림은 시간적 이벤트를 정확히 표시하는 자연스러운 신호이다. 논문은 먼저 전체 오디오에 대해 ASR 및 오디오 캡션을 수행해 사건 발생 시점을 추정한다(예: “키튼이 울리는 소리”). 이 단계는 저비용이며, 이후 비디오 도구를 호출할 구간을 좁히는 역할을 한다.

-

다계층 도구 집합

- 비디오 도구: 전역 QA(T_VGA)는 저해상도·저프레임 레이트로 전체 흐름을 파악하고, 클립 QA(T_VCA)는 선택된 구간을 고해상도·고프레임 레이트로 재분석한다.

- 오디오 도구: ASR(T_ASR)은 타임스탬프가 포함된 텍스트를 제공하고, 글로벌 캡션(T_AGC)은 음향 이벤트를 요약한다.

- 이벤트 도구: 오디오 기반 이벤트 로컬라이제이션 알고리즘은 전체 오디오를 스캔해 “청취‑우선” 탐색을 수행한다.

-

동적 플래닝 및 메모리 관리

- 에이전트는 현재 상태 s_t와 메모리 M={a_0,o_0,…,a_T,o_T}를 기반으로 행동 a_t를 선택한다. 행동은 “Listen to segment X”, “Watch clip Y” 등이며, 관찰 o_t는 해당 도구의 출력이다. 반영 단계에서는 관찰을 종합해 질문에 대한 정보 이득을 평가하고, 필요 시 추가 탐색을 계획한다. 이 과정은 투명하게 로그로 남아 설명 가능성을 높인다.

-

성능 및 효율성

- 세 가지 공개 벤치마크(OmniVideoBench 등)에서 훈련 없이도 Qwen3‑Omni‑30B, Gemini 2.5‑Flash 등을 10

20% 정확도 향상시켰다. 특히 미세한 텍스트·시각적 디테일(예: 90100초 구간의 간판 문자) 질문에서 기존 모델이 “프레임 캡션”에 의존해 틀린 답을 내놓는 반면, OmniAgent는 오디오 기반 사건 탐색 후 고해상도 비디오 클립을 분석해 정답을 도출한다.

- 세 가지 공개 벤치마크(OmniVideoBench 등)에서 훈련 없이도 Qwen3‑Omni‑30B, Gemini 2.5‑Flash 등을 10

-

한계와 향후 연구

- 현재 도구 집합은 사전 정의된 비디오·오디오·이벤트 모듈에 의존한다. 새로운 모달(예: 깊이 센서, 텍스트 OCR) 추가 시 인터페이스 재설계가 필요하다. 또한, 도구 호출 비용을 최소화하는 메타‑플래닝 알고리즘이 아직 탐색 단계에 머물러 있어, 비용‑효율 최적화가 향후 과제로 남는다.

전반적으로 OmniAgent는 “청취‑우선 → 시청‑세밀”이라는 인간 인지 과정을 모방함으로써, 정적인 프레임‑캡션 파이프라인을 뛰어넘는 효율적이고 설명 가능한 멀티모달 이해 체계를 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기