소프트 제약을 적용한 디노이저로 확산 모델의 유연성 강화

초록

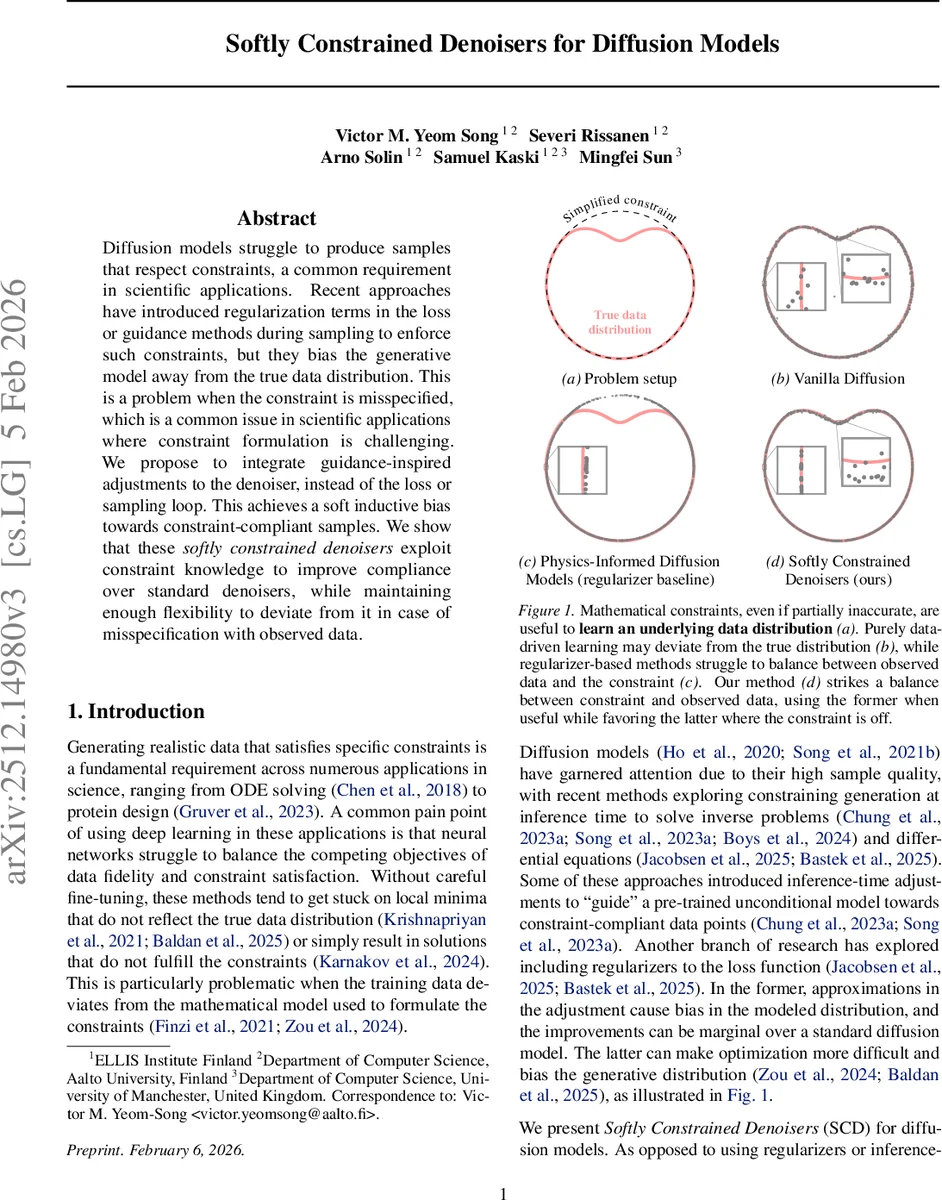

본 논문은 제약식의 정보를 디노이저 구조에 직접 삽입해, 학습 손실이나 샘플링 과정에 변형을 가하지 않으면서도 제약 만족도를 높이는 “Softly Constrained Denoiser(SCD)”를 제안한다. 제약이 부분적으로 잘못 지정되었을 때도 데이터 분포를 크게 왜곡하지 않으며, 기존 정규화·가이드 방식보다 제약 충족과 샘플 품질 사이의 균형을 개선한다.

상세 분석

Diffusion 모델은 노이즈가 섞인 샘플을 점진적으로 복원하는 과정에서 denoiser Dθ(xₜ, t)를 학습한다. 기존 연구는 (i) 손실에 제약 정규화 항을 추가하거나 (ii) 샘플링 단계에서 점수에 제약‑가이드를 삽입해 제약을 강제한다. 그러나 (i)은 최적화 난이도를 높이고 denoiser와 score 사이의 수학적 연결을 깨뜨려 모델이 데이터 분포 p_data에 수렴하지 못하게 만든다(논문 내 Proposition 3.1, 3.2). (ii)는 추정 오차가 누적돼 출력 분포에 편향을 일으키며, 특히 제약이 부분적으로 잘못 지정된 경우 오히려 데이터와의 차이를 확대한다.

SCD는 이러한 문제를 회피한다. 저자는 제약을 R(x)=0 형태의 residual 함수로 정의하고, 이를 부드러운 확률형태 l_c(x)=exp(−‖R(x)‖)로 변환한다. 가이드 식(4)의 근사화를 통해 “제약 그래디언트” ∇ₓ log l_c(D_origθ(xₜ, t))를 구하고, 이를 denoiser 출력에 직접 더한다. 핵심은 스칼라 스케일링 네트워크 γθ(xₜ, t)·σ(t)²를 도입해 제약 영향력을 학습시키는 것이다. 최종 형태는

Dθ(xₜ, t)=D_origθ(xₜ, t)+γθ(xₜ, t)·σ(t)²·∇ₓ log l_c(D_origθ(xₜ, t))

이며, 여기서 D_origθ는 기존 U‑Net 등 표준 denoiser이다. γθ는 별도 파라미터가 아니라 동일 네트워크의 추가 헤드로 구현돼 계산 비용이 거의 추가되지 않는다.

이 설계는 두 가지 중요한 성질을 보장한다. 첫째, 학습 목표는 기존 denoising score matching 손실과 동일하므로 무편향(unbiased) 특성을 유지한다. 즉, 무한 데이터와 최적화 조건 하에서 모델은 p_data에 수렴한다. 둘째, 제약 그래디언트가 네트워크에 직접 피드백되므로, 학습 과정에서 “언제 제약을 따르고 언제 데이터를 우선할지”를 스스로 판단한다. 따라서 제약이 정확하면 높은 만족도를, 오차가 있으면 데이터에 더 가까운 샘플을 생성한다.

이론적 분석에서는 정규화 기반 방법이 ELBO를 악화시키고 denoiser를 조건 평균에서 이동시킨다는 사실을 정리(Prop 3.1, 3.2)하고, SCD는 이러한 편향을 도입하지 않음을 강조한다. 실험에서는 (1) 단순 2‑D 제약 예시, (2) PDE 기반 물리‑인포드 생성, (3) 실제 과학 데이터(예: 전자기 파동, 유체 흐름)에서 제약 만족도와 FID/IS 등 샘플 품질 지표를 비교한다. 모든 베이스라인(regularizer, classifier‑guidance, classifier‑free guidance 등)보다 SCD가 제약 위반률을 크게 낮추면서도 이미지 품질 저하가 미미하거나 오히려 개선되는 결과를 보인다. 특히 제약을 의도적으로 왜곡시킨 실험에서 SCD는 데이터 분포에 대한 복원력을 유지해, 기존 방법이 과도하게 제약에 고정되는 현상을 방지한다.

한계점으로는 (i) 제약이 미분 가능하고 ‖R‖ 형태로 표현 가능해야 한다는 전제, (ii) γθ의 학습이 불안정할 경우 제약 효과가 과소·과대 적용될 수 있다는 점을 들 수 있다. 향후 연구에서는 비미분 가능 제약을 근사화하거나, 다중 제약을 조합하는 메커니즘, 그리고 γθ의 정규화·스케줄링 전략을 탐색할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기